cadre theorique

PREMIERE PARTIE

CHAPITRE II : CADRE THEORIQUE

II.1. INTRODUCTION AU CADRE THEORIQUE

Toute recherche qui ambitionne de se hisser à un niveau scientifique doit être menée

dans un cadre théorique explicite. Ce cadre théorique permet en effet de préciser le sens

donné aux concepts manipulés. Il assure une lisibilité du texte tout en permettant une

articulation entre les différentes parties, de manière à faire du travail un ensemble

cohérent, permettant ainsi une interprétation pertinente des données recueillies. C’est

une des conditions à remplir pour partager les résultats avec la communauté

scientifique. Popper (1973) parlerait de la condition de falsifiabilité.

Ainsi, après avoir justifié notre démarche, nous passerons en revue les champs

théoriques qui ont analysé les processus, les phénomènes et les concepts en jeu dans

notre recherche.

Dans cette perspective, la revue de la littérature nous a montré que la résolution de

problème, dans le cadre de l’enseignement et l’apprentissage de la physique et de la

chimie, convoque au moins deux champs théoriques qui interfèrent dans l’analyse des

processus éducatifs : la psychologie, et l’épistémologie des sciences. Ces deux

domaines de connaissance seront donc revisités en rapport avec la résolution de

problème en général, en physique et chimie en particulier.

Mais de manière plus spécifique, notre recherche s’inscrit dans le champ de la

didactique de la physique et de la chimie. Ainsi, aussi bien au niveau théorique qu’au

niveau de la recherche, le point sera fait, dans le but de préciser l’objet de notre

recherche, et de justifier notre démarche méthodologique. Le cadre théorique,

notamment son volet spécifique, permettra de bien camper la recherche dans le champ

de la didactique de la physique et de la chimie, et plus particulièrement sous l’angle de

la résolution de problème.

II.2. CADRE THÉORIQUE GÉNÉRAL

II.2.1. Justification du cadre théorique général

La résolution de problème peut être décrite comme une activité cognitive finalisée,

c’est-à-dire au service d’une tâche à effectuer dans une situation donnée (Richard,

1990). Elle fait appel à une activité psychique et à des processus intellectuels mettant en

jeu des connaissances. Celles-ci sont également acquises ou construites par le biais de

processus intellectuels antérieurs. Notre recherche s’intéressera donc à l’analyse de ces

processus à travers les différents courants psychologiques les plus pertinents qui se sont

intéressés aux phénomènes éducatifs en général.

La résolution de problème peut ainsi être abordée sous l’angle psychologique, en

relation avec les processus d’acquisition ou mieux, de construction du savoir

scientifique. C’est pour cette raison que les activités de résolution de problème sont très

valorisées dans les activités scolaires destinées à guider l’apprentissage ou à évaluer les

acquisitions des élèves. Ceci est particulièrement vrai pour les disciplines scientifiques

telles que les mathématiques, la physique et la chimie.

Cet angle d’attaque met ainsi en avant un ensemble de concepts qu'il nous faudra passer

en revue: enseignement, apprentissage, connaissances, problème, résolution de

problème. Certains concepts sont naturellement articulés avec d’autres concepts pour en

structurer le champ sémantique ou en préciser le contexte pragmatique.

L’enseignement étant indissociable de l’apprentissage, le cadre théorique devra

expliciter l’interaction entre ces deux concepts dans leur rapport avec la résolution de

problème.

Ces interactions mettant en jeu des connaissances en amont comme en aval, le cadre

théorique devra également prendre en charge la question des connaissances, de leurs

modes d'acquisition, de stockage et de transformation, et de leur utilisation dans le

processus de résolution de problème.

Il apparaît ainsi indispensable, pour fonder notre recherche, tant du point de vue

théorique que méthodologique, de revisiter les concepts-clés ainsi identifiés à la

lumière des théories de la connaissance et du comportement humain, c’est-à-dire des

théories psychologiques, mais en y adjoignant au besoin un éclairage épistémologique.

Cependant, compte tenu des interactions complexes entre ces courants, notre démarche

ne sera pas linéaire. La revue des concepts dépendra des cadres théoriques revisités et

de la place accordée dans ces courants aux concepts clés de notre recherche.

En cela, nous tiendrons compte de la réalité éducative. Celle-là nous révèle que les

activités éducatives sont au carrefour de fondements multiples. Ceux-ci, explicités ou

non, déterminent des choix, des prises de décision, des stratégies, des méthodes et des

innovations. La psychologie occupe une place privilégiée parmi les nombreux

fondements du champ éducatif.

Depuis l’émergence au 15

ème

siècle du néologisme « psychologie » attribué à

l’Allemand Mélanchton pour désigner l’étude de l’âme et de l’activité mentale, jusqu’à

l’accès au statut de science, la psychologie a eu pour objet une question centrale :

pourquoi l’être humain agit-il comme il le fait ? (Raynal et Rieunier, 1997).

Pour répondre à cette question-clé, divers points de vue et approches se sont succédés,

ou ont cohabité. Une analyse chronologique des différentes approches psychologiques

s’avère donc difficile, surtout si on prend en compte le point de vue de Popper (1973)

sur la logique de la découverte scientifique: la présentation à posteriori des

« découvertes » scientifiques correspond rarement à la chronologie de leur avènement.

Il est donc indispensable, dans le cadre de cette recherche, de disposer d’une grille de

lecture explicite de ces différentes approches psychologiques.

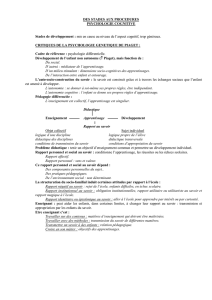

Dans cette perspective,.Gagné (1985) décrit le champ de la psychologie dans un espace

à deux dimensions croisant des niveaux d’analyse et des types de comportement. Les

comportements selon Gagné, ont trois modalités : le comportement social, le

comportement intellectuel, le comportement psychomoteur. Ces comportements sont

croisés avec deux niveaux d’analyse : le niveau cognitif et le niveau affectif.

Nous proposons d’ajouter comme troisième niveau d’analyse, le niveau psychomoteur.

On obtient ainsi un tableau à double entrée symétrique. Le croisement de chaque niveau

d’analyse avec un type de comportement permet de délimiter un objet du champ de la

psychologie. Le tableau suivant permet de décrire l’espace psychologique selon

Gagné(1985) , élargi au troisième niveau d’analyse que nous avons introduit.

Tableau 10 : description de l’espace psychologique (adapté de Gagné, 1985)

Comportement

social Comportement

intellectuel Comportement

psychomoteur

Niveau affectif 1 2 3

Niveau cognitif 4 5 6

Niveau psychomoteur 7 8 9

La première colonne du tableau donne différents niveaux d’analyse, alors que la

première ligne spécifie les types de comportement. Ainsi chaque case correspondant à

un numéro permet de définir une approche psychologique.

Par exemple, la case 1 croise le niveau affectif et le comportement social. Cette case

définit ainsi la partie de la psychologie qui s’intéresse aux interactions entre les

comportements au sein d’un groupe et l’affectivité. Elle constitue en elle-même un

cadre problématique implicite. Elle permet par exemple de poser un certain nombre de

questions :

- Comment l’affectivité des individus peut-elle influer sur le fonctionnement d’un

groupe ?

- Les groupes peuvent-ils être caractérisés par des comportements affectifs

spécifiques ?

La case 5 quant à elle met en relation le niveau d’analyse cognitif et le comportement

intellectuel. Comme nous le verrons plus loin, cette case permet de définir le champ de

la psychologie cognitive.

Il faut souligner tout de suite que du fait de la globalité du comportement humain, cette

décomposition ne met en évidence que des cas limites. L’analyse la plus complète du

comportement humain devra certainement faire appel à plusieurs niveaux.

De manière plus opérationnelle Tardif (1992) définit trois courants psychologiques : la

psychologie béhavioriste, la psychologie humaniste et la psychologie cognitive. Ces

différents courants psychologiques identifiés par Tardif (1992) s’intègrent parfaitement

dans l’espace proposé par Gagné(1985). C’est ainsi que la psychologie béhavioriste est

au croisement du niveau d’analyse psychomoteur et du comportement intellectuel. La

psychologie humaniste s’intéresse au comportement intellectuel analysé sous l’angle

affectif. Quand à la psychologie cognitive, elle croise le comportement intellectuel et le

niveau d’analyse cognitif.

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

41

41

42

42

43

43

44

44

45

45

46

46

47

47

48

48

49

49

50

50

51

51

52

52

53

53

54

54

55

55

56

56

57

57

58

58

59

59

60

60

61

61

62

62

63

63

64

64

65

65

66

66

67

67

68

68

69

69

70

70

71

71

72

72

73

73

74

74

75

75

76

76

77

77

78

78

79

79

80

80

81

81

82

82

83

83

84

84

85

85

86

86

87

87

88

88

89

89

90

90

91

91

92

92

93

93

94

94

95

95

96

96

97

97

98

98

99

99

100

100

101

101

102

102

103

103

104

104

105

105

106

106

107

107

108

108

109

109

110

110

111

111

112

112

113

113

114

114

115

115

116

116

117

117

118

118

119

119

120

120

1

/

120

100%