6.3. Le développement soutenable : grâce à une économie

Introduction générale

:

- MALTHUS, dans essai sur le principe de population (1798) : limiter la croissance démographique car elle augmente à un rythme

plus important que celle de la production

- RICARDO dans les principes de l’économie politique et de l’impôt (1817) : la mise en culture de terre de moins en moins fertiles

un état stationnaire.

- JEVONS dans la question du charbon (1865)

Toutes ces réflexions qui indiquent une limite à la croissance perdent de leur influence au cours de la seconde moitié du XXe siècle

avec les 30 glorieuses où le taux de croissance est très élevé.

Au début des années 70, la question des limites de la croissance économique, notamment dans un modèle capitaliste, resurgit à

travers la question environnementale. La multiplication des catastrophes écologique (marées noires, perte de la biodiversité,

changement climatique), les accidents industriels (Tchernobyl en 1986, Bhopal en 1984) entraînent une prise de conscience à la fois

au niveau institutionnel (

), au niveau politique ( émergence de mouvements écologistes), au niveau législatif ( multiplication des règles à

vocation environnementale).

Chapitre n°1 : L’analyse économique de l’environnement

1.1. De la nature des biens environnementaux

- -à-

ressources rares.

Néanmoins, les biens environnementaux sont différents des biens privés car ils ne répondent pas strictement aux hypothèses de

:

- des biens communs (rivalité, pas exclusion). Exemple les ressources halieutiques en haute mer (HARDING La tragédie des biens

communs (1968)

- des biens publics purs : non-rivalité, non-exclusion. Ex : air pur

1.2. Les causes de la dégradation des biens environnementaux

Les externalités sont la principale explication de la dégradation des biens environnementaux. En effet, dans ce cas, ceux qui

ne supportent que le coût privé qui est inférieur au coût social la plupart du temps. En témoigne une

enquête réalisée par la RATP en 1997 sur le comportement des franciliens dans leur choix transport : un déplacement en voiture

pour le loisir de la première c

était de 114 fr.

Ces externalités négatives sont particulièrement fortes dans le cas des biens communs

surexploitation :

- HARDIN dans La tragédie des biens communs, in Science (1968) : chaque

rtageant

le coût avec les autres éleveurs, il est fortement incité à fai

situation de surexploitation du pré.

- Autres exemples : la surexploitation des ressources alieutiques, la déforestation (cf. modèles bio-économiques infra)

ERLICH et ERLICH, dans Extinction : the causes and the consequences of the disappearance of species (1981) ont tenté de formuler un

règle générale sur les causes des dégradations environnementales : I = PAT Un impact env.

facteurs : la population (P), le niveau individuel de consommation (A) et la nature de la technologie (T)

(P) : Dans les pays pauvres, le facteur population est la principale cause. Selon la Banque Mondiale, le taux de croissance de la

population en Europe sur la période 2001 et

Problème principal : la croissance de la population oblige à une mise en culture de nouvelles terres obtenues par la déforestation dont

les conséquences environnementales sont graves : Perte de biodiversité (surtout dans le cas des forêts primaires), minéralisation des

rêts en

!

Causes de la déforestation :

- La pauvreté à travers deux effets : (i) La croissance démographique liée au sous-développement : la pauvreté oblige les familles

à faire des enfants pour apporter une source de revenus et prendre en charge la fin de vie des adultes. Or, comme le TMI est élevé,

les familles font plusieurs enfants. (ii) Pour subvenir aux besoins alimentaires de la population qui sont croissants et pressants, la

déforestation est rapide. Contradiction entre le court terme et le long terme des

détours de production.

- le rôle des pays étrangers qui achètent des terres pour assurer leur sécurité alimentaire avec la Chine comme principal

acheteur, Accélération due à la crise

alimentaire depuis 2008 (spéculation sur les matières premières).

?

- : plus elles sont

pauvres, plus elles doivent répondre immédiatement à l

- Néanmoins, la transition démographique des PED devrait se stabiliser vers 2050

niveau de vie.

(A et T) : ce sont les principaux facteurs dans les pays développés : même si les habitants des pays développés ne représentent

que 30% de la pop mondiale, ils consomment la majorité des ressources environnementales de la planète.

dégradation, nos modes de production et de consommation : par ex, les fraises en hivers qui font le tour du monde ; la

consommation de viande qui augmente avec le niveau de vie

Ces modes de production et de consommation proviennent préférence pour le présent (contradiction court/long terme) :

- Logique de conso immédiate pour satisfaire des désirs qui dépassent de loin les besoins vitaux.

- Leurs représentants partagent aussi cette préférence pour le présent pour des raisons politiques : court terme des mandats qui

empêche une action politique de long terme (on le voit au niveau du

américain, même si quelques états fédérés ont imposé de lourdes contraintes comme en Californie) ; clientélisme électoral qui ne

remet pas en cause les modes de conso des habitants ; activité des lobbies (ex : En 2008, Greenpeace a dénoncé les pressions

émissions des véhicules à 120 g CO2/km en 2012. Mais, Greenpeace a ainsi calculé que si toutes les dérogations réclamées par les

des 120 g réclamés par Greenpeace et plus encore que la moyenne européenne actuelle (chiffre 2007 : 158 g)

Chapitre 2 – L’évaluation des biens environnementaux

2.1. Les principes d’évaluation

2.1.1. Les différentes composantes de la valeur

, une

r laquelle il

faut mobiliser plusieurs éléments pour comprendre la valeur économique totale (VET)

dédommagement comme dans le cas de Tchernobyl par ex.) Elle se base sur la notion de surplus définie par HICKS en 1943 dans

» in Review of economics studies : il faut compenser les changements de revenus lié à une

A partir de la demande hicksienne, deux :

Débat autour de la mesure à retenir :

- Dans un ouvrage de 1989, MITCHELL et CARSON (Using surveys to value public goods : the contingent value method) estiment

faut retenir le surplus compensatoire car les conséquences

situation, donc après le changement.

- Mais, il est aussi possible de prendre en compte la situation finale à travers le surplus équivalent : par exemple, à la question « a-t-on

ir pur ?

Exemple, la législation

américaine sur le Clean Air Act

: Dans de nombreuses études, écarts substantiels apparaissent en faveur de

la capacité à recevoir. Dans une étude publiée en 2002, HOROWITZ et McDONNELL « A review of WTA/WTP studies », in Journal of

environmental economics and management, constatent sur 45 études que les différences sont réelles (le rapport CAR/CAP peut aller

27 dans certains cas) ; plusieurs explications :

Situation initiale comme référence (Après le

changement, on raisonne à partir de la nouvelle

(situation intiale) prise comme référence)

surplus compensatoire

Situation finale comme référence (Pas de changement,

on raisonne donc à partir de la même situation par

rapport à ce que la situation aurait du être avec le

changement) surplus équivalent

Gain de bien-être

Consentement à payer

Consentement à recevoir

Perte de bien-être

Consentement à recevoir

Consentement à payer

V(Claude HENRY dans un article de 1974

« Investment decisions under uncertainty : the irreversibility effect » in

American Eco Review)

ite en état et son aménagement :

- - Si aménagement, coût si la rentabilité est plus faible que celle prévue

le réaménagement est irréversible

- - décision irréversible entraîne un

gain de décision flexible avec choix des possibles maintenu

- Un effet revenu : comme la capacité à recevoir entraîne une augmentation du revenu à la différence de capacité à payer qui

abaisse le niveau du revenu, les individus privilégie souvent la première solution

- Un effet de substitution : si le bien environnemental a peu de substituts, la compensation pour accepter une réduction de

quantité doit être élevée (cf. HANEMANN, « Willingness to pay and willingness to accept : how much cant hey differ ? », in American

Eco Review (1991)

En fait, le débat doit se trancher au cas par cas des évaluations réalisées essentiellement en fonction de la nature des droits de

propriété. Ex : Tchernobyl, comme les droits de propriété sont clairement attachés à la situation initiale, le surplus compensatoire

2.2. Les méthodes d’évaluation

:

- la méthode des préférences révélées (méthodes indirectes) : on cherche à valoriser les biens non-marchands en observant des

-marchands.

- Les méthodes des préférences exprimées (méthodes indirectes) : interroger les individus sur leur capacité à payer.

2.2.1. Les méthodes indirectes

La méthode des prix hédoniques : Cette méthode part de

est fonction de ses caractéristiques. On isole une caractéristique pour mesurer son influence sur le prix de vente.

Plusieurs hypothèses du modèle posent problème (Les deux dernières hypothèses sont rarement vérifiées) :

- Le nombre de variables : si il y en a trop, risque de colinéarité ; si pas assez, le prix sera mal expliqué

- Les acheteurs sont parfaitement mobiles

- Information transparente : les individus sont parfaitement informés sur le lien entre le prix et les caractéristiques retenues

BROOKSHIRE, D’ARGE, SCHULTZE et THAYER dans « Experiments in valuing publics goods », in SMITH, Adavances in applied

microeconomics, 1981

es ménages sont prêts à payer entre eux 20 et 150 $ par mois pour

La méthode des fonctions de dommage : la fonction de dommage comporte 2 phases successives : dans un premier temps, un lien

quantitatif d ; dans un deuxième temps, on associe

une valeur monétaire au lien mis en évidence dans la première étape. Par exemple, Marc WILLINGER et Serge MASSON (Evaluation

des coûts de la pollution atmosphérique sur la santé en île de France, rapport ADEME, 1996) ont évalué les coûts de la pollution

atmosphérique sur la santé en Île-de-

variation de 11 à 26 mg/m3 accroît en moyenne la mortalité de 2 morts par jour et plusieurs hospitalisations. Coût journalier (vie

humaine + hospitalisations) de 3 730 000 fr. Comme le niveau de concentration de fumée noire à 26 mg est atteint 180 jours par an, le

coût annuel est de 671 millions de francs.

2.2.2. Les méthodes directes

Exemple : : (i) la

construction du scénario de référence (cherchant à évaluer une variation du bien-

; (ii) La révélation des valeurs

capacité à payer moyenne ; (iv) la recherche de variables explicatives (on cherche à relier les réponses à différentes

caractéristiques socio- ; (v) on multiplie la CAP moyenne par la population totale (vi)

(y a-t-il beaucoup de faux zéros)

Plusieurs biais doivent être évités pour que la méthode soit valable : biais stratégique (sous-évaluation du CAP car passager

clandestin) ; le biais hypothétique : les individus peuvent exprimer des CAP différentes

Les méthodes précédentes sont souvent difficiles à appliquer dans certains pays en développement soit parce que les données

marchandes sont peu nombreuses pour utiliser la méthode des préférences révélées (par exemple, le marché du logement est bien

loin de fonctionner comme on le suppose avec les prix hédoniques) ; soit parce que les situations hypothétiques des marchés fictifs

utilisées dans les méthodes des préférences révélées sont très éloignées du vécu des populations par rapport aux biens

environnementaux.

. Par exemple, la méthode du coût de substitution : le bien environnemental est un

environnemental, on obtient une mesure de sa contribution à la valeur du produit et on peut en déduire son prix implicite unitaire.

Chapitre 3 – Les politiques environnementales dans la théorie

ce

compte dans un processus de décision basée sur la comparaison des coûts et des avantages qui en résulteraient. À partir de là, des

solutions aux dégradations environnementales semblent aller de soi et consisteraient à mettre en place des institutions.

3.1. L’optimum de pollution (ou social ou de premier rang !)

-optimale des ressources. un un autre

la

- aiement de la

s

préselui affecter un prix aux externalités

pour obliger celui qui produit les externalités négatives à internaliser leur coût social.

Ce prix correspond au c

t de

celle de dommage marginal. Autrement dit, le

-ci ne doit

pas trop polluer pour ne pas causer trop de dommages aux habitants. Ainsi,

pollution ! Il ne faut pas confondre internalisation des externalités et disparition de la dégradation environnementale.

3.2. Les différents outils de la politique environnementale

Les instruments réglementaires : Leur objectif est de contraindre le comportement sous peine de sanctions administratives ou

judiciaires. Ils prennent très souvent la forme de normes :

respecter (ii) Les normes de qualité qui spécifie les caractéristiques des milieux récepteurs (niveau de bruit maximum, concentration

Limite : social car cela nécessite de connaitre niveau de pollution optimal et pour cela

la droite de coût marginal de dépollution dont le réglementeur a difficilement connaissance car elle relève de la compta privée (alors

e marginal)

Les instruments économiques : des comportements moins polluants grâce à un signal prix. On

peut distinguer les écotaxes, les marchés de permis négociables, Les subventions sur la dépollution ou plus généralement sur le coût

de dépollution les règles

juridiques de responsabilité qui oblige le pollueur à dédommager les victimes.

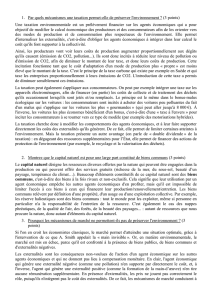

- est une application du principe de la taxation pigouvienne. Dans un ouvrage de 1932, The economics of welfare, PIGOU

préconisait

marginal de dépollution des entreprises.

-à-dire que toutes les entreprises ont le même coût

marginal

donner et la distribution des revenus entre les pollués et les pollueurs qui en

résultent est évidemment moins favorables pour les pollueurs que dans le cas de la norme.

Limite: idem que pour les normes ; BAUMOL et OATES il était inefficace de compenser les pollués pour la pollution

us de taxer les pollueurs

les effets de la pollution (The theory of environmental policy, 1988)

- la solution des marchés de permis négociables fait référence à la théorie de Ronald COASE émise dans un article de 1960 « The

problem of social cost », in Journal of Law and Economics : dans le fait que

de payer des coûts sociaux

ressources si les pollueurs et les pollués peuvent négocier directement entre eux. La répartition du profit total des participants

dépend alors du rapport de forces dans la procédure de négociation, mais

quelle que soit la répartition initiale des droits de propriété . Par exemple, si des riverains ont droit à une eau

propre

des polluants en versant une compensation supérieur

jets qui

égalise son bénéfice marginal et le dommage margin

reste inférieur au dommage

ces projets. Un accord a lieu quand le prix payé par le paysan égalise son dommage marginal et le bénéfice marginal de la firme.

Dans ce casité est internalisée par le paiement de la victime.

Limite : Absence de coûts de transaction-à-

e pas dans le monde réel.

Deux systèmes sont utilisés : (i) Système « Cap and Trade » : sur une zone géographique, le réglementeur définit un plafond

correspondant au maximum de pollution autorisée. La distribution se faire gratuitement selon une règle de

répartition, soit aux enchères.. première solution inéquitable car la distribution se fait proportionnellement aux émissions

passées.(ii) Système « Baseline and Credit » : Chaque firme se voit attribuer un niveau à partir duquel ses performances sont

mesurées.

Limite : (i) A Kyoto, le nombre de quotas distribués la première année du fonctionnement a été si peu nombreux que le prix du

permis a été quas

1

. -

firmes auprès des états qui les ont poussés à fixer un plafond trop haut induisant un prix nul. (ii) problème moral lorsque les

entreprises ont un nombre de quotas équivalent à leur niveau de pollution.

Les instruments informationnels signal

informationnel. Ex : éco-labels

Les accords volontaires ou négociés dispositifs contractuels liant une autorité publique est une industrie

it ensuite

les eft

Autres solutions : dans Governing the commons : the evolution of institutions for collective action (1990), Elinor OSTROM remet en

cause l'idée classique selon laquelle la propriété commune est mal gérée et doit être prise en main par les autorités publiques (pigou)

1

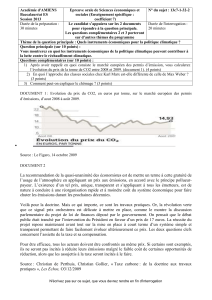

Le protocole de Kyoto a fixé un objectif de réduction des émissions mondiales de 5 % par rapport à 1990. L’union européenne s’est engagée à réduire de 8 %

entre 2008. Pour ce faire, l’union européenne a lancé en janvier 2005 un marché d’échange de quotas d’émissions de carbone. En 2005, les institutions

européennes ont émis 2,2 milliards de tonnes de CO2, soit 2,2 milliards de quotas ( un quota égal 1 t). Toutefois les émissions ont été inférieures de 44

millions de tonnes par rapport aux quotas fixés ( France et Allemagne ayant été les plus généreux avec leurs entreprises). Conséquence : le prix du quota qui

Notons par ailleurs que le marché

nt le

risque de ne pas pouvoir respecter les engagements de Kyoto.

ou le marché (coase). Dans ouvrage, elle décrit de nombreux cas de gestion de ressources par des communautés qui ont su éviter la

surexploitation des biens communs. Partant de ces études, elle propose une

succès de certains régimes de gestion

En outre, elle souligne la supériorité des instruments économiques sur la réglementation :

- s

pollueurs.

-

donc égaux pour les différents agents.

- Les instruments économiques incitent à aller au-éduction de la

du

marché de permis.

- océdés de production moins

polluants et de techniques de dépollution.

3.3. Quel instrument choisir en l’absence d’incertitude ?

ues sur

les instruments réglementaires.

1ère raison - coûts de dépollution plus faibles

nt réglementaire. Chez les producteurs, la norme

uniforme fait que la répartition des efforts entre les sources est nécessairement inefficace si les coûts marginaux respectifs diffèrent.

Les entreprises qui ont les coûts marginaux de dépollution les plus faibles dépolluent trop peu tandis que les entreprises qui ont des

l de

dépollution soit égal à la taxe à payer. Il vaut mieux payer la taxe que de dépolluer à un coût supérieur et dépolluer que de payer la

taxe quand celle-ci est plus élevée. La répartition des efforts est efficace puisque le coût total de réduction de la pollution est minimisé

x des différents pollueurs avec la taxe.

2ème raison ils sont plus incitatifs

technologie moins polluante est utilisée (progrès technique environnemental) : Avec une norme uniforme (instrument réglementaire),

-

effet, grâce au PT, les coûts de dépollution diminuent : pour un même niveau de pollution, les coûts de dépollution sont plus faibles

s, aves un même niveau de taxe uniforme (ie elle est la même avant et après

uniforme.

Ainsi, double gains : baisse des coûts de d

pollués.

à niveau

de pollution inchangé, la demande de permis baisse (on en a moins besoin) et leur prix baisse aussi. Il en résulte alors seulement une

3.4. Quel instrument choisir en présence d’incertitude ?

-

prix (taxe) et instrument-quantité (marché de droits).

Incertitude sur les dommages marginaux liés à la pollution (fonction de coût marginal connue) : pas de différence entre

-estimation ou de sur-estimation de la fonction de dommage

marginal. La perte de surplus social est la même dans les deux cas. Il y a la même efficacité environnementale.

Incertitude sur les fonctions de coût de dépollution (fonction de dommage marginal connue) : différences entre les deux

instruments selon la pente de la fonction de dommage marginal :

- Si la pente de Dm est faible (= -prix car

sont plus faibles dans ce cas.

- Si la pente de Dm est forte (= plus les dommages marginaux augmentent rapidement avec le niveau de pollution), il faut choisir

-quantité car

La régulation par les quantités est plus efficace si les dommages augmentent plus rapidement que le coût de dépollution (ex : les GES et les

marchés de quotas)

s préférences

de la société :

- La taxation ne garantit pas la réalisation ctif environnemental souhaité, les réactions des pollueurs au signal-prix dépendant

des élasticités-prix. En revanche, on contrôle les coûts de dépollution

-

maîtrise la réalisatio

, WEITZMAN montre que (i) lorsque le rapport entre la pente de la fonction de coût marginal et la

pente de la fonction de dommage marginal est faible, ; il convient donc de privilégier

la sécurité

alimentaire. (ii) ; il convient alors de privilégier la

taxe. (1974, Prices versus Quantities, in American Eco Review):

imparfaite

BAUMOL (« On taxation and the control of externalities », in American economic review) en 1972 à

proposer un optimum de second rang

objectif. Objectif : minimisation des coûts de dépollution (optimum de second rang). Dans un optimum de second rang, les

instruments ne sont plus équivalents et il faut pouvoir les comparer pour choisir le plus approprié.

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

1

/

19

100%