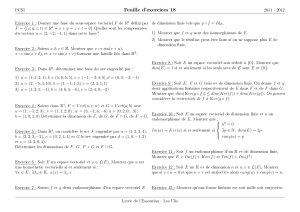

Fiche 7 : Applications linéaires et changements de bases en

E F

E F

f E F ∀u, v ∈E∀λ∈

f(u+v) = f(u) + f(v)

f(λu) = λf(u)

f E F λ1u1+· · · +λkuk

E λ1f(u1) + · · · +λkf(uk)f

E0FF

E F L(E, F )

α1f1+· · · +αqfqf1,· · · , fqE F

E F

L(E, F )E F

FEE F

E, F, G −f∈ L(E, F )g∈ L(F, G)g◦f∈ L(E, G)

f∈ L(E, F )E F

f−1F E F E

E F E F

E

F E

n E E n

En

f∈ L(E, F )

Ker(f) = {u∈E|f(u) = 0F}f

0E∈Ker(f)Ker(f)E

Im(f) = f(E) = {v∈F| ∃u∈E v =f(u)}f

0F∈Im(f)Im(f)F

E n BE={e1,· · · , en}E Im(f)

F{f(e1),· · · , f (en)}

A B f ∈BA

∀u, v ∈A, u 6=v⇒f(u)6=f(v)

f∈ L(E, F )⇐⇒ Ker(f) = {0E}

f∈ L(E, F )k E

k F

A B f ∈BA

∀b∈B, ∃a∈A b =f(a)

Im(f)f∈ L(E, F )⇐⇒ Im(f) = F.

f∈ L(E, F )E F

E F BEE f ∈ L(E, F )

E F f BEF

f E F E F

f E F

nn

E f ∈ L(E, F )

Ker(f)Im(f)

dim(Ker(f)) + dim(Im(f)) = dim(E).

n=dim(E)

F Ker(f)E dim(Ker(f)) 6dim(E)

Im(f)f(e1),· · · , f(en)BE= (e1,· · · , en)E

dim(Im(f)) 6n

k=dim(Ker(f)) r=dim(Im(f)) k+r=n

E k +r

(u1, . . . , uk)Ker(f) (v1, . . . , vr)Im(f)

j∈ {1,· · · , r}vj∈Im(f)u0

j∈E f(u0

j) = vj

B= (u1, . . . , uk, u0

1, . . . , u0

r)E

Bλ1, . . . , λkµ1, . . . , µr

k

X

i=1

λiui+

r

X

j=1

µju0

j= 0E

λiµj

u=

k

X

i=1

λiuiu0=

r

X

j=1

µju0

ju+u0= 0Ef(u+u0) = 0F

f(u+u0) = f(u) + f(u0) = 0Fu∈Ker(f)f(u0)=0F

f(u0) =

r

X

j=1

µjf(u0

j) =

r

X

j=1

µjvj

r

X

j=1

µjvj= 0Fvj

µju0= 0E

u+u0= 0Eu= 0E(u1, . . . , uk)

λj

Bv E

f(v)∈Im(f)v1, . . . , vrβ1, . . . , βr∈

f(v) =

r

X

j=1

βjvj=

r

X

j=1

βjf(u0

j)f(v) = f

r

X

j=1

βju0

j

f

v−

r

X

j=1

βju0

j

= 0F

v−

r

X

j=1

βju0

j

∈Ker(f)α1, . . . , αk∈

v−

r

X

j=1

βju0

j

=

k

X

i=1

αiui

v=

k

X

i=1

αiui+

r

X

j=1

βju0

jB

rang(f) = dim(Im(f))

E∀f∈ L(E, F )dim(Ker(f)) rang(f)

rang(f) = dim(E)−dim(ker(f))

E F f ∈ L(E, F )

E F

E F BEBF

f E F BFf(u)

u E BEu u

dim(E) = n dim(F) = p

XunBEu∈E

YvpBFv∈F

f∈FEf∈ L(E, F )⇐⇒ ∃M∈ M(p, n, )∀u∈E Yf(u)=MXu

M f (BE,BF)

M=Mat(f, BE,BF)

M=Mat(f, BE,BF)

Yf(u)=MXuu∈E i ∈ {1,· · · , p}i

f(u)BFi M Xu

uBE

u∈E

x1

x2

xn

:= Xu

y1

y2

yp

:= Yf(u)

uBEf(u)BFmi,j M

∀i∈ {1,· · · , p}yi=Li(M)

x1

x2

xn

=mi,1x1+mi,2x2+· · · +mi,n xn

M=Mat(f, BE,BF) =

m1,1m1,2· · · · · · m1,n

m2,1· · · · · · · · · m2,n

mi,1mi,2· · · · · · mi,n

mp,1· · · · · · · · · mp,n

←→ yi=mi,1x1+mi,2x2+· · · +mi,n xn

XejjBEn

j1Yf(ej)=M Xej=Cj(M)j M

Yf(ej)

||

M=Mat(f, BE,BF) =

m1,1

m2,1

mp,1

m1,2

mp,2

· · ·

· · ·

m1,j

m2,j

mp,j

· · ·

· · ·

m1,n

mp,n

M MBF(f(e1),· · · , f (en))

f(e1),· · · , f (en)BF

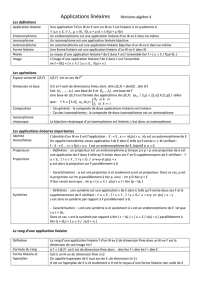

E=3F=2[X]

f∈FE

f((x, y, z)) = (x+y)X0+ (x−z)X1−(y+z)X2

f∈ L(E, F )f E F

∀u= (x, y, z)∈E∀v= (x0, y0, z0)∈E∀λ∈

f(u+v) = f((x+x0, y +y0, z +z0))

= (x+x0+y+y0)X0+ (x+x0−z−z0)X1−(y+y0+z+z0)X2

= (x+y)X0+ (x−z)X1−(y+z)X2

| {z }+ (x0+y0)X0+ (x0−z0)X1−(y0+z0)X2

| {z }

=f(u) + f(v)

f(λu) = f((λx, λy, λz))

= (λx +λy)X0+ (λx −λz)X1−(λy +λz)X2

=λ(x+y)X0+ (x−z)X1−(y+z)X2

| {z }

=λ f(u)

f

Ker(f) = {(x, y, z)∈E|f( (x, y, z) ) = 0F}

=(x, y, z)∈3|(x+y)X0+ (x−z)X1−(y+z)X2= 0 2[X]

3S=

x+y= 0

x−z= 0

−y−z= 0

Ker(f) = V ect( (1,−1,1) ) 3

v= (1,−1,1)

f Im(f) = {v∈F| ∃ u∈E v =f(u)}

=P∈2[X]| ∃ (x, y, z)∈3P= (x+y)X0+ (x−z)X1−(y+z)X2.

f((1,0,0)), f((0,1,0)) f((0,0,1)) 3

Im(f) = V ect(X0+X1, X0−X2,−X1−X2)

(f((1,0,0)), f((0,1,0), f((0,0,1)) )

f((1,0,0)) −f((0,1,0)) + f((0,0,1)) = 0F

Im(f)V ect(X0+X1,−X1−X2)F

(X0, X1, X2)F

P F Im(f)V ect(X0+X1,−X1−X2, P ) = V ect(X0+X1,−X1−X2)

rang(X0+X1,−X1−X2, P ) = 2 P=a0X0+a1X1+a2X2

rang

1 0 a0

1−1a1

0−1a2

= 2.

(C3←C3−a0C1) (C3←C3+ (a1−a0)C2)

rang

1 0 a0

1−1a1

0−1a2

=rang

1 0 0

1−1a1−a0

0−1a2

=rang

1 0 0

1−1 0

0−1a0−a1+a2

2

{a0−a1+a2= 0 Im(f) (X0, X1, X2)F

f E F

v= (x, y, z)∈3E Xv=

x

y

z

f(v)F Yf(v)=

x+y

x−z

−y−z

=

110

1 0 −1

0−1−1

x

y

z

f E F M =

110

1 0 −1

0−1−1

E=2[X]F=f∈FE

f(P) = t7→ (t−1) e

P0(t)−2e

P(t)

e

P P

f(X0)=(t7→ −2 )

f(X1)=(t7→ −t−1 )

f(X2) = ( t7→ −2t)

f∈ L(E, F )f E F

∀P, Q ∈2[X]∀λ∈

f(P+Q) = t7→ (t−1) (

^

P+Q)0(t)−2(

^

P+Q)(t)

=t7→ (t−1) e

P0(t)−2e

P(t) + (t−1) e

Q0(t)−2e

Q(t)

=t7→ (t−1) e

P0(t)−2e

P(t)+t7→ (t−1) e

Q0(t)−2e

Q(t)

=f(P) + f(Q)

f(λP ) = t7→ (t−1)( f

λP )0(t)−2( f

λP )(t)

=t7→ (t−1) λe

P0(t)−2λe

P(t)

=λt7→ (t−1) e

P0(t)−2e

P(t)

=λ f(P)

f

Ker(f) = {P∈E|f(P)=0F}

=a0X0+a1X1+a2X2∈2[X]| ∀t∈,(t−1) (a1+ 2a2t)−2 (a0+a1t+a2t2)=0

=a0X0+a1X1+a2X2∈2[X]| ∀t∈,−(2a0+a1)−(a1+ 2a2)t= 0

Ker(f) = a0X0+a1X1+a2X2∈2[X]2a0+a1= 0

a1+ 2a2= 0 .

2a0+a1= 0

a1+ 2a2= 0 Ker(f)

(X0, X1, X2)E

a2

Ker(f) = a2X0−2a2X1+a2X2∈2[X]a2∈

=a2(X0−2X1+X2)∈2[X]a2∈

=V ect(X0−2X1+X2)

f2[X]v=X0−2X1+X2

f

Im(f)F=

Im(f)

E Im(f)Im(f) = V ect(f(X0), f(X1), f(X2))

(f(X0), f(X1), f(X2))

f(X0)−2f(X1) + f(X2)=0F

Im(f) = V ect(f(X0), f (X1)) F

(t7→ at +b)a, b ∈

F f

E, F, G BE,BF,BG

f∈ L(E, F )g∈ L(F, G)g◦f∈ L(E, G)

Mat(g◦f, BE,BG) = Mat(g, BF,BG)Mat(f, BE,BF)

6

6

7

7

1

/

7

100%