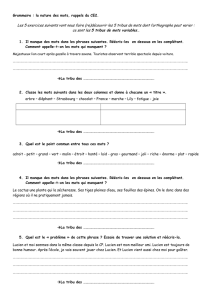

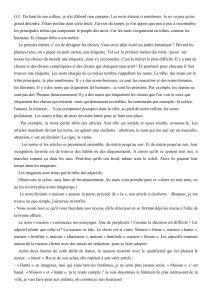

Le lemme des coalitions revisité

Il s’agit de donner une version unifiée du lemme des coalitions vu dans le cours sous plusieurs versions. Pour cela on

va introduire une notion fondamentale : celle d’indépendance de tribus.

1 Tribus : rappels et compléments

Soit Ωun ensemble non vide.

a) Une algèbre (sur Ω)est un ensemble Ade parties de Ω(i.e. A⊂ P (Ω)stable par passage au complémentaire,

stable par réunion finie et contenant Ω.

b) Une tribu ou σ-algèbre (sur Ω) est est un ensemble Ade parties de Ωstable par passage au complémentaire,

stable par réunion dénombrable et contenant Ω.

c) Une sous-tribu d’une tribu Aest simplement une tribu Tvérifiant T⊂A.

d) La donnée d’un ensemble non vide Ω(appelé aussi univers) et d’une tribu Asur Ωdéfinit un espace proba-

bilisable (Ω,A). Les éléments de As’appellent les événements de l’univers.

Définition 1 (Tribus-algèbre)

•Une algèbre est aussi stable par intersection finie en vertu de la formule \

i∈J1,nK

Ai=[

i∈J1,nK

Aiet du fait que

si A ∈Aalors A ∈A.

•Une algèbre est exactement un sous-anneau de l’anneau (P(Ω),∆,∩)où ∆est la différence symétrique

(A∆B=A∩B∪B∩A).

•Si A est une tribu alors ∅∈Aet pour toute famille (Ai)i∈I∈AIindexée par I au plus dénombrable alors

[

i∈I

Ai∈Aet \

i∈I

Ai∈A. De ce fait une tribu est aussi une algèbre.

Remarques

Exemples 1

•La tribu la plus simple que l’on puisse définir sur un ensemble Ωest ∅,Ω: on l’appelle la tribu grossière.

•A contrario la tribu la plus complète est P(Ω).

Une famille quelconque Fde parties de Ωétant donnée , il existe une plus petite (au sens de l’inclusion) tribu

contenant Fet notée σ(F). La tribu σ(F)s’appelle la tribu engendrée par F.

Proposition 1 et définition 2 (Tribu engendrée)

ÐÐÐ

On montre facilement qu’une intersection quelconque de tribus est une tribu et comme il existe toujours une tribu

contenant F(à savoir P(Ω)) on a σ(F) = \

Atribu

F ⊂A

A.

dem :

Exemple 2

La tribu engendrée par A ⊂Ωqu’on note σ(A)à la place de σAest σ(A) = ∅,A,A,Ω.

1

a) Si A1,...,Ansont des tribus sur Ω, on note σ(A1,...,An)la tribu engendrée par F=A1∪ · · · ∪ An.

b) Si A1,...,Ansont des parties de Ω, on note σ(A1, . . . , An)la tribu engendrée par F=A1,...,An.

Définition 3

Dans la suite on considère un espace probabilisable (Ω,A,P); on rappelle que Aest une tribu sur Ωet que Pest une

application de Adans [0,1]telle que :

a) P(Ω) = 1

b) pour toute suite d’événements (An)ndeux à deux incompatibles, la famille (P(An))nest sommable et

P[

n∈N

An=X

n∈N

P(An) (σ-additivité)

Et les propriétés que vérifie P:

i. P(∅) = 0

ii. Si A1,...,Ansont des événements deux à deux incompatibles alors Pn

[

k=1

Ak=

n

X

k=1

P(Ak). En particulier, pour

tout événement A, P(A) = 1−P(A).

iii. Si A et B sont des événements vérifiant A ⊂B alors P(A)¶ P(B)et P(B\A) = P(B)−P(A).

iv. Si A et B sont des événements alors P(A∪B) = P(A) + P(B)−P(A∩B).

v. Sous-additivité finie : si A1, . . . , Ansont des événements alors P(A1∪ · · · ∪ An)¶ P(A1) + · · · +P(An).

vi. Continuité croissante : si (An)nest une suite d’événements croissante pour l’inclusion, alors :

lim

n→+∞P(An) = P[

n∈N

An

vii. Continuité décroissante : si (An)nest une suite d’événements décroissante pour l’inclusion, alors :

lim

n→+∞P(An) = P\

n∈N

An

viii. Sous-additivité dénombrable : soit (An)nune suite d’événements. Alors

P[

n∈N

An¶X

n∈N

P(An)

avec la convention que si la famille (P(An))nn’est pas sommable alors X

n∈N

P(An) = +∞.

On rappelle aussi la définition d’une variable aléatoire discrète :

On appelle variable aléatoire discrète (v.a.) de l’espace probabilisé (Ω,A,P)et à valeurs dans un ensemble E,

toute application X : Ω−→ E

ω7−→ X(ω)

telle que :

a) l’ensemble X(Ω)est au plus dénombrable ;

b) pour tout x∈X(Ω), l’ensemble X−1xest un événement : ∀x∈X(Ω), X−1x∈A.

L’ensemble des valeurs prises par X et noté X(Ω)s’appelle le support de X.

Définition 4 (Variable aléatoire discrète)

Soit X une variable aléatoire à valeurs dans E. Alors l’ensemble σ(X) = X−1(A); A ∈ P (E)est une tribu dite

engendrée par X.

Théorème 2 et définition 5

ÐÐÐ

2

On a Ω=X−1(E)donc Ω∈σ(X); si A ∈ P (E)alors X−1(A) = X−1(A)et donc σ(X)est stable par passage au

complémentaire. Enfin si (An)n∈ P (E)Nalors [

n∈N

X−1(An) = X−1[

n∈N

Anet donc σ(X)est stable par union

dénombrable.

dem :

•Avec la notation probabiliste, on a aussi σ(X) = X∈A; A ∈ P (E)=X−1(A); A ∈ P (X(Ω))puisque

pour tout A ∈ P (E), X−1(A) = X−1(A∩X(Ω)). De ce fait il n’est pas difficile de voir que σ−1(X)est la tribu

engendrée par les événements X=xxdécrivant X(Ω)(utiliser le fait que X(Ω)est au plus dénombrable

et la stabilité d’une tribu par union dénombrable). Et ainsi σ(X)ne dépend que de X et de Ω.

•Plus généralement si Test une tribu de parties de E alors σT(X) = X−1(A); A ∈Test une tribu dite

engendrée par Xet T.

•Si fest une application de E dans F (ensemble non vide), on aura σ(f(X)) = σT(X)où T=P(f−1(F))

vu que ∀A∈ P (F),(f(X))−1(A) = X−1(f−1(A)).

Remarques

Exemple 3 (Fondamental)

Si A ∈Aest un événement alors σ(A) = σ(1A) = ∅,A,A,Ω. En effet 1−1

A(∅) = ∅,1−1

A1=A,1−1

A0=A et

1−1

A0,1=Ω.

Soit X1,...,Xndes variables aléatoires sur un même espace probabilisé avec Xià valeurs dans un ensemble Ei.

On note σ(X1,...,Xn)la tribu engendrée par σ(X1)∪ · · · ∪ σ(Xn)i.e. σ(X1, . . . , Xn) = σ(σ(X1)∪ · · · ∪ σ(Xn)) ou

encore σ(X1,...,Xn) = σ(σ(X1), . . . , σ(Xn)).

Définition 6

Avec les notations précédentes : σ(X1, . . . , Xn) = σ(Y)où Y = (X1, . . . , Xn).

Proposition 3

Ð

Soit A ∈σ(Y): il existe donc B ∈Y(Ω)tel que A =Y−1(B) = ω∈Ω|(X1(ω),...,Xn(ω)) ∈B∩Y(Ω); notons

πiE1× · · · × En−→ Ei

(x1,..., xn)7−→ xi

la i-ième projection de sorte que Xi=πi(Y); comme B∩Y(Ω)est au plus dénombrable

il existe une surjection α:N→B∩Y(Ω)et dès lors

ω∈A⇐⇒ ∃p∈N,(X1(ω),...,Xn(ω)) = α(p)

⇐⇒ ∃p∈N,∀i∈J1, nK,ω∈X−1

i(πi(α(p)) (car Xi=πi(Y))

Et donc A =[

p∈NX1=π1(α(p))∩ · ·· ∩ Xn=πn(α(p)); or chaque Xi=πi(α(p))∈σ(Xi)⊂

par def σ(X1,...,Xn)

et comme σ(X1,...,Xn)est stable par union dénombrable, on a bien A ∈σ(X1,. . . , Xn)i.e. σ(Y)⊂σ(X1,...,Xn).

Réciproquement pour tout i,σ(Xi)⊂σ(Y)car pour tout Ai∈ P (Ei), X−1

i(Ai) = Y−1(E1×· · ·×Ei−1×Ai×Ei+1×· · · En)

et ainsi σ(Y)contient σ(X1)∪ · · · ∪ σ(Xn)et donc aussi, par définition, la tribu engendrée par σ(X1)∪ · · · ∪ σ(Xn)

i.e. σ(X1,...,Xn)⊂σ(Y).

dem :

Soit A1,...,Andes événements de A; la tribu engendrée par A1, . . . , Anest aussi la tribu engendrée par les

v.a. 1A1, . . . , 1Ani.e. σ(A1, . . . , An) = σ(σ(1A1),...,σ(1An)) = σ(σ(A1),...,σ(An)).

Proposition 4

ÐÐÐ

3

Posons F=A1,...,An; on a pour tout i,Ai⊂ F ⊂ σ(F)et donc par définition d’une tribu engendrée,

σ(Ai)⊂σ(F)puis

n

[

i=1

σ(Ai)⊂σ(F)et donc σn

[

i=1

σ(Ai)⊂σ(F)i.e. σ(σ(A1),...,σ(An)) ⊂σ(F).

Puis pour tout i∈J1, nK, Ai∈σ(Ai)⊂

n

[

i=1

σ(Ai)⊂σ(σ(A1),...,σ(An)) et donc F ⊂ σ(σ(A1),...,σ(An)) et donc

on a l’autre inclusion : σ(F) = σ(σ(A1),...,σ(An)).

Conclusion : σ(A1, . . . , An) = σ(F) = σ(σ(A1),...,σ(An)) ; mais σ(Ai) = σ(1Ai)et donc

σ(A1,...,An) = σ(σ(1A1), . . . , σ(1An)) =

def σ(1A1,...,1An).

dem :

Terminons cette partie par la notion de π-système et de classe monotone, deux notions qui vont être cruciales pour

les démonstrations qui vont suivre.

Un π-système est un ensemble Cde parties de Ωstable par intersection finie.

Définition 7 (π-système)

Exemples 4

•Une tribu et une algèbre sont bien évidemment des π-systèmes.

•[a,b];(a,b)∈R2et a¶b∪∅,]a,b];(a,b)∈R2et a¶bet ]− ∞,x];x∈Rsont des π-systèmes.

Une classe monotone est un ensemble Mde parties de Ωstable par union croissante et par différence et qui

contient Ω. Ainsi M⊂ P (Ω),Ω∈M,∀(An)n∈MNvérifiant ∀n∈N, An⊂An+1alors [

n∈N

An∈Met si A, B ∈M

vérifie A ⊂B alors B \A∈Ma.

a. Il est alors d’usage de noter B −A à la place de B \A, l’inclusion A ⊂B étant implicite dans cette notation.

Définition 8 (classe monotone)

Exemples 5

•Une tribu est bien évidemment une classe monotone.

•Si Pet Qsont deux probabilités sur un même espace probabilisable (Ω,A)alors M=A∈A|P(A) = Q(A)est

une classe monotone : en effet on a bien Ω∈Mcar P(Ω) = Q(Ω) = 1; si A,B ∈Mvérifient A ⊂B alors B−A∈M

car P(B−A) = P(B)−P(A) = Q(B)−Q(A)et si (An)∈MNest une suite croissante, par continuité croissante,

P[

n∈N

An=lim

n→+∞P(An) = lim

n→+∞Q(An) = Q[

n∈N

Anet donc [

n∈N

An∈M.

Une partie Ade P(Ω)est une tribu ssi Aest un π-système et une classe monotone.

Proposition 5

Ð

•Le sens =⇒est clair.

•sens ⇐=: soit A⊂ P (Ω)un π-système et une classe monotone, montrons que Aest une tribu :

a) Ω∈Acar Aest une classe monotone;

b) si A ∈Aalors A =Ω−A∈Acar Aest une classe monotone et Ω∈A;

dem :

4

c) il reste la stabilité par réunion dénombrable; on commence par montrer la stabilité par réunion finie : soit

donc A0,...,An∈A; on a A0,...,An∈Aet comme Aest un π-système, on a donc A0∩ · · · ∩ An∈Aet donc

A0∪ · · · ∪ An=A0∩ · · · ∩ An∈A.

Passons maintenant au cas dénombrable : soit (An)∈AN; posons pour tout n∈N, Bn=A0∪· · ·∪An; d’après

ce qu’on vient de voir, Bn∈A; de plus pour tout n, Bn⊂Bn+1et ainsi puisque Aest une classe monotone,

[

n∈N

Bn∈Aet on conclut car [

n∈N

An=[

n∈N

Bn.

2 Indépendance et tribus

On commence par introduire la notion d’indépendance de tribus qui est très simple (pas la peine d’examiner des sous-

ensembles). Une sous-tribu de l’espace probabilisé (Ω,A,P)n’est rien d’autre ici qu’une sous-tribu de A.

Soit A1,...,Andes sous-tribus de l’espace probabilisé (Ω,A,P); on dit que A1,...,Ansont indépendantes ssi

∀(A1,...,An)∈A1× · ·· × An,P \

i∈J1,nK

Ai!=

n

Y

i=1

P(Ai).

Définition 9

Si A1,...,Ansont indépendantes, il en va de même de (Ai)i∈Ioù I est une partie non vide J1, nK: cela vient du

fait que \

i∈I

Ai=\

j∈J1,nK

Bjoù Bj=Ajsi j∈I et Ωsinon. Puis comme chaque Bjest dans Aj, par indépendance

de A1,...,An,P \

j∈J1,nK

Bj!=

n

Y

j=1

P(Bj), ce qui donne P\

i∈I

Ai=Y

i∈I

P(Ai)puisque P(Bj) = 1 si j6∈ I.

Remarque

Soit A1,...,Andes sous-tribus de l’espace probabilisé (Ω,A,P)alors A1,...,Ansont indépendantes ssi

∀(A1,...,An)∈A1× · ·· × An, A1, . . . , Ansont indépendantes.

Théorème 6

ÐÐÐ

•le sens ⇐=est clair;

•supposons A1,...,Anindépendantes et soit (A1,...,An)∈A1× · · · × An; il s’agit de montrer que pour tout

ensemble fini I non vide, P\

i∈I

Ai=Y

i∈I

P(Ai)ce qui découle directement de la remarque ci-dessus.

Ainsi on peut conclure que pour toute partie finie I, P\

i∈I

Ai=Y

i∈I

P(Ai), ce qui par définition signifie l’indé-

pendance de A1,...,An.

dem :

Soit A1,...,Andes événements alors A1,...,Ansont indépendants ssi les tribus σ(A1),...,σ(An)sont indé-

pendantes.

Théorème 7 (Lien avec l’indépendance d’événements)

ÐÐÐ

•sens ⇐=: c’est clair avec le théorème précédent puisque Ai∈σ(Ai).

•sens =⇒: il s’agit de voir que pour tout B1, .. . , Bn∈σ(A1)× · · · × σ(An),Pn

\

i=1

Bi=

n

Y

i=1

P(Bi)soit encore en

dem :

5

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

1

/

13

100%