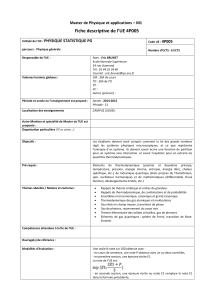

Licence de Physique Année 2019-2020

3`eme année Parcours Physique et Applications & Mécanique

UNIVERSITÉ PARIS SACLAY ORSAY

Cours de Physique statistique

Compilation de textes de A. Abada,G. Abramovici,J.-L. Raimbault et G. Roux

avec l’aimable autorisation des auteurs ; sélection et mise en page : G. Abramovici.

Table des matières

I Physique et probabilités 1

1 Probabilités.................................. 1

a Exemple : jeux aléatoires . . . . . . . . . . . . . . . . . . . . . . . 1

b Dénombrement ............................ 2

2 Systèmes physiques à l’équilibre . . . . . . . . . . . . . . . . . . . . . . . 2

a Équilibre thermodynamique . . . . . . . . . . . . . . . . . . . . . 2

b Autres grandeurs thermodynamiques . . . . . . . . . . . . . . . . 3

c Ordresdegrandeur.......................... 3

d Collisions et libre parcours moyen . . . . . . . . . . . . . . . . . . 4

3 Bilan et objectifs du cours . . . . . . . . . . . . . . . . . . . . . . . . . . 5

4 Exercices ................................... 7

a Marche au hasard (approche par la combinatoire) . . . . . . . . . 7

b Distribution des vitesses d’un gaz . . . . . . . . . . . . . . . . . . 7

c Probabilités conditionnelles . . . . . . . . . . . . . . . . . . . . . 7

d Événements indépendants . . . . . . . . . . . . . . . . . . . . . . 7

II Description microscopique et entropie statistique 9

1 Micro-états et macro-états . . . . . . . . . . . . . . . . . . . . . . . . . . 9

2 Espace des phases et densité d’états . . . . . . . . . . . . . . . . . . . . 10

a Définition de l’espace des phases . . . . . . . . . . . . . . . . . . 10

b Densité d’états dans l’espace des phases . . . . . . . . . . . . . . 11

c Exemples d’espace des phases . . . . . . . . . . . . . . . . . . . . 11

d Surface d’énergie constante . . . . . . . . . . . . . . . . . . . . . 12

e Particules indiscernables . . . . . . . . . . . . . . . . . . . . . . . 12

f Calcul des grandeurs physiques : principe ergodique . . . . . . . . 13

g Variables extensives et intensives . . . . . . . . . . . . . . . . . . 14

3 Entropiestatistique.............................. 14

a Information manquante . . . . . . . . . . . . . . . . . . . . . . . 14

b Définition de l’entropie statistique . . . . . . . . . . . . . . . . . 14

c Propriétés............................... 15

d De l’entropie statistique à l’entropie thermodynamique . . . . . . 16

4 Postulat d’entropie maximale . . . . . . . . . . . . . . . . . . . . . . . . 17

5 Exercices ................................... 19

a Micro-états et macro-états . . . . . . . . . . . . . . . . . . . . . . 19

b Oscillateur harmonique à une dimension . . . . . . . . . . . . . . 19

i

III L’ensemble microcanonique 21

1 Postulatfondamental............................. 21

a Systèmeisolé ............................. 21

b Application du principe d’entropie maximale . . . . . . . . . . . 22

c Densitéd’états ............................ 24

2 Exemple de calcul de la fonction de partition . . . . . . . . . . . . . . . 24

a Lecasdugazparfait......................... 24

b Calcul des grandeurs thermodynamiques . . . . . . . . . . . . . . 25

3 Lois thermodynamiques . . . . . . . . . . . . . . . . . . . . . . . . . . . 26

a Premierprincipe ........................... 26

b Le second principe retrouvé . . . . . . . . . . . . . . . . . . . . . 27

c Du microscopique au macroscopique . . . . . . . . . . . . . . . . 27

d Calcul des variables macroscopiques à l’équilibre thermodynamique 28

e Propriétés de l’entropie . . . . . . . . . . . . . . . . . . . . . . . 29

f Équation d’état du gaz parfait microcanonique . . . . . . . . . . 29

4 Exercices ................................... 31

a Entropie de mélange ; paradoxe de Gibbs . . . . . . . . . . . . . . 31

b Défauts dans les solides . . . . . . . . . . . . . . . . . . . . . . . 32

c Chaîne polymère et force entropique . . . . . . . . . . . . . . . . 33

IV Ensemble canonique 35

1 Distribution et fonction de partition canonique . . . . . . . . . . . . . . 35

a Expérience de deux systèmes en contact thermique . . . . . . . . 35

b Application du principe d’entropie maximale . . . . . . . . . . . 37

2 Entropied’équilibre.............................. 37

a Statistique de Boltzmann . . . . . . . . . . . . . . . . . . . . . . 37

b Distribution de Maxwell . . . . . . . . . . . . . . . . . . . . . . . 38

c Cas de particules indépendantes . . . . . . . . . . . . . . . . . . . 39

3 Potentiel thermodynamique . . . . . . . . . . . . . . . . . . . . . . . . . 39

4 Théorème d’équipartition de l’énergie . . . . . . . . . . . . . . . . . . . . 40

5 Calcul de la pression en théorie cinétique . . . . . . . . . . . . . . . . . . 41

6 Étude d’un gaz diatomique . . . . . . . . . . . . . . . . . . . . . . . . . 43

a Hamiltonien et degrés de libertés . . . . . . . . . . . . . . . . . . 44

b Capacité calorifique d’un gaz de molécules diatomiques . . . . . . 44

7 Stabilité thermodynamique . . . . . . . . . . . . . . . . . . . . . . . . . 46

a Minimisation de l’énergie libre . . . . . . . . . . . . . . . . . . . 46

b Fluctuations en énergie . . . . . . . . . . . . . . . . . . . . . . . 46

c Équivalence des ensembles . . . . . . . . . . . . . . . . . . . . . . 48

8 Exercices ................................... 49

a Système d’oscillateurs harmoniques quantiques unidimensionnels 49

b Vidange d’un réservoir . . . . . . . . . . . . . . . . . . . . . . . . 49

c Dipôles classiques dans dans un champ extérieur . . . . . . . . . 50

d Rotation des gaz diatomiques . . . . . . . . . . . . . . . . . . . . 51

e Système à deux niveaux dans l’ensemble canonique . . . . . . . . 52

ii

V Ensemble grand-canonique 53

1 Entropie d’équilibre et grande fonction de partition . . . . . . . . . . . . 53

2 Grand potentiel thermodynamique . . . . . . . . . . . . . . . . . . . . . 55

3 Le gaz parfait dans le cadre grand-canonique . . . . . . . . . . . . . . . 56

4 Densité spatiale d’un gaz parfait en présence d’un champ extérieur . . . 56

5 Autresensembles............................... 57

a Relation de Gibbs-Duhem . . . . . . . . . . . . . . . . . . . . . . 58

b Identité faible de Gibbs . . . . . . . . . . . . . . . . . . . . . . . 58

6 Exercices ................................... 59

a Adsorption d’un gaz à la surface d’un solide . . . . . . . . . . . . 59

b Équilibrechimique .......................... 59

c Compressibilité et fluctuations du nombre de particules . . . . . 61

VI Coefficients de transport 63

1 Relations entre flux et gradients : lois macroscopiques . . . . . . . . . . . 63

a Notion d’équilibre thermodynamique local . . . . . . . . . . . . . 63

b Définition des coefficients de transport . . . . . . . . . . . . . . . 64

c Équations de transport . . . . . . . . . . . . . . . . . . . . . . . . 64

2 Évaluation des coefficients de transport par une approche microscopique 67

a Paramètres microscopiques pertinents . . . . . . . . . . . . . . . 67

b Retour sur le libre parcours moyen . . . . . . . . . . . . . . . . . 67

c Constante d’auto-diffusion . . . . . . . . . . . . . . . . . . . . . . 67

d Conductivité thermique . . . . . . . . . . . . . . . . . . . . . . . 68

e Viscositédynamique ......................... 69

f Relations entre coefficients . . . . . . . . . . . . . . . . . . . . . . 69

g Limites de l’approche . . . . . . . . . . . . . . . . . . . . . . . . 69

3 Exercices ................................... 71

a Marche au hasard (équation maîtresse) . . . . . . . . . . . . . . . 71

b Conductivité électrique σet loi de Wiedemann-Franz . . . . . . . 71

c Suspension brownienne . . . . . . . . . . . . . . . . . . . . . . . . 72

d Coefficient Seebeck S, principe du thermocouple . . . . . . . . . 73

VII Statistiques quantiques 75

1 Systèmes quantiques sans interaction . . . . . . . . . . . . . . . . . . . . 75

2 Statistiques classique et quantique . . . . . . . . . . . . . . . . . . . . . 77

a Statistique de Fermi-Dirac . . . . . . . . . . . . . . . . . . . . . . 77

b Statistique de Bose-Einstein . . . . . . . . . . . . . . . . . . . . . 77

iii

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

41

41

42

42

43

43

44

44

45

45

46

46

47

47

48

48

49

49

50

50

51

51

52

52

53

53

54

54

55

55

56

56

57

57

58

58

59

59

60

60

61

61

62

62

63

63

64

64

65

65

66

66

67

67

68

68

69

69

70

70

71

71

72

72

73

73

74

74

75

75

76

76

77

77

78

78

79

79

80

80

81

81

82

82

83

83

84

84

85

85

86

86

87

87

88

88

89

89

90

90

91

91

92

92

93

93

94

94

95

95

96

96

97

97

98

98

99

99

100

100

101

101

102

102

103

103

104

104

105

105

106

106

107

107

108

108

109

109

110

110

111

111

112

112

113

113

114

114

115

115

116

116

117

117

118

118

119

119

120

120

121

121

122

122

123

123

124

124

125

125

126

126

127

127

128

128

129

129

130

130

1

/

130

100%