Perception, Décision et Attention Visuelles

1

Perception, Décision et Attention Visuelles:

Ce que les potentiels évoqués nous apprennent sur le

fonctionnement du système visuel.

Rufin VanRullen1 et Simon J. Thorpe2

1 Caltech, Div. of Biology, Pasadena, CA (USA)

2 Centre de Recherche Cerveau et Cognition, Toulouse (France)

Résumé:

La vitesse à laquelle le système visuel humain peut analyser une scène visuelle

est encore aujourd’hui un sujet de controverse. Pourtant, cette donnée est

fondamentale pour appréhender la complexité des mécanismes neuronaux sous-

jacents. En contrôlant systématiquement les propriétés physiques des stimuli

grâce à un paradigme de “tâche duale”, nous avons pu isoler dans le temps les

composantes des potentiels évoqués visuels reflétant les traitements de bas

niveau (sensoriels, dès 75 millisecondes post-stimulus) et de haut-niveau (liés à

la décision du sujet, à partir de 150 millisecondes post-stimulus). D’un point de

vue théorique, ce résultat suggère que ce type de traitement visuel peut être basé

sur la propagation “feed-forward” à travers le système visuel d’une seule vague

de potentiels d’action portant l’information dans sa structure spatio-temporelle.

Dans ce contexte, l’attention visuelle serait implémentée par un avantage

temporel pour l’objet attendu ou ses caractéristiques. Les données

expérimentales supportent cette interprétation.

Introduction.

L’extraordinaire efficacité du système visuel humain, et des systèmes visuels naturels en

général, est implicitement démontrée par la plupart de nos activités quotidiennes, comme

par exemple le simple fait de pouvoir lire ce chapitre, de conduire un véhicule, ou de

regarder la télévision. La rapidité avec laquelle notre système visuel réalise ces tâches est

cependant moins bien appréhendée. Bien qu’il nous semble pouvoir interpréter une

nouvelle image se présentant à nos yeux de façon quasi-instantanée, les processus

neuronaux qui mènent à cette interprétation nécessitent un temps de traitement non

négligeable. Les potentiels évoqués visuels constituent un outil fascinant pour évaluer la

durée de ces processus, car ils peuvent refléter l’activité neuronale avec une précision

temporelle de l’ordre de quelques millisecondes.

Les résultats obtenus en potentiels évoqués par Thorpe et al (1996), détaillés dans le

chapitre précédent, démontrent que l’activité électrique évoquée par un stimulus visuel

diffère environ 150 ms après la stimulation selon que ce stimulus est une cible pour la tâche

(une image contenant un animal) ou un distracteur (image ne contenant pas d’animal). Ces

données sont corroborrées par d’autres études qui suggèrent que certaines composantes du

potentiel évoqué après 150 ms (par exemple une négativité présentant un pic à 170ms,

appelée N170) peuvent être spécifiques à la présence d’un visage (Bötzel et al, 1995;

2

Jeffreys, 1996; Schendan et al, 1998) ou d’autres objets (Rossion et al, 2000) dans la scène

visuelle. D’autres techniques expérimentales, telles les enregistrements intracrâniaux

(réalisés chez des sujets épileptiques humains; Allison et al, 1999) ou la magnéto-

encéphalographie (MEG, qui présente une résolution spatiale bien supérieure à celle de

l’EEG; Halgren et al, 2000), ont permis de localiser cette activité neuronale dans la partie

ventrale du lobe temporal humain (le gyrus fusiforme, équivalent du cortex inféro-temporal

du singe).

Cependant un certain nombre d’études plus récentes, s’intéressant en particulier au

traitement des images de visages, ont rapporté des effets de haut niveau (i.e. liés à la

catégorie du stimulus) bien plus précoces, pouvant apparaître avant 100 ms post-stimulus

(Seeck et al, 1997; George et al, 1997; Debruille et al, 1998; Mouchetant-Rostaing et al,

2000a,b). Les plus extrêmes suggèrent que la reconnaissance des visages (Seeck et al,

1997), ou la discrimination du genre des visages (Mouchetant-Rostaing et al, 2000a)

pourraient être réalisées avant même 50 ms post-stimulus. Ce résultat est particulièrement

étonnant, si l’on considère que ces latences sont parmi les plus courtes qui peuvent être

observées en potentiels évoqués, et ont été identifiées comme reflétant l’activation du

cortex visuel primaire (Clark et al, 1995; Clark et Hillyard, 1996). Sur le plan théorique, ces

résultats, s’ils étaient validés, auraient des conséquences dramatiques. Le système visuel

humain serait en effet capable d’analyser en détail une scène visuelle après seulement une,

voire deux étapes synaptiques à la sortie de la rétine. C’est-à-dire que le cortex visuel

primaire, dont les cellules sont connues pour leurs réponses à des stimulations simples telles

que des barres orientées (Hubel et Wiesel, 1959, 1968) pourrait en fait représenter

explicitement la catégorie d’un stimulus complexe!

Une autre possibilité toutefois, serait que ces différences précoces reflètent en réalité des

propriétés sensorielles (de bas-niveau) des stimuli présentés. Ces propriétés sont en général

difficiles à contrôler systématiquement. Toute différence sensorielle entre 2 catégories de

stimuli (par exemple, au niveau des fréquences spatiales) ou 2 conditions expérimentales

(par exemple, l’état d’éveil ou de concentration des sujets) peut se retrouver dans les

potentiels évoqués, qui ne sont qu’une moyenne de l’activité électrique sur plusieurs

centaines d’essais. Cette différence néammoins ne serait pas suffisante pour permettre la

catégorisation systématique de chaque stimulus présenté.

Afin de tester cette hypothèse, il est nécessaire de pouvoir séparer les traitements reflétant

les propriétés sensorielles des stimuli utilisés, et les traitements reflétant les propriétés de

haut niveau de ces stimuli, c’est-à-dire non seulement leur catégorie, mais également leur

statut cible/non-cible relativement à la tâche effectuée. L’approche que nous présentons ici

a permis de réaliser cette séparation grâce à l’introduction d’un nouveau type de paradigme

expérimental: le paradigme de tâche duale (“alternating dual-task paradigm”, VanRullen et

Thorpe, 2001a,b).

Séparation des processus visuels de haut et de bas niveau.

Dans l’une des conditions expérimentales, répliquant l’expérience de Thorpe et al (1996),

16 sujets assis en face d’un écran d’ordinateur devaient relâcher un bouton si l’image

naturelle qui était flashée pendant 20 ms contenait un animal. Les potentiels évoqués

visuels étaient enregistrés simultanément sur 32 électrodes distribuées sur la surface du

scalp. Dans l’autre condition, les mêmes 16 sujets devaient répondre aux images de la

catégorie “moyens de transport”. Dans chaque tâche, la moitié des images non-cibles

3

appartenaient à la catégorie cible de l’autre tâche (i.e. véhicules dans la tâche “animal”, et

animaux dans la tâche “moyens de transport”) et l’autre moitié était constituée de

distracteurs (i.e. de scènes ne contenant ni animal, ni véhicule). Pour comparer ces 2 tâches

dans les mêmes conditions, 10 séries de 96 essais étaient réalisées en alternance pour

chaque tâche (soit 20 au total). Des images d’une même catégorie (ayant donc des

propriétés sensorielles identiques) pouvaient donc être traitées comme cible ou non-cible

dans différentes séries. De plus, la moitié des scènes de la catégorie “véhicule” étaient des

images de voitures, permettant d’effectuer des comparaisons à l’intérieur d’une même

catégorie. Les images dans chaque catégorie étaient choisies de manière à être très diverses.

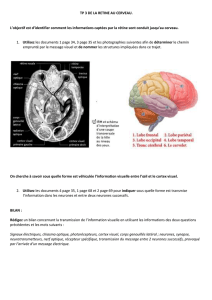

La figure 1 montre 2 exemples de séquences d’images présentées à un sujet. Les images

d’animaux pouvaient contenir des mammifères, mais également des oiseaux, poissons ou

insectes. Les images de véhicules contenaient aussi bien des voitures que des camions,

trains, bateaux, avions, hélicoptères ou montgolfières. La taille, le nombre ou la position

des cibles dans chaque scène était imprévisible. Les scènes distracteurs étaient également

très variées, pouvant contenir des paysages, des arbres, ou des routes et bâtiments, etc…

Figure 1. A gauche: 2 séquences de 12 images présentées dans les tâches de catégorisation “animal” et

“vehicule”, avec les temps de réaction du sujet le plus rapide (temps de réaction médians 288 ms dans la tâche

animal et 293 ms dans la tâche véhicule, pourcentages correct respectifs 92.7% et 92.6%). A droite: activités

différentielles entre les images cibles et les images distracteurs (non inclus les images cibles de l’autre tâche) dans

les 2 tâches de catégorisation. Grandes moyennes pour les 16 sujets, électrodes regroupées selon la position:

frontales, centrales, pariétales, occipitales.

Les résultats comportementaux (VanRullen et Thorpe, 2001b) ne mettent en évidence

aucune différence de performance entre les 2 tâches de catégorisation. Les pourcentages

corrects sont en moyenne autour de 94%, et les temps de réaction médians légèrement

4

supérieurs à 350 ms. De plus, le taux de catégorisation est au-dessus du niveau de la

chance avant même 250 ms, une valeur étonnamment courte, qui constitue une limite

supérieure pour la durée des traitements perceptuels et le commencement de la décision du

sujet. Les potentiels évoqués peuvent renforcer encore ces contraintes, et définir

précisément le décours temporel des différents mécanismes mis en jeu.

Dans chaque tâche, on observe une forte activité différentielle entre cibles et distracteurs,

plus apparente sur les électrodes frontales, après environ 150ms (figure 1), correspondant à

l’activité différentielle rapportée précédemment pour une tâche de catégorisation

“animal/non-animal” (Thorpe et al, 1996). Au même moment les activités différentielles

sont relativement prononcées pour chaque site d’enregistrement (central, pariétal, occipital),

ce qui indique un effet de grande magnitude. De plus, ces résultats sont reproduits ici pour

une catégorie cible différente (“véhicule”). Il faut souligner ici que puisque cette catégorie

est clairement une catégorie “artificielle”, il ne semble pas y avoir pour ce type de

traitement visuel rapide d’avantage pour les stimuli “naturels” ou biologiquement pertinents

(VanRullen et Thorpe, 2001b).

Outre cette forte activité différentielle entre cibles et distracteurs démarrant après 150 ms,

on observe également (Figure 1) une activité plus précoce, et plus faible, environ 75 ms

après la présentation du stimulus. Dans le contexte de la distinction faite précédemment

entre traitements sensoriels de bas-niveau, et traitements décisionnels de haut niveau,

comment interpréter chacune de ces différences?

Il est possible de comparer les différentes catégories visuelles utilisées ici (animaux,

véhicules, répartis en 2 sous-catégories: voitures et autres véhicules) de manière

indépendante de la tâche réalisée. Pour chaque sujet, les potentiels évoqués par des images

d’une même catégorie sont moyennés indépendamment du statut cible/non-cible de ces

images (en accordant le même poids relatif à chaque condition lors du calcul de cette

moyenne). Ces potentiels évoqués spécifiques à une catégorie visuelle, et indépendants des

conditions expérimentales, sont ensuite comparés 2 à 2. Les activités différentielles

correspondantes sont représentées figure 2. Le traitement évoqué par 2 catégories visuelles

diverge après environ 75-80ms. Ces différences sont clairement indépendantes de la tâche

réalisée, et du statut des images dans cette tâche. En particulier, les éléments des catégories

“voiture” et “autres véhicule” ont exactement le même statut dans les 2 tâches: cibles dans

la tâche “véhicule”, non-cibles dans la tâche “animal”. La différence ne peut donc être

attribuée qu’à des propriétés visuelles intrinsèques (de bas niveau) de ces catégories.

Inversement, quelle est l’activité évoquée spécifiquement par la tâche de catégorisation

elle-même, i.e. quelle est la différence entre le traitement des images cibles et non-cibles,

toutes propriétés sensorielles des stimuli étant égales par ailleurs? L’utilisation du

paradigme de tâche duale permet de répondre à cette question: on peut regrouper les images

d’une catégorie visuelle lorsqu’elles sont cibles pour la tâche, et les comparer aux images

de cette même catégorie lorsqu’elles sont non-cibles. Chaque activité différentielle

représentée dans la figure 3 montre ce type de comparaison, pour une catégorie visuelle

donnée. Quelle que soit la catégorie considérée, cette différence d’activité entre images

cibles et non-cibles de la même catégorie visuelle apparait après environ 150 ms, et suit un

décours temporel similaire.

5

Figure 2. Effets de la catégorie visuelle. Chaque courbe représente la différence d’activité entre 2 catégories

visuelles données. Les essais cibles et non-cibles ont le même poids relatif pour chaque comparaison. a. Animaux

vs véhicules, pour différents groupes d’électrodes (occipital, pariétal, central, frontal). Par souci de simplicité,

l’erreur standard de la moyenne est représentée uniquement pour les électrodes pariétales. b. Animaux vs voitures.

c. Animaux vs autres véhicules. d. Voitures vs. autres véhicules. Dans chaque cas la différence d’activité évoquée

par les catégories visuelles correspondantes apparait significativement après 75-80 ms.

Figure 3. Effets liés à la décision du sujet. Chaque courbe représente la différence d’activité électrique entre les

essais cible et non-cible pour une même catégorie d’images. a. Essais cibles vs non-cibles pour les images

d’animaux et de véhicules regroupées, et pour different groupes d’électrodes. Par souci de simplicité, l’erreur

standard de la moyenne est représentée uniquement pour les électrodes frontales. b. Animaux en tant que cible vs.

animaux en tant que non-cible. c. Véhicules en tant que cible vs véhicules en tant que non-cible. d. Véhicules

autres que voitures en tant que cible vs en tant que non-cible. e. Voitures en tant que cible vs en tant que non-cible.

Dans chaque cas l’activité evoquée par les cibles diffère significativement de celle évoquée par les non-cibles

après environ 150-160 ms. Cette activité est indépendante de la catégorie visuelle impliquée, mais corrélée avec le

fait que les sujets génèrent ou inhibent une commande motrice, c’est-à-dire avec la décision des sujets.

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

1

/

23

100%