APPRENTISSAGE, MODÉLISATION ET COMMANDE : QUELQUES

APPRENTISSAGE, MODÉLISATION ET COMMANDE :

QUELQUES PRINCIPES ET APPLICATIONS

Gérard DREYFUS, IEEE Fellow

Laboratoire Signaux, Modèles, Apprentissage (SIGMA lab)

ESPCI-ParisTech

10 rue Vauquelin - 75005 PARIS

Tél : 01 40 79 45 41

[email protected] - http://www.neurones.espci.fr

POUR QUOI FAIRE ?

•Réaliser des modèles ou des méta-modèles prédictifs non linéaires à partir de

données.

•Incorporer dans le modèle des connaissances avérées chaque fois que cʼest

possible (modélisation semi-physique).

•Réaliser des classifieurs si nécessaire (diagnostic, …).

•Réaliser des lois de commande non linéaires.

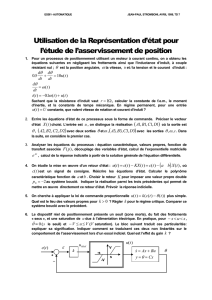

LA GÉNÉRALISATION

Complexité du modèle

Erreur de modélisation

sur l’ensemble d’apprentissage

sur un ensemble

de données indépendant

de l’ensemble d’apprentissage

Meilleur modèle

compte tenu des données disponibles

Modèles ignorants Modèles stupides

(surajustés)

Polynôme :

POURQUOI LES RÉSEAUX DE NEURONES ?

Approximation universelle parcimonieuse

Le réseau calcule une combinaison

linéaire des sorties des neurones

cachés, qui sont des fonctions non

linéaires des variables :

Un neurone de sortie

linéaire

NC neurones

cachés + 1 “biais”

n variables

+ 1 “biais”

....

1x1x2

0Nc

Nc + 1

g (x, θ)

xn

....

1

ÉLÉMENTS DE LA MÉTHODOLOGIE DE CONCEPTION

•Collecte des données (si possible selon un plan dʼexpériences).

•Sélection des variables pertinentes et élimination des variables corrélées : méthode

de la variable sonde.

•Apprentissage : optimisation dʼune fonction de coût convenablement choisie à

lʼaide de méthodes dʼoptimisation non linéaire efficaces (BFGS, Levenberg-

Marquardt, gradient conjugué, …).

•Sélection de la complexité du modèle : estimation de la capacité de généralisation

par validation croisée, leave-one-out, ou leave-one-out virtuel (économe en temps

de calcul).

•Estimation dʼintervalles de confiance sur la prévision.

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

41

41

42

42

43

43

44

44

45

45

46

46

47

47

1

/

47

100%

![Découverte d un nouveau centre cérébr[...]](http://s1.studylibfr.com/store/data/001261824_1-044b689d1e2faad91148811640c2eb34-300x300.png)