fichier doc

Comparaison méthodes de recherche de minimum local

Mickaël SAUVAGE Mémoire de mathématiques Page 1 sur 13

Formation d'Ingénieur – Maître Formation continue

Université Paris Sud

Nom de l'auditeur : Mickaël SAUVAGE

Dates : 07 juillet 2003

Libellé du projet :

Comparaison de deux méthodes de recherche de minimum local :

Méthode du gradient - Méthode du gradient conjugué

Nombre de pages :

13

Notes du destinataire :

MEMOIRE DE MATHEMATIQUES

Comparaison méthodes de recherche de minimum local

Mickaël SAUVAGE Mémoire de mathématiques Page 2 sur 13

Sommaire

INTRODUCTION ................................................................................................................................................. 3

1. LA METHODE DU GRADIENT .................................................................................................................... 4

2. LA METHODE DU GRADIENT CONJUGUE ............................................................................................. 5

3. COMPARAISON DES DEUX METHODES AVEC MATLAB................................................................... 6

3.1. DESCRIPTION DE LA FONCTION UTILISEE ....................................................................................................... 6

3.2. LE PROGRAMME POUR LA METHODE DU GRADIENT ....................................................................................... 8

3.3. LE PROGRAMME POUR LA METHODE DU GRADIENT CONJUGUE .................................................................... 10

CONCLUSIONS ................................................................................................................................................. 13

Comparaison méthodes de recherche de minimum local

Mickaël SAUVAGE Mémoire de mathématiques Page 3 sur 13

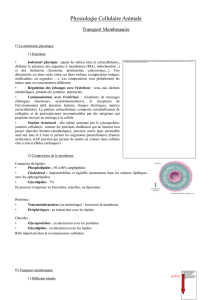

Introduction

La recherche d'un minimum local sur une fonction est très utilisés pour trouver des

solutions permettant de minimiser une erreur. La phase d'apprentissage supervisé d'un réseau

de neurones est un cas concret d'application nécessitant de faire des recherches sur le

minimum d'une fonction. Dans le cas du réseau de neurone, il faut effectuer des calculs pour

optimiser la valeur de chacun des points des entrées de chaque neurone et la masse de calcul

nécessaire peut devenir très rapidement importante. Il est donc nécessaire d'avoir des outils de

calcul qui soient les plus rapides possible.

Je vais comparer deux méthodes de recherche de minimum local d'une fonction : la

première méthode va utiliser l'algorithme du gradient et la seconde, l'algorithme du gradient

conjugué.

Ces deux méthodes sont des méthodes itératives et nous allons comparer la vitesse

avec laquelle ces méthodes convergent et le nombre d'itérations nécessaires pour trouver la

solution avec une erreur déterminée.

Comparaison méthodes de recherche de minimum local

Mickaël SAUVAGE Mémoire de mathématiques Page 4 sur 13

1. La méthode du gradient

Cette méthode est la plus simple à mettre en œuvre pour trouver un minimum local sur

une fonction. Comme son nom l'indique, on utilise le gradient en un point donné de courbe

pour donner la direction de la descente. La distance entre le point xk et le point xk+1 est calculé

en fonction de la valeur du gradient gk et d'un pas déterminé à l'avance .

Le pas a une influence très importante sur la vitesse de convergence de la méthode

du gradient. Plus est grand, plus la méthode convergera rapidement. Cependant, si est trop

grand il y a un risque de divergence de la suite.

kkk gxx .

1

Comparaison méthodes de recherche de minimum local

Mickaël SAUVAGE Mémoire de mathématiques Page 5 sur 13

2. La méthode du gradient conjugué

La méthode du gradient conjugué utilise, comme son nom l'indique, le gradient de la

fonction pour déterminer la direction de la recherche du minimum locale. C'est une méthode

itérative tout comme la méthode du gradient, mais elle utilise un algorithme pour que la

direction de recherche soit optimisée. Cette direction est déterminée en fonction du gradient

au point Xn mais aussi en fonction du gradient du point précédent Xn-1, c'est pour cette

raison que l'on parle de gradient conjugué.

Pour la première itération, la direction choisie correspond à la valeur négative du

gradient :

Pour réduire le nombre d'itération, le point Xn+1 est choisi en trouvant le minimum de

la fonction dans la direction déterminée précédemment.

Une méthode pour trouver la valeur minimale de f(xk+1) est de calculer l'ensemble des

points décrit par l'équation ci dessus pour k [0 ; 1] avec un pas déterminé. On calcul

ensuite l'ensemble des f(xk+1). On conserve finale xk+1 permettant d'obtenir le minimum de

f(xk+1).

La direction suivante est déterminée en fonction de la direction précédente (conjugué

de l'une par rapport à l'autre). La méthode la plus courante consiste à combiner la direction

précédente avec le calcul du gradient au point xk+1 pour calculer la nouvelle direction :

Il existe plusieurs versions de la méthode du gradient conjugué, elles se distinguent par

la manière dont la constante pk est calculée.

Voici la méthode de calcul de Fletcher-Reeves :

Pk représente alors le rapport entre la norme au carré du gradient actuel et la norme au

carré du gradient précédent.

Voici la méthode de calcul de Polak-Ribiére :

00 gd

kkkk dxx .

1

1

.

kkkk dpgd

11.

.

k

T

k

k

T

k

kgg gg

P

11

1

..

k

T

k

k

T

k

kgg gg

P

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

1

/

13

100%