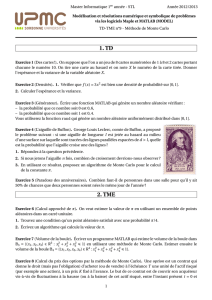

Université Paris Dauphine

Département MIDO

Master 1 – Méthodes de Monte Carlo

2017–2018

Projet R–Python

Méthodes de Monte Carlo

stoehr@ceremade.dauphine.fr

Préliminaires.

— Vérifiez que vous et votre binôme êtes inscrit-e-s sur la plateforme MyCourse (accessible

via l’ENT) au cours M1 Maths_2017-2018_Méthodes de Monte Carlo_Julien Stoehr.Au-

cune remise de projet ne sera acceptée par e-mail! La procédure de dépôt se fera obliga-

toirement sur la plateforme MyCourse.

— Renseignez, avant le 4 décembre, votre nom et celui de votre binôme à l’adresse : https:

//goo.gl/forms/c38mPnXCRzBQowJ83.

À rendre avant le 08 janvier 2018

Consignes

— Sont à rendre : un rapport au format .pdf et un script contenant l’ensemble des codes

utilisés. Les différents documents peuvent être archivés au format .zip.

—Chaque jour de retard sera pénalisé d’un point.

Le rapport :

— il contiendra les réponses aux différentes questions ainsi que des commentaires sur les

expériences menées. Une rédaction soignée et concise sera appréciée.

— Les graphiques doivent être soigneusement annotés et présentés (titre, couleur, légendes,

...).

— Vous pourrez ajouter du pseudo-code pour expliquer les différents algorithmes. Néan-

moins, il est strictement interdit de copier-coller les vrais codes dans le rapport.

Le code :

— les languages autorisés sont Ret Python.

— Les codes doivent être bien commentés. Il est possible qu’une explication orale de votre

travail vous soit demandée.

— Les codes doivent être optimisés (vectorisés) un minimum pour utiliser les spécificités du

language.

— Les codes fournis doivent s’exécuter sans erreurs et permettre de reproduire l’intégralité

des résultats présentés dans le rapport.

1

Projet Méthodes de Monte Carlo

Exercice.

Objectifs. On considère X=(X1,X2) une variable aléatoire de R2admettant une densité f1pro-

portionnelle à

˜

f1(x1,x2)=expÃ−1

2(x2

1

4+x2

2)!1{|x2|≤1},

et Y=(Y1,Y2) une variable aléatoire de R2admettant une densité f2proportionnelle à

˜

f2(y1,y2)=©cos2(y1)+0.5sin2(3y2)cos4(y1)ªexpÃ−1

2(y2

1

4+y2

2)!.

Les objectifs de ce projet sont :

1. simuler des réalisations suivant les lois de densités f1et f2,

2. estimer par des méthodes de Monte Carlo et des méthodes de Monte Carlo par Chaîne de

Markov des quantités de la forme E[h(X)]et E[h(Y)]pour des fonctions hparticulières.

Partie I –Algorithme du rejet

On souhaite simuler suivant une loi de densité fdéfinie sur R2. On peut écrire f, pour tout x∈R2, sous

la forme, f(x)=c˜

f(x), avec cune constante positive. On suppose qu’il existe existe une densité get une

constante M≥0 telle que pour tout x∈R2,

˜

f(x)≤M g (x).

1. Justifiez que pour obtenir une réalisation suivant la loi de densité f, on peut appliquer l’algorithme

du rejet à ˜

f.

2. Trouvez des constantes M1,M2, et une densité gtelles que, pour tout x=(x1,x2)∈R2

˜

f1(x)≤M1g(x) et ˜

f2(x)≤M2g(x).

3. En déduire une méthode de simulation suivant les densités f1et f2.

4. Comparer les densités marginales empiriques d’un échantillon suivant la loi de densité f1avec les

densités marignales théoriques de f1.

Indication. On pourra calculer la constante de normalisation de f1en fonction de la fonction de

répartition Φde la loi normale N(0,1).

Partie II –Retour sur les méthodes de réduction de variance

Pour chacune des méthodes ci-dessous, vous proposerez une expérience de Monte-Carlo permettant

d’étudier la convergence en fonction du nombre de réalisations de la loi de densité f1ou f2.

2

Projet Méthodes de Monte Carlo

Premier cas. On souhaite calculer pour X=(X1,X2) de densité f1,

p=P£eX1+eX2≥5¤

1. Proposer une estimation de ppar :

(a) la méthode de Monte Carlo classique,

(b) la méthode des variables antithétiques,

(c) la méthode de la variable de contrôle,

Indication. On pourra considérer PνhpeX1+X2≥Ki.

(d) la méthode de stratification avec allocation proportionnelle.

Indication. On pourra partionner suivant x1en utilisant le principe utilisé dans le TP n°3.

2. Commenter les différents résultats obtenus.

Second cas. On souhaite calculer

I=ZR2cos(y1y2)sin(y1)exp©sin(y1+y2)ªf2(y1,y2)dy1dy2.

3. Proposer une estimation de Ipar :

(a) la méthode de Monte Carlo classique,

(b) la méthode des variables antithétiques.

4. Commenter les différents résultats obtenus.

Partie III –Recyclage dans l’algorithme du rejet

L’algorithme d’acceptation-rejet génère Nréalisations suivant la densité instrumentale g, pour en ac-

cepter T,¡X(1),...,X(T)¢, distribuées suivante la loi d’intérêt f, et en rejeter N−T,¡Z(1),...,Z(N−T)¢. Dans

la suite, on considère que le nombre de réalisations Nsuivant gest fixé alors que Test une quantité

aléatoire. On suppose de plus que get Msont telles que ©x∈supp(f) : f(x)=M g (x)ªest de mesure

nulle.

1. Donner la densité des Z(i),i=1,..., N−T, conditionnellement à T.

Dans la suite, on raisonne conditionnellement à T=t(t6=0 et t6= N). On considère les suites ¡X(1),...,X(t)¢

et ¡Z(1),...,Z(N−t)¢et on définit, lorsque cela a un sens,

δ1=1

t

t

X

i=1

h³X(i)´, et δ2=1

N−t

N−t

X

i=1

h³Z(i)´(M−1)f¡Z(i)¢

M g ¡Z(i)¢−f¡Z(i)¢.

2. Montrer que δ1et δ2sont des estimateurs sans biais de Ef[h(X)].

3. Montrer que les variables aléatoires δ1et δ2sont indépendantes et déterminer la variance de δ(α)=

αδ1+(1−α)δ2.

3

Projet Méthodes de Monte Carlo

4. En déduire un choix optimal de α,α?, et expliquer comment s’opère l’approximation de α?en pra-

tique.

5. Proposer une expérience de Monte-Carlo comparant, en fonction de N, la convergence de δ1,δ2et

α?δ1+(1−α?)δ2(attention au choix de Met g) vers p=P£eX1+eX2≥5¤:

(a) pour X=(X1,X2) de densité f1;

(b) pour X=(X1,X2) de densité proportionnelle à ˜

f3(x1,x2)=expn−1

2³x2

1

4+x2

2´o(1{|x2|≤1}+0.5).

(c) Commenter les différents résultats obtenus. Commenter notamment les performances de ces

estimateurs à nombre de simulations fixé avec les estimateurs à taille d’échantillon fixé.

Partie IV –Algorithme de Metropolis–Hastings

L’indépendance n’est pas une propriété nécessaire pour l’approximation de fonctionnelles de la forme

E[h(X)]avec Xune variable aléatoire de loi de densité f. Le théorème ergodique nous permet, en effet,

d’élargir la loi des grands nombres au cas des chaînes de Markov, ¡x(t)¢t≥1irréductibles, apériodiques et

de loi stationnaire de densité f, au sens où

1

T

T

X

t=1

h¡x(t)¢p.s.

−→

T→+∞

E[h(X)]. (1)

Les méthodes de Monte Carlo par chaîne de Markov sont particulièrement utiles lorsque la loi station-

naire n’est connue qu’à une constante de normalisation près.

Un exemple de construction générique de chaîne de Markov vérifiant ces propriétés est l’algorithme de

Metropolis–Hastings indépendant. Il est fondé sur le choix d’une loi instrumentale de densité g,partout

positive, et sur le noyau de transition suivant

x(t+1) =

ξ∼gavec probabilité α¡x(t),ξ¢

x(t)avec probabilité 1−α¡x(t),ξ¢

avec

α¡x(t),ξ¢=min(1, f(ξ)

f¡x(t)¢

g¡x(t)¢

g(ξ)).

On admettra que la loi de densité fest une loi stationnaire pour cette transition.

1. À l’aide de l’algorithme de Metropolis–Hastings et en utilisant la fonction gobtenue à la question

2, produire une chaîne de Markov (xt)t∈N=¡x(t)

1,x(t)

2¢de loi stationnaire f1et une chaîne de Markov

¡yt¢t∈N=¡y(t)

1,y(t)

2¢de loi stationnaire f2.

2. Étudier, par une expérience de Monte-Carlo, la convergence de l’approximation (1) vers les quantités

pet I.

3. Commenter les différents résultats obtenus.

4

1

/

4

100%

![Complète avec la bonne graphie du son [ã]](http://s1.studylibfr.com/store/data/005463499_1-36539643fb928b4ab00dc236cf7209f1-300x300.png)