Impact du système CROS sur les capacités de

I

Université de Rennes I

Faculté De Médecine

Ecole d’Audioprothèse de Fougères

Impact du système CROS sur les capacités de

localisation sonore de personnes sourdes unilatérales

dans le plan horizontal

Mémoire soutenu en vue de l’obtention du diplôme d’état d’audioprothèse par

Célia CARRIOU

Sous la Direction de

Brice JANTZEM

Vincent MAZO

Mathieu PAQUIER

2015

II

Je tiens tout d’abord à remercier mon maître de stage Monsieur Brice JANTZEM pour m’avoir

accepté au sein de ses laboratoires durant mon stage de troisième année d’audioprothèse. Je le

remercie également pour ses conseils judicieux et pour la confiance qu’il m’a accordée lors des

rendez-vous en cabine. Je le remercie enfin pour m’avoir donné les moyens matériels pour la

réalisation des tests.

Je remercie Monsieur Mathieu PAQUIER et Monsieur Vincent MAZO pour tout leur travail

notamment l’installation de la salle de test et la création du prototype de système CROS, un grand

merci pour tout le temps qu’ils ont bien voulu me consacrer.

Je souhaite particulièrement remercier Monsieur Vincent MAZO pour ses explications, ses conseils

indispensables dans la rédaction de ce mémoire et pour sa disponibilité. Merci également Monsieur

Mathieu PAQUIER pour la création de l’interface Matlab et ses précieux conseils.

Je remercie les entreprises PHONAK et WIDEX pour avoir répondu à mes diverses questions.

Je souhaite aussi remercier Madame Marie-Hélène ENIZAN, assistante de Monsieur Brice JANTZEM,

pour sa disponibilité et son aide précieuse tout au long du stage.

Enfin un grand merci à tous les patients des cabinets ENTENDRE et AMPLIFON à Brest, Châteaulin et

Quimper qui ont accepté de se déplacer à l’hôpital Morvan à Brest pour une séance de test.

III

Remerciements ii

Tables des figures v

Liste des abréviations vi

Introduction 1

Rappels 2

I. Localisation sonore 2

1) Stratégie de localisation des normaux-entendants 3

a. Historique 3

b. Influence de la tête sur les ondes sonores 4

c. Indices binauraux 5

i. Différence interaurale de temps 5

ii. Différence interaurale d’intensité 5

d. Indices monauraux 7

e. Interchangeabilité des indices de localisation 8

f. Intégration cérébrale 9

2) Stratégie de localisation des sourds unilatéraux 10

a. Indices spectraux 10

b. Impact d’une perte d’audition sur les hautes fréquences 11

c. Plasticité cérébrale 11

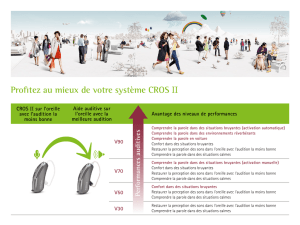

II. Système CROS/BiCROS 12

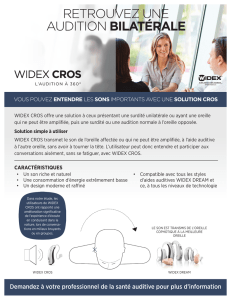

1) WIDEX 12

2) PHONAK 15

3) Choix de la gamme d’appareil auditif 16

4) Tests des différents modes microphoniques 17

5) Etat des lieux des systèmes CROS/BiCROS 29

a. Efficacité du système 29

b. Système CROS/BiCROS en France 30

IV

Etude 31

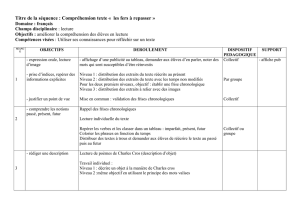

I. Matériels et méthode 31

1) Population de l’étude 31

2) Matériels 33

3) Procédure de passation 35

II. Résultats 38

1) Localisation sonore sans appareil auditif 38

2) Localisation sonore avec les systèmes CROS/ BiCROS et le prototype 43

III. Discussion 49

1) Localisation sonore sans appareil auditif 49

2) Localisation sonore avec les systèmes CROS/ BiCROS et le prototype 50

3) Limites de l’étude 52

Conclusion 53

Annexe 54

Références bibliographiques 57

V

Table des figures

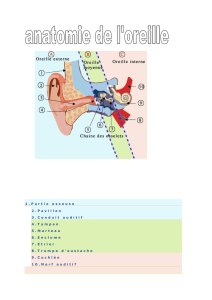

Figure 1: Repère tridimensionnel utilisé par les études de localisation sonore 2

Figure 2 : Onde sonore arrivant à l'oreille gauche et droite représentant les indices IDT et ILD

disponibles pour un son aigu modulé provenant de la gauche. 4

Figure 3 : HRTF pour l’oreille droite quand le haut-parleur est situé à 45° à droite (« near ear ») contre

45° à gauche (« far ear »). Modification du niveau d’intensité de l’extérieur jusqu’au tympan. 6

Figure 4 : Contribution du torse et des différents composants de l’oreille calculée par Shaw (1974). 7

Figure 5: un cône de confusion 8

Figure 6 : Représentation schématique des 10 noyaux principaux présents le long des voies auditives

(Glendenning et Hutson, 1998). 9

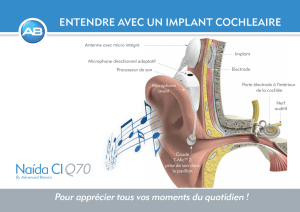

Figure 7 : systèmes CROS WIDEX® 12

Figure 8 : polarités modifiées par l’algorithme des appareils WIDEX® selon la fréquence 13

Figure 9 : Mesure in vivo au coupleur 2cc avec un son ISTS à un niveau d’intensité de 50dB, la mesure

a été répété trois fois : avec la balance du système CROS réglé sur 0, +15 et -15. 14

Figure 10 : systèmes CROS PHONAK® 15

Figure 11 : Mesure in vivo au coupleur 2cc avec un son ISTS à un niveau d’intensité de 65dB, la

mesure a été répété trois fois : avec la balance du système CROS réglé sur 0, +5 et -5. 16

Figure 12 : schéma du dispositif utilisé pour exécuter les tests. 17

Figure 13 : siège rotatif adapté pour la passation des tests 31

Figure 14 : disposition des huit haut-parleurs lors des tests 34

Figure 15 : caméra permettant au testeur de visualiser la réponse du sujet depuis le bureau 34

Figure 16 : Bureau du testeur 34

Figure 17 : Prothèse sur table 35

Figure 18 : résultats IT 39

Figure 19 : résultats SD 39

Figure 20 : résultats TP 40

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

41

41

42

42

43

43

44

44

45

45

46

46

47

47

48

48

49

49

50

50

51

51

52

52

53

53

54

54

55

55

56

56

57

57

58

58

59

59

60

60

61

61

62

62

63

63

64

64

65

65

66

66

67

67

68

68

1

/

68

100%