ALGÈBRES DE KAC-MOODY par Charles Cochet

ALGÈBRES DE KAC-MOODY

par

Charles Cochet

Table des matières

1. Algèbres de Kac-Moody............................................................. 2

2. Forme bilinéaire invariante et opérateur de Casimir généralisé. . . . . . . . . . . . . . . . . . . . . . . 7

3. Groupe de Weyl et représentations intégrables des algèbres de Kac-Moody. . . . . . . . . . 13

4. Classification des matrices de Cartan généralisées. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 20

Index des notations.................................................................... 25

Index terminologique................................................................... 25

Ces notes sont issues des premiers chapitres du livre de Kac, Infinite Dimensional Lie Algebras (Cam-

bridge University Press).

2CHARLES COCHET

1. Algèbres de Kac-Moody

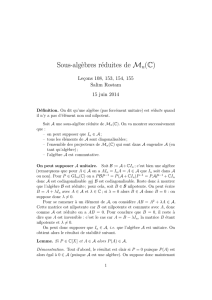

On dit que la matrice A= (ai,j )1≤i,j≤nà coefficient complexes est une matrice de Cartan généralisée

si elle satisfait aux conditions

ai,i = 2 pour tout i= 1,...,n;(1)

ai,j est un entier négatif pour i6=j;(2)

ai,j = 0 si et seulement si aj,i = 0.(3)

Bien qu’une théorie très riche puisse être développée avec les matrices de Cartan généralisée, il est

naturel de commencer avec une matrice quelconque.

1.1. Réalisation d’une matrice. — Soit A= (ai,j )1≤i,j≤nune matrice complexe de rang `. Une

réalisation de Aest la donnée d’un triplet (h,Π,Π∨), où hest un C-espace et Π = {α1, . . . , αn} ⊂ h∗,

Π∨={α∨

1,...,α∨

n} ⊂ hvérifient

Πet Π∨sont libres ;(4)

hα∨

i, αii=ai,j (i, j = 1,...,n) ;(5)

n−`= dim(h)−n.(6)

Nous appellerons Πla base des racines et Π∨la base des co-racines. Les éléments de Πet Π∨sont

appelés racines simples et co-racines simples respectivement. Posons également

Q=

n

X

i=1

Zαi, Q+=

n

X

i=1

Nαi.

Le treillis Qest appelé treillis des racines. Pour α=Piaiαi, l’entier ht(α) = Piaiest la hauteur de α.

Enfin, introduisons un ordre partiel ≥sur h∗en posant λ≥µsi λ−µ∈Q+.

Deux réalisations (h,Π,Π∨)et (h1,Π1,Π∨

1)de Asont isomorphes s’il existe un isomorphisme φ:h−→

h1d’espaces vectoriels tel que φ(Π∨) = Π∨

1et φ∗(Π1) = Π.

Proposition 1.1. — Il existe une unique réalisation (à isomorphisme près)d’une matrice complexe A.

Deux réalisations de matrices Aet Bsont isomorphes si et seulement si Best obtenue à partir de Apar

permutation de l’ensemble des indices.

Démonstration. — Quitte à réordonner les indices, on peut supposer que A=A1

A2pour une matrice

A1de taille `×nde rang n. Considérons la matrice

C=A10

A2In−`

de taille n×(2n−`). Posons h=C2n−`. Choisissons pour α1,...,αnles npremières fonctions coordonnées

et pour α∨

1,...,α∨

nles nlignes de C. Nous obtenons alors une réalisation de A.

Démontrons l’unicité. Pour une réalisation (h,Π,Π∨)donnée, complétons Πen une base de h∗en

ajoutant des éléments αn+1,...,α2n−`∈h∗. Nous avons alors

(hα∨

i, αji)i,j =A1B

A2D

pour une matrice Binversible de taille `×(n−`)et une matrice Dinversible de taille (n−`)×(n−`).

Quitte à ajouter à αn+1,...,α2n−`des combinaisons linéaires de α1,...,α`, on peut supposer B= 0.

En remplaçant αn+1,...,α2n−`par des combinaisons linéaires d’eux-même, on se ramène également à

D=I. D’où l’unicité de la réalisation.

La seconde partie de la proposition est maintenant évidente.

Si (h,Π,Π∨)est une réalisation de A, alors (h∗,Π∨,Π) est une réalisation de la matrice transposée t

A.

ALGÈBRES DE KAC-MOODY 3

Soient deux matrices A1et A2dont des réalisations respectives sont (h1,Π1,Π∨

1)et (h2,Π2,Π∨

2). La

matrice A10

0A2est la somme directe de A1et A2; elle admet pour réalisation le triplet

(h1⊕h2,Π1× {0} ∪ {0} × Π2,Π∨

1× {0} ∪ {0} × Π∨

2),

appelé somme directe des réalisations.

Une matrice A(ainsi que sa réalisation) est décomposable si après avoir réordonné les indices elle se

décompose en une somme directe non triviale. Après avoir réordonné les indices, on peut toujours décom-

poser une matrice Aen une somme directe de matrices indécomposables ; la réalisation correspondante

est la somme directe des réalisations indécomposables correspondantes.

1.2. Construction de l’algèbre ˜

g(A). — Soit A= (ai,j )1≤i,j≤nune matrice complexe de rang `.

Choisissons une réalisation (h,Π,Π∨)de A. Introduisons une algèbre de Lie auxiliaire ˜

g(A), de générateurs

ei,fi(i= 1,...,n) et hsatisfaisant aux relations

(7)

[ei, fj] = δi,j α∨

i(i, j = 1,...,n),

[h, h0] = 0 (h, h0∈h),

[h, ei] = hαi, hiei(i= 1,...,n;h∈h),

[h, fi] = −hαi, hifi(i= 1,...,n;h∈h).

Il découle de l’unicité de la réalisation que ˜

g(A)ne dépend que de A. On écrira ad(x) = [x, ·].

Notons ˜

n+(resp. ˜

n−) la sous-algèbre de ˜

g(A)engendrée par les ei(resp. les fi).

Théorème 1.2. — (1) Nous avons une somme directe d’espaces vectoriels ˜

g(A) = ˜

n−⊕h⊕˜

n+.

(2) La sous-algèbre ˜

n+(resp. ˜

n−)est librement engendrée par les ei(resp. les fi).

(3) L’application ei7→ −fi,fi7→ −ei,h7→ −h(h∈h)s’étend de façon unique en une involution ˜ω

de l’algèbre de Lie ˜

g(A).

(4) L’algèbre de Lie ˜

g(A)se décompose en espaces radiciels sous l’action de hsous la forme

(8) ˜

g(A) = M

α∈Q+\{0}

˜

g−α!⊕h⊕ M

α∈Q+\{0}

˜

gα!,

où ˜

gα={x∈˜

g(A) ; [h, x] = α(h)xpour tout h∈h}. De plus dim(˜

gα)<+∞et ˜

gα⊂˜

n±pour ±α∈

Q+\ {0}.

(5) Il existe un unique idéal maximal rde ˜

g(A)intersectant trivialement h. Nous avons une somme

directe d’idéaux

(9) r= (r∩˜

n−)⊕(r∩˜

n+).

Démonstration. — Non recopiée car longue.

1.3. Construction de l’algèbre de Kac-Moody g(A). — Soit A= (ai,j )1≤i,j≤nune matrice com-

plexe (de rang `). Choisissons une réalisation (h,Π,Π∨)de A. Considérons l’algèbre de Lie ˜

g(A)sur les

générateurs eiet fi(i= 1,...,n) avec les relations (7). D’après le théorème 1.2 (1), l’application naturelle

h−→ ˜

g(A)est un plongement. Soit rl’unique idéal maximal intersectant trivialement h. Posons

g(A) = ˜

g(A)/r.

La matrice Aest la matrice de Cartan de l’algèbre de Lie g(A).

L’entier nest le rang de g(A). Le quadruplet (g(A),h,Π,Π∨)est appelé quadruplet associé à la matrice

A. Deux quadruplets (g(A),h,Π,Π∨)et (g(A1),h1,Π1,Π∨

1)sont isomorphes s’il existe un isomorphisme

d’algèbres de Lie φ:g(A)−→ g(A1)tel que φ(h) = h1,φ(Π∨) = Π∨

1et φ∗(Π1) = Π.

Une algèbre de Lie g(A)dont la matrice Aest une matrice de Cartan généralisée comme défini en (1–3)

est appelée algèbre de Kac-Moody.

Nous conserverons la même notation pour les images des ei, des fiet de hdans g(A). La sous-algèbre

hde g(A)est appelée sous-algèbre de Cartan. Les eiet fisont appelés générateurs de Chevalley. Ils

engendrent en fait l’algèbre dérivée g0(A) = [g(A),g(A)]. De plus

g(A) = g0(A) + h.

Il s’ensuit que g(A) = g0(A)si et seulement si det(A)6= 0. Posons h0=Pn

i=1 Cα∨

i; ainsi g0(A)∩h=h0.

4CHARLES COCHET

Définissons l’espace radiciel associé à αcomme étant gα={x∈g(A) ; [h, x] = α(h)xpour tout h∈h}.

La formule (8) implique la décomposition radicielle selon h

(10) g(A) = M

α∈Q

gα.

Remarquons que g0=het g0(A)∩gα=gαsi α6= 0. L’entier mult(α) = dim(gα)est appelé multiplicité

de α. L’estimation dim(˜

g(A)) ≤n|ht(α)|implique

(11) mult(α)≤n|ht(α)|.

Une forme α∈Qest appelée racine si α6= 0 et mult(α)6= 0. Une racine α > 0(resp. α < 0) est

dite positive (resp. négative). La décomposition (7) implique qu’une racine est soit positive, soit négative.

Notons ∆,∆+et ∆−respectivement les ensembles des racines, racines positives et racines négatives.

Ainsi

∆ = ∆+t∆−.

Nous écrirons parfois ∆(A),Q(A), etc., afin d’insister sur la dépendance en A.

Soit n+(resp. n−) la sous-algèbre de g(A)engendrée par les ei(resp. les fi). Le théorème 1.2 nous

fournit la décomposition triangulaire

g(A) = n−⊕h⊕n+.

Remarquons que gα⊂n+lorsque α > 0et gα⊂n−lorsque α < 0. En d’autres termes, pour α > 0(resp.

α < 0) l’espace gαest linéairement engendré par les éléments de la forme [...[[ei1, ei2], ei3], . . . , eip](resp.

[...[[fi1, fi2], fi3],...,fip]) tels que αi1+···+αip=α(resp. =−α). On en déduit

(12) gαi=Cei,g−αi=Cfi,gsαi= 0 si |s|>1.

Puisque une racine est soit négative, soit positive, nous avons le résultat important suivant :

Lemme 1.3. — Si β∈∆+\ {αi}, alors (β+Zαi)∩∆⊂∆+.

D’après le théorème 1.2(5), l’idéal r⊂˜

g(A)est ˜ω-invariant. Donc ˜ωinduit un automorphisme involutif

ωde l’algèbre de Lie g(A), appelé involution de Chevalley. Cette involution est déterminée par

(13) ω(ei) = −fi, ω(fi) = −ei, ω(h) = −h(h∈h).

Puisque ω(gα) = g−α, on obtient mult(α) = mult(−α). En particulier

(14) ∆−=−∆+.

1.4. Une sorte d’unicité de l’algèbre de Lie g(A).— Le résultat suivant, quoique simple, est très

utile.

Proposition 1.4. — (1) Soient gune algèbre de Lie et hune sous-algèbre commutative. Supposons

qu’il existe des éléments ei,fi(i= 1,...,n)et des ensembles Π∨={α∨

1, . . . , α∨

n} ⊂ het Π∨=

{α1,...,αn} ⊂ h∗libres tels que

[ei, fj] = δi,j α∨

i∈h(i, j = 1,...,n),

[h, ei] = hαi, hiei,[h, fi] = −hαi, hifi(h∈h;i= 1, . . . , n).

Supposons que les ei, les fiet hengendrent gen tant qu’algèbre de Lie, et que gn’admette aucun idéal

non nul intersectant trivialement h. Posons enfin A= (hα∨

i, αji)1≤i,j≤net supposons que dim(h) =

2n−rang(A). Alors (g,h,Π,Π∨)est le quadruplet associé à la matrice A.

(2) Soient Aet A0deux matrices complexes de taille n×n. Alors il existe un isomorphisme entre les

quadruplets associés si et seulement si A0s’obtient à partir de Aen réordonnant l’ensemble des indices.

Démonstration. — Ceci découle de la proposition 1.1 et du théorème 1.2.

Corollaire 1.5. — Le quadruplet associé à une somme directe de matrices Aiest isomorphe à la somme

directe des quadruplets associés aux Ai. Le système des racines de g(A)est la réunion des systèmes des

racines des Ai.

ALGÈBRES DE KAC-MOODY 5

1.5. Digression sur les graduations. — Fixons un groupe abélien M. Une décomposition V=

Lα∈MVαd’un espace vectoriel Vest appelée M-graduation de V. Un sous-espace U⊂Vest gradué si

U=Lα∈M(U∩Vα). Les éléments de Vαsont dits homogènes de degré α. Le résultat suivant est souvent

utilisé en théorie des représentations.

Proposition 1.6. — Soient hune algèbre de Lie commutative et Vun h-module diagonalisable, c’est-

à-dire

(15) V=M

λ∈h∗

Vλ,où Vλ={v∈V;h(v) = λ(h)vpour tout h∈h}.

Alors tout sous-module Ude Vest gradué pour la graduation (15).

Démonstration. — Tout v∈Vs’écrit v=Pm

j=1 vjpour des vj∈Vλj. Il existe alors h∈htel que les

λj(h)soient tous distincts. Pour v∈U, on a alors

hk(v) =

m

X

j=1

λj(h)kvj∈U(k= 0,...,m−1).

Ce système linéaire est non-dégénéré, donc admet une unique solution ; ainsi vj∈Upour tout j.

Introduisons la topologie formelle sur un espace vectoriel gradué V=Lα∈MVαcomme suit. Pour un

sous-ensemble fini F⊂M, posons VF=Lα∈M\FVαet déclarons que ces VFforment une base d’un

système de voisinages de zéro. La complétion de Vdans cette topologie est Πα∈MVα. La clôture d’un

sous-ensemble Cde cet espace vectoriel topologique est appelée complétion formelle de C.

Une M-graduation d’une algèbre de Lie gest une graduation (de l’espace vectoriel g) telle que [gα,gβ]⊂

gα+β. Par exemple la graduation (10) est une Q-graduation de l’algèbre de Lie g(A).

Afin de construire une M-graduation sur une algèbre de Lie g, choisissons des générateurs a1, . . . , ande

get des éléments λ1,...,λnde M. Décrétons que deg(ai) = λi. Ceci définit une (unique) M-graduation

de gtelle que deg(ai) = λisi et seulement si l’idéal des relations entre les aiest M-gradué. Par exemple,

si les aiforment un système libre de générateurs de galors une telle graduation existe.

Soit maintenant un n-uplet (s1,...,sn)d’entiers. En posant

deg(ei) = −deg(fi) = si(i= 1,...,n),deg(h) = 0,

on définit une Z-graduation

g(A) = M

j∈Z

gj(s)

de g(A), appelée graduation de type s, avec

gj(s) = M

α

gα

et où la somme est sur l’ensemble des α=Pikiαi∈Qtels que Pikisi=j. Si si>0pour tout i, alors

g0(s) = het dim(gj(s)) <+∞pour tout j.

Exemple 1.7. — Une graduation importante est la graduation principale. C’est la graduation de type

1I = (1,...,1). De façon explicite, on a gj(1I) = Lht(α)=jgα. Ainsi

g0(1I) = h,g−1(1I) = X

i

Cfi,g1(1I) = X

i

Cei,n±=M

j≥1

g±(1I).

Lemme 1.8. — Soit a∈n+tel que [a, fi] = 0 pour tout i. Alors aest nul. De même, tout a∈n−tel

que [a, ei] = 0 pour tout iest nul.

Démonstration. — Soit a∈n+tel que [a, g−1] = 0. Alors Pi,j≥0ad(g1(1I))iad(h)jaest un sous-espace

de n+⊂g(A). Ce sous-espace est invariant sous l’action de ad(g1(1I)) et de ad(h), ainsi que sous celle de

ad(g−1(1I)) d’après l’hypothèse sur a. Donc si a6= 0 on obtient un idéal non nul de g(A)qui intersecte h

trivialement. Ceci contredit la construction de g(A).

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

1

/

26

100%