1 Pile, face, coupons

1

Pile, face, coupons

Mots-clés. Combinatoire ; loi discrète ; distance en variation totale; loi

des petits nombres ; convergence abrupte ; loi de Gumbel.

Outils. Loi des grands nombres ; théorème limite central ; inégalité de

Markov.

Difficulté. *

Ce chapitre est consacré au jeu de pile ou face et au problème du col lec-

tionneur de coupons, deux objets probabilistes importants qu’il est bon de

connaître et savoir reconnaître. Ce chapitre contient également une étude de

la distance en variation totale pour les mesures de probabilité discrètes.

1.1 Jeu de pile ou face

Le jeu de pile ou face consiste en des lancers successifs d’une pièce de

monnaie qui donnent à chaque fois soit pile (succès, codé 1) soit face (échec,

codé 0). On modélise cela par une suite (Xn)n1de variables aléatoires indé-

pendantes et identiquement distribuées de loi de Bernoulli Ber(p):

P(Xn=1)=1−P(Xn=0)=p∈[0,1].

Le nombre de succès dans les npremiers lancers

Sn=X1+···+Xn

est une variable aléatoire à valeurs dans {0,1,...,n}qui suit la loi binomiale

Bin(n, p) de taille net de paramètre p, donnée pour tout k=0,1,...,n par

P(Sn=k)=n

kpk(1 −p)n−k=n!

k!(n−k)!pk(1 −p)n−k.

1© Springer-Verlag Berlin Heidelberg 2016

D. Chafaï and F. Malrieu, Recueil de Modèles Aléatoires,

Mathématiques et Applications 78, DOI 10.1007/978-3-662-49768-5_1

2 1 Pile, face, coupons

La moyenne et la variance de Snsont donnés par

E(Sn)=np et Var(Sn)=np(1 −p).

Le temps Tdu premier succès, qui est aussi le nombre de lancers pour obtenir

un premier succès, est donné par

T:= inf{n1:Xn=1}

Si p>0, Tsuit la loi géométrique Geo(p)surN∗de paramètre pdonnée par

P(T=k)=(1−p)k−1p, k ∈N∗.

On a T≡∞si p=0etP(T<∞) = 1 sinon. De plus

E(T)=1

pet Var(T)=1−p

p2.

Le nombre d’échecs avant le premier succès

T:= inf{n0:Xn+1 =1}=T−1

suit la loi géométrique GeoN(p)surNet de paramètre pdonnée par

P(T=k)=P(T−1=k)=(1−p)kp, k ∈N,

et on a

E(T)=E(T)−1=1−p

pet Var(T)=Var(T)=1−p

p2.

Pour tout r∈N∗, le nombre de lancers Trnécessaires pour obtenir rsuccès

est défini par récurrence par

T1:= Tet Tr+1 := inf{n>T

r:Xn=1}.

Les variables aléatoires T1,T

2−T1,T

3−T2,... sont indépendantes et identi-

quement distribuées de loi géométrique Geo(p). La variable aléatoire Trsuit

la loi de Pascal ou loi binomiale-négative Geo(p)∗r. On a pour tout kr,

P(Tr=k)=

k11,...,kr1

k1+···+kr=k

(1 −p)k1−1p···(1 −p)kr−1p=(1−p)k−rprk−1

r−1

et

E(Tr)=rE(T)=r

pet Var(Tr)=rVar(T)=r1−p

p2.

Le processus de Bernoulli (Sn)n0a des trajectoires constantes par mor-

ceaux, avec des sauts d’amplitude +1, et les temps de saut sont donnés par

(Tr)r1(temps inter-sauts i.i.d. géométriques). Il constitue le processus de

1.1 Jeu de pile ou face 3

comptage de tops espacés par des durées indépendantes de même loi géomé-

trique, analogue discret du processus de Poisson. Comme Snest une somme

de variables indépendantes, (Sn)n0est une chaîne de Markov sur Nde noyau

P(x, y)=p1y=x+1 +(1−p)1y=x,et(Sn−np)n0est une martingale.

Par la loi des grands nombres (LGN) et le théorème limite central (TLC)

Sn

n

p.s.

−→

n→∞ pet √n

p(1 −p)Sn

n−ploi

−→

n→∞ N(0,1).

Cela permet notamment de construire un intervalle de confiance asymptotique

pour pappelé intervalle de Wald, qui est cependant peu précis.

Remarque 1.1 (Intervalle de Clopper-Pearson).Il est également possible de

confectionner des intervalles de confiance pour pnon asymptotiques, comme

celui de Clopper-Pearson par exemple, basé sur la correspondance Beta-

binomiale. Soit U1,...,U

ndes v.a.r. i.i.d. de loi uniforme sur [0,1].No-

tons U(1,n)··· U(n,n)leur réordonnement croissant. Alors pour tout

k=1,...,n la v.a.r. U(k,n)suit la loi Beta(k, n −k+1) sur [0,1] de densité

t∈[0,1] → tk−1(1 −t)n−k

Beta(k, n −k+1),où Beta(a, b):=1

0

sa−1(1 −s)b−1ds,

et

P(Snk)=P(1{U1p}+···+1{Unp}k)=P(U(k,n)p).

On déduit de cette identité une expression exacte de la probabilité que Sn

appartienne à un intervalle donné. Notons que comme Snest discrète, ses

quantiles sont aussi discrets, ce qui empêche de fabriquer un intervalle exact

de niveau α∈[0,1] arbitraire, et suggère de procéder à un lissage.

Remarque 1.2 (Motifs répétés et lois du zéro-un).Lorsque 0<p<1,le

lemme de Borel-Cantelli (cas indépendant) entraîne que toute suite finie de 0

et de 1apparaît presque sûrement une infinité de fois dans la suite X1,X

2,...

L’indépendance est capitale. Un singe éternel tapant sur un clavier finira tou-

jours par écrire les œuvres complètes de William Shakespeare ! Alternative-

ment, on peut déduire ce résultat de la nature géométrique du temps d’appari-

tion du premier succès dans un jeu de pile ou face obtenu en découpant le jeu

de pile ou face en blocs successifs de même longueur que la chaîne recherchée.

Remarque 1.3 (Jeu de pile ou face et loi uniforme sur [0,1]).Si Uest une

variable aléatoire sur [0,1] et si U=∞

n=1 bn2−nest son écriture en base 2,

alors Usuit la loi uniforme sur [0,1] si et seulement si les bits (bn)n1de son

écriture en base 2sont des v.a.r. i.i.d. de Bernoulli de paramètre 1/2.

Remarque 1.4 (Algorithme de débiaisage de von Neumann).Soit (Xn)n1

une suite de variables aléatoires de Bernoulli indépendantes et de paramètre

0<p<1inconnu. On fabrique la suite (Yn)n1de variables aléatoires indé-

pendantes et de même loi sur {0,1,2}comme suit

4 1 Pile, face, coupons

X1X2

Y1

X3X4

Y2

···

en posant Yn=0si (X2n−1,X

2n)=(0,1),Yn=1si (X2n−1,X

2n)=(1,0),et

Yn=2sinon. La suite (Zn)n1obtenue à partir de (Yn)n1en effaçant les 2

est constituée de variables aléatoires de Bernoulli indépendantes de paramètre

1/2. La production de chaque terme de la suite (Zn)n1nécessite un nombre

aléatoire géométrique de termes de la suite (Xn)n1.

1.2 Approximation binomiale-gaussienne

Soit (Xn)n1des v.a.r. i.i.d. de moyenne met variance 0 <σ

2<∞,et

Sn=X1+···+Xn. Le théorème limite central indique que pour tout t∈R,

lim

n→∞

PSn−nm

√nσ t=t

−∞

1

√2πe−x2

2dx.

Le théorème limite central de Berry-Esseen raffine ce résultat asymptotique en

fournissant une borne quantitative uniforme : si X1,X

2,... sont de Bernoulli

de paramètre p∈]0,1[,onam:= E(X1)=p,σ2:= E((X−m)2)=p(1 −p),

τ3:= E(|X1−m|3)=p(1 −p)(1 −2p(1 −p)), et

sup

t∈RPSnnp(1 −p)t+np−t

−∞

e−x2

2

√2πdx

τ3

√nσ3=1−2p(1 −p)

p(1 −p)√n.

Cette approximation de la loi binomiale par la loi gaussienne est d’autant

meilleure que (1 −2p(1 −p))/np(1 −p) est petit. À nfixé, cette borne est

minimale pour p=1/2 mais explose quand pse rapproche de 0 ou de 1. Pour

ces régimes extrêmes, il est plus approprié d’utiliser une approximation par

la loi de Poisson, abordée dans la section 1.4.

Lorsque X1,X

2,... sont des variables de Bernoulli de paramètre p∈]0,1[,

le TLC suggère d’approcher la loi binomiale Bin(n, p)deSnpar la loi gaus-

sienne N(nm, nσ2) lorsque nest grand. Le théorème limite central de de

Moivre et Laplace précise que pour tous −∞ <a<b<+∞,

lim

n→∞ √nsup

k∈In(a,b)

P(Sn=k)−

exp −(k−np)2

2np(1−p)

2πnp(1 −p)=0

où

In(a, b)=0kn:k−np

np(1 −p)∈[a, b],

1.3 Distance en variation totale 5

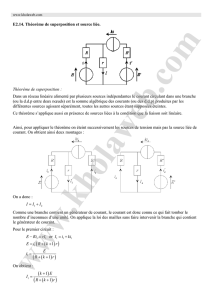

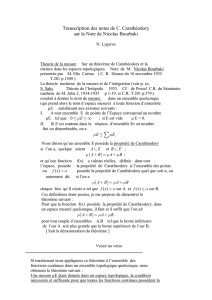

Lois binomiales

Bin(42,0.1)

Bin(42,0.5)

Bin(42,0.9)

0

0.05

0.1

0.15

0.2

P(X=n)

0 10203040

n

Fig. 1.1. Lois binomiales de même taille, pour trois valeurs du second paramètre,

illustrant la pertinence de l’approximation de la loi binomiale par une loi gaussienne

et par une loi de Poisson selon les cas.

qui redonne le TLC par intégration :

lim

n→∞

PSn−np

np(1 −p)∈[a, b]=1

√2πb

a

e−x2

2dx.

1.3 Distance en variation totale

Dans toute cette section, Eest un ensemble au plus dénombrable muni de

la topologie et de la tribu discrètes P(E). L’ensemble des lois sur Eest un

espace métrique complet pour la distance en variation totale

dVT (μ, ν):= sup

A⊂E|μ(A)−ν(A)|.

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

1

/

18

100%