MEMOIRE VIVE RAM

MEMOIRE VIVE RAM

NOTION DE MEMOIRE VIVE

La mémoire vive ou RAM (Random Access Memory, c'est à dire "mémoire à accès aléatoire")

est omniprésente dans les appareils électroniques (téléphones, consoles de jeu, etc.), mais

l'ordinateur en demeure le principal utilisateur et près de 70% des mémoires vives produites

dans le monde se retrouvent dans les ordinateurs. La mémoire vive y est ubiquiste et détient

une importance majeure : on la retrouve sous forme de mémoire centrale, sous forme de

mémoire cache ou sous forme de mémoire intégrée à des périphériques aussi divers que les

cartes graphiques, les cartes sons, les disques durs, les graveurs de CD-ROM ou les

imprimantes.

La mémoire vive s'oppose à la mémoire morte, cette dernière dénomination incluant tout type

de mémoire à l'intérieur de laquelle on ne peut qu'effectuer des opérations de lecture, l'écriture

étant impossible (ou réalisable seulement dans des conditions particulières). Les mémoires

vives, au contraire, permettent tant la lecture des données emmagasinées que l'écriture de

nouvelles informations à la volée. Toutes les RAM partagent également la caractéristique

commune d'être volatiles : elles ne conservent leurs données que lorsqu'elles sont sous

tension, leur contenu disparaissant avec l'extinction de l'ordinateur.

UNE MEMOIRE A ACCES ALEATOIRE

Au début des années 70, l'emploi des semi-conducteurs a permis de remplacer

avantageusement les anciens tambours et tores magnétiques jusque là utilisés dans la

fabrication des mémoires d'ordinateurs. La structure conventionnelle des mémoires à semi-

conducteurs est de type matricielle : on peut la représenter simplement comme un tableau

constitué de lignes et de colonnes, l'intersection d'une ligne et d'une colonne formant une

cellule appelée "point mémoire". Chaque point mémoire est en réalité une puce - composée

d'un ou plusieurs transistors couplé(s) avec un condensateur - destinée à contenir des données

:

Chaque puce de la matrice dispose d'une adresse propre définie par son numéro de ligne et

son numéro de colonne, et toute information présente dans la mémoire est alors directement

accessible via cette adresse. Le temps d'accès aux données est indépendant du numéro de la

cellule adressée et c'est en quoi la mémoire est dite à accès aléatoire (random access). Rien à

voir donc avec un éventuel accès "au hasard" tel que la formulation pourrait le suggérer.

DIFFERENTS TYPES DE RAM

La DRAM (Dynamic RAM) : les informations sont stockées dans la mémoire vive sous forme

de charges électriques dans les condensateurs des points mémoire. Ces condensateurs ayant

la fâcheuse tendance à se décharger naturellement, il est nécessaire, pour conserver

l'information présente dans la RAM, d'entretenir leur charge périodiquement (plusieurs

centaines de fois par seconde). Ce processus est appelé rafraîchissement de la mémoire et la

RAM nécessitant cet entretien périodique de la charge de ses condensateurs est appelée

DRAM (Dynamic RAM ou "mémoire dynamique").

Page -1- www.sophe.nl/btsig

La SRAM (Static RAM) : à l'opposé de la DRAM, la SRAM est une mémoire vive dite

"statique" : elle ne partage pas la même structure que la DRAM et ne nécessite pas que son

contenu soit rafraîchi périodiquement. Elle est plus rapide que la DRAM, mais son procédé de

fabrication est plus onéreux et sa densité d'intégration moindre (un point mémoire en SRAM est

constitué de 4 transistors, contre un seul en DRAM), c'est pourquoi elle n'est utilisée dans un

ordinateur que lorsque les besoins de rapidité sont importants, pour un cache par exemple

(c'est même la seule application de la SRAM dans un PC, alors que la DRAM se retrouve

partout).

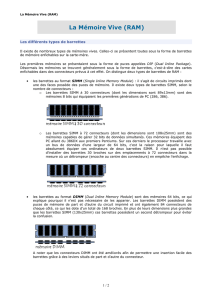

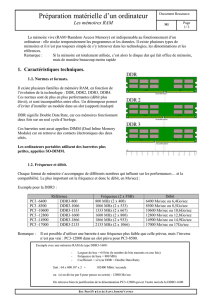

CONDITIONNEMENT DE LA RAM

Les mémoires de type DRAM qui équipaient les premiers modèles de PC AT (286 et quelques

386) se présentaient sous la forme de puces directement implantées sur la carte mère :

Puce au format DIP (Dual In-line Package)

A l'heure actuelle, ces formats ont été quasiment abandonnés. La forme triomphante de

présentation de la RAM depuis la fin des années 1980 est la barrette, qui est une mini-carte

d'extension sur laquelle sont fixées des puces de mémoire. Il existe 2 grands formats de

présentation des barrettes de RAM, indépendants du type de mémoire supporté :

Le format SIMM (Single Inline Memory Module) : les barrettes SIMM se présentent sous la

forme de petits circuits imprimés rectangulaires, disposant sur une de leurs faces de 30 ou 72

broches de connexion, assurant l'interface entre le reste de l'ordinateur et sa mémoire. Les

SIMM 30 broches mesurent 89 x 13 mm et ont surtout servi à équiper les PC 386 et les

premiers 486. Les SIMM 72 broches, quant à elles, mesurent 108 x 25 mm et ont largement

servi à équiper les 486 et les PC de type Pentium et compatibles, jusqu'à l'avènement de la

RAM sous forme DIMM :

Barrettes SIMM 30 broches

Barrettes SIMM 72 broches

Les barrettes SIMM 30 broches, capables de gérer des flux de données de 8 bits, suffisaient à

assurer les échanges entre la mémoire et les processeurs anciens comme les 286 et les

premiers 386. Dès que sont apparus des processeurs capables de gérer des flux de 32 bits

(386DX, 486), les SIMM 72 broches travaillant également en 32 bits se sont imposées d'office.

Par la suite sont survenus les microprocesseurs fonctionnant sur un bus de données d'une

largeur de 64 bits (Intel Pentium et compatibles), ce qui explique que les barrettes SIMM 72

broches doivent toujours être employées par paires en corrélation avec de tels processeurs

(lorsqu'un un flux de 64 bits est expédié depuis le processeur vers la RAM, il est indispensable

que celle-ci soit à même de réceptionner l'intégralité des données. Chaque barrette SIMM 72

broches travaillant sur 32 bits, il en faut donc un multiple de 2 en place).

Page -2- www.sophe.nl/btsig

Les barrettes SIMM s'enfichent sur des connecteurs (ou slots) particuliers, facilement

repérables sur les cartes qui autorisent l'emploi d'un tel format de mémoire :

Connecteurs pour barrettes de RAM au format SIMM 72 broches

Le format DIMM (Dual Inline Memory Module) : les barrettes DIMM ressemblent aux SIMM,

mais elles affichent des dimensions plus importantes (130 x 25 mm) et comportent un nombre

plus important de broches de contact (168 broches pour les barrettes DIMM de SDRAM, 184

broches pour celles de DDR-SDRAM par exemple) :

Barrettes DIMM 168 broches (SDRAM)

Les barrettes au format DIMM sont capables de gérer des flux de données de 64 bits en

provenance du microprocesseur central. Ceci correspond justement à la largeur du bus de

données couramment utilisé depuis l'apparition des processeurs de cinquième et de sixième

génération (Intel Pentium, Pentium MMX, Pentium II, AMD K6 et K6-2, IBM/Cyrix 6x86 et

6x86MX, etc.). Contrairement aux SIMM 32 bits, il n'est donc pas nécessaire d'apparier les

barrettes DIMM 64 bits lorsqu'on installe la RAM d'un ordinateur en employant ce type de

format. Les barrettes DIMM se placent sur des connecteurs totalement différents des

connecteurs SIMM, reconnaissables à leur couleur noire et aux ergots de fixation situés à leurs

extrémités :

Connecteurs pour barrettes de RAM au format DIMM 168 broches

LA MEMOIRE CENTRALE

L'utilisation la plus commune de la DRAM intervient dans la constitution de la mémoire centrale

de l'ordinateur. Celle-ci représente un élément essentiel, au moins autant que le

Page -3- www.sophe.nl/btsig

microprocesseur, avec lequel elle entretient des liens très proches. Il faut savoir en effet que

l'ordinateur stocke toujours dans la RAM les données (textes, images, etc.) et les programmes

(traitements de textes, tableurs, jeux, etc.) sur lesquels il travaille, ainsi qu'une partie du

système d'exploitation (DOS, Windows, Mac OS, etc.). Pourquoi donc ce transfert incessant du

disque dur vers la RAM ? Tout simplement parce que, une fois les données installées en

mémoire vive, le processeur - qui est l'élément le plus rapide de l'ordinateur - y accède

beaucoup plus vite (8 - 20 ms de temps d'accès pour un disque dur contre 50 - 60 ns pour une

DRAM). Ceci s'explique par le fait que la RAM manipule les informations sous formes de

charges électriques, tandis que le disque dur utilise un système mécanique de têtes de lecture

se déplaçant à la surface de disques magnétisables pour y lire ou y écrire les bits de données.

La quantité et le type de RAM dont dispose un ordinateur est donc un critère déterminant pour

en assurer le fonctionnement optimal.

Au cours des années, la DRAM utilisée pour la mémoire centrale des ordinateurs a subi de

constantes modifications destinées à en améliorer les performances, en étroite corrélation avec

la puissance sans cesse grandissante des processeurs.

La mémoire FPM (Fast Page Mode ou "mode page rapide") : avec l'apparition de la RAM

FPM, la mémoire centrale devient plus véloce, avec des temps d'accès avoisinant les 70 à 80

nanosecondes (ns) et des fréquences de fonctionnement s'échelonnant de 25 à 33 MHz. La

FPM est également et surtout une innovation par rapport aux anciennes formes de DRAM car

elle permet d'accéder plus vite aux données situées sur une même page mémoire : si des

informations réclamées par le processeur sont localisées dans une même colonne de la

matrice, le système doit activer une première fois le numéro de la colonne et le numéro de ligne

adéquats pour accéder à la première donnée ; ensuite, il n'a pas à répéter l'intégralité de cette

opération, se contentant simplement d'activer les numéros de lignes correspondant aux

données suivantes. La récupération de données avec la FPM peut se comparer à la

consultation d'un dictionnaire : tant que les termes que vous recherchez se situent sur la page

que vous avez ouverte, il est plus facile de les localiser et d'en lire la définition ; dès que vous

êtes amenés à tourner les pages du livre pour rechercher un nouveau mot, la consultation est

un peu plus lente.

En informatique, on peut évaluer les performances d'un type de RAM en mesurant le nombres

de cycles d'horloge nécessaires pour accéder à un ensemble de 4 bits de données consécutifs.

Avec la FPM, 5 cycles d'horloge sont nécessaires pour lire/écrire à la première adresse

mémoire et seulement 3 cycles pour atteindre les adresses suivantes. On dit que la FPM traite

les les données selon une séquence de cycles 5-3-3-3. La mémoire FPM s'est vendue sous

forme de barrettes SIMM 30 broches/8 bits et SIMM 72 broches/32 bits avant de disparaître au

profit de la mémoire EDO, plus performante.

La mémoire EDO (Extended Data Output ou "mode hyper page") : à la FPM succède la

mémoire EDO, de 10 à 30% plus performante. Elle est caractérisée par des temps d'accès

réduits (de 50 à 60 ns) et des fréquences de fonctionnement s'étalant de 33 à 50 MHz. L'EDO

reprend bien entendu le mode "page rapide" de la FPM, avec quelques nouvelles possibilités :

auparavant, le processeur n'était pas en mesure d'accéder aux données pendant les périodes

de rafraîchissement électrique ; avec l'EDO, c'est possible et les temps de latence sont

diminués d'autant. Par ailleurs, un contrôleur permet d'enregistrer les adresses des dernières

données auxquelles le processeur a accédé, ce qui facilite les accès suivants, intervenant

fréquemment sur la même page mémoire.

Grâce à ces améliorations, l'EDO est capable de travailler selon une séquence 5-2-2-2. On la

trouvait couramment sous la forme de barrettes SIMM 72 broches/32 bits (rarement sous forme

de barrettes DIMM, qui doivent alors être alimentées en 5,5V contre 3,3V pour une barrette

DIMM de SDRAM), mais elle a ensuite disparu à son tour au profit de la SDRAM : en effet, la

fréquence de fonctionnement maximale de l'EDO - 66 MHz - est insuffisante alors que des

vitesses de bus de 100 MHz et plus sont aujourd'hui monnaie courante.

La mémoire BEDO (Burst Extended Data Output) : la mémoire BEDO est une variante de

Page -4- www.sophe.nl/btsig

l'EDO qui permet la transmission ou la lecture des bits de données dans la mémoire en mode

"rafale" (burst), c'est à dire par paquets en flux ininterrompu le long du bus mémoire. La

technologie burst part du principe qu'il y a de fortes présomptions que les adresses dont aura

besoin le processeur après avoir accédé à la première donnée en mémoire seront celles tout

juste adjacentes, ce qui est souvent le cas. La mémoire BEDO délivre donc la première adresse

en 5 cycles d'horloge et enchaîne les 3 suivantes en un seul cycle seulement (soit une

séquence 5-1-1-1).

La mémoire BEDO se présente sous la forme de barrettes DIMM conventionnelles (tension

3,3V, temps d'accès 60 ns). Cependant, sa limitation de fréquence de fonctionnement à 66 MHz

constitue le principal handicap de cette mémoire pourtant très rapide et explique le fait qu'elle

n'ait pas recueilli les faveurs de l'industrie.

La mémoire SDRAM (Synchronous DRAM ou "mémoire dynamique synchrone") : la

SDRAM est une forme de mémoire développée peu de temps après l'EDO. La caractéristique

principale de la SDRAM est d'être synchronisée (d'où son nom) sur la fréquence d'horloge de la

carte mère, ce qui n'était pas le cas jusqu'ici avec les types de RAM précédents. Avec de la

mémoire asynchrone, comme la FPM ou l'EDO, le système imposait obligatoirement des délais

d'attente (wait states) au processeur, afin de synchroniser les échanges avec l'horloge propre

de la mémoire ; l'avantage de la SDRAM est d'éliminer ces wait states, puisque mémoire et

processeur fonctionnent au même tempo.

L'autre intérêt de la SDRAM est qu'elle peut supporter des fréquences élevées, ce qui

correspond parfaitement aux besoins actuels et à l'apparition des systèmes évoluant sur un bus

de données cadencé à 100 MHz et plus (par exemple Intel Pentium II, AMD K6-2, etc.). Pour

des configurations tournant en 66 MHz, la SDRAM n'apporte en revanche qu'un gain minime de

l'ordre de 5% par rapport à l'EDO.

La SDRAM est aussi véloce que la mémoire BEDO et travaille selon une séquence de cycles

d'horloge de 5-1-1-1. Puisque ses temps d'accès sont intimement liés à la fréquence de

fonctionnement de la carte mère, ses performances ne sont plus exprimées en nanosecondes

(ns), mais en mégahertz (MHz). Ce point est source de confusion chez de nombreux utilisateurs

car la SDRAM dispose également d'un temps de cycle exprimé en nanosecondes, et elle est à

ce titre souvent référencée comme "SDRAM 10 ns", "SDRAM 8 ns" ou "SDRAM 7 ns". On

pourrait alors imaginer que la SDRAM est 6 à 8 fois plus rapide que la mémoire EDO (60 ns de

temps d'accès), ce qui est faux : les temps d'accès de 7, 8 ou 10 ns inhérents à la SDRAM sont

en réalité liés aux 2°, 3° et 4° accès lors d'une opération de lecture/écriture sur quatre bits de

données (l'accès à la première adresse mémoire se faisant en 5 cycles d'horloge, comme pour

la mémoire FPM ou EDO).

La SDRAM n'existe qu'en format DIMM 168 broche (3,3V).

La mémoire DRDRAM (Direct Rambus DRAM) : à partir de l'année 2000, la société

californienne Rambus Inc. a proposé une nouvelle technologie de mémoire vive pour les PC.

Jusqu'ici intégrée sur certains produits tels que des stations de travail haut de gamme (Silicon

Graphics), des consoles de jeu (Nintendo 64) et des accélerateurs vidéo, la DRDRAM diffère

totalement des précédents types de DRAM : alors que la largeur du bus mémoire des PC les

plus récents atteint 32 ou 64 bits, la DRDRAM, quant à elle, évolue sur un bus étonnament

étroit de 16 bits de large, fonctionnant à très haute fréquence (jusqu'à 800 MHz, par un procédé

de transfert des données utilisant les fronts montants et descendants du signal de

synchronisation). Cette vélocité confère à la DRDRAM une bande passante de 1,6 Go/s (2

octets x 800 = 1600 Mo/s), contre à peine 800 Mo/s pour de la SDRAM fonctionnant à 100

MHz.

Cette augmentation de la bande passante améliorera considérablement les performances

générales des ordinateurs, le bus de données pouvant dès aujourd'hui fonctionner à 200 MHz

Page -5- www.sophe.nl/btsig

6

6

7

7

8

8

9

9

10

10

11

11

1

/

11

100%