Champs de neurones - Sciences Cognitives, Master 2

Champs de neurones

Sciences Cognitives, Master 2 Recherche

Nicolas P. Rougier

INRIA

Institut National de Recherche

en Informatique et Automatique

Nancy, Novembre 2011

1 / 33

Des impulsions aux populations

3 / 33

Le neurone biologique

•Un neurone est une cellule

exictable qui peut transmettre

de l’information via des

connections (synapses) à

d’autres neurones.

•Il existe plusieurs types de

neurones (pyramide, panier,

Purkinje, etc.) avec différentes

fonctions (sensoriels, moteurs,

interneurones, etc.)

•Les neurones sont connectés et

forment des réseaux.

4 / 33

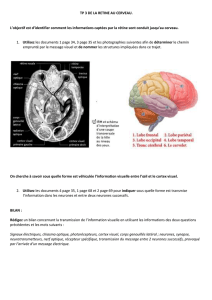

Le cerveau humain

•Le cerveau humain comprends

entre 50 to 100 milliards de

neurones (à peu près)

•Le nombre moyen de

connexions pour un neurone

est estimé à 10 000.

•1mm3de cortex ≈1 milliard

de connexions

5 / 33

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

1

/

33

100%