Introduction aux Réseaux de Neurones

Introduction aux

Réseaux de Neurones

>

Philippe JAUFFRET

Laboratoire des Systèmes d ’Information Chimique

UMR 5076 du CNRS - Montpellier

28/12/2002 41 2

sommaire

QUITTER><

•Neurones biologiques et artificiels

• évolution du domaine

• perceptrons - application au test de polluants

• les réseaux multi-niveaux

• la rétropropagation

• les cartes de Kohonen - application à la classification

automatique des réactions

• avantages et limites des RN

28/12/2002 41 3

définitions

QUITTER><

•Les réseaux de neurones (artificiels) sont des programmes

informatiques fondés sur un modèle simplifié du cerveau.

•Ils tentent de reproduire son comportement logique en mettant en

œuvre un ensemble d’entités inspirées des neurones biologiques.

•Un réseau de neurones est un exemple de « modèle connexionniste »

•Un réseau de neurones peut être « entraîné » et apprendre à résoudr

e

un problème donné

28/12/2002 41 4

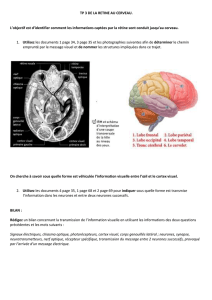

Le neurone biologique

QUITTER><

noyau

dendrites

synapses

axone

Cerveau humain :

~1010 neurones

~104connexions/neurone

Σdes signaux

d ’entrée

Signal

de sortie

28/12/2002 41 5

apprentissage

biologique

QUITTER><

Chimiquement très complexe

pas encore entièrement compris

Logiquement assez simple :

•renforcement des poids synaptiques en

cas de stimuli similaires répétés

• affaiblissement progressif en cas de

non-stimulation (oubli ?)

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

41

41

42

42

1

/

42

100%