Architecture et technologie des ordinateurs II G. Tempesti

Architecture et technologie des ordinateurs II

G. Tempesti Semaine I 1

Architecture et technologie

des ordinateurs II

Gianluca Tempesti

EPFL-DI-LSL, INN 235

Tel: 693 2676

E-Mail: gianluca.tempesti@epfl.ch

Web: lslwww.epfl.ch/~tempesti/CoursUNIL.htm

Bibliographie

¾John P. Hayes, Computer Architecture and Organization,

McGraw-Hill, 3rd ed., 1998.

¾David A. Patterson and John L. Hennessy, Computer

Architecture : A Quantitative Approach, Morgan

Kaufmann, 2nd Ed., 1996.

¾David A. Patterson and John L. Hennessy, Computer

Organization and Design : The Hardware/Software

Interface, Morgan Kaufmann, 2nd ed., 1997.

¾David A. Patterson and John L. Hennessy, Architecture

des ordinateurs: une approche quantitative, Thomson

Publishing, 2ème ed., 1996.

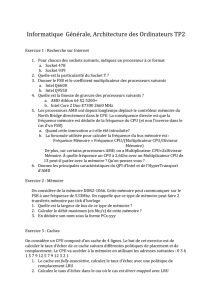

Programme détaillé

®Semaine 1: Introduction

¾Historique

¾Prix vs. performance

¾Niveaux de conception

®Semaine 2: Arithmétique I

¾Virgule fixe et flottante

¾Addition et soustraction

®Semaine 3:

Arithmétique II

¾Multiplication et division

¾Unité de traitement

®Semaine 4: Contrôle

¾Unité de contrôle

¾Programmes

®Semaine 5: Instructions

¾Jeux d’instructions

¾Décodage

¾Séquencement

¾Modes d’adressage

®Semaine 6: Processeurs

¾Microprogrammation

¾Types de processeur

Architecture et technologie des ordinateurs II

G. Tempesti Semaine I 2

Programme détaillé

®Semaine 7: Procédures

¾Gestion des procédures

¾Gestion des interruptions

®Semaine 8: Mémoires I

¾RAM

¾Mémoire virtuelle

®Semaine 9: Mémoires II

¾Mémoire cache

¾Mémoires associatives

®Semaine 10: Périphériques

¾Gestion du bus système

¾Gestion des périphériques

®Semaine 11: Petite pause

®Semaine 12: Pipelining

¾Fonctionnement

¾Aléas des pipelines

¾Prédiction de branchement

®Semaine 13: Parallélisme des

instructions I

¾Ordonnancement dynamique

¾Lancement multiple

¾Compilation

®Semaine 14: Parallélisme des

instructions II

¾Architectures avancées

Historique I - Époque méchanique

®Blaise Pascal - 1642 - Addition et soustraction

¾Retenue automatique, complément

®Gottfried Leibniz - 1671 - Multiplication et

division

¾Additions successives

®Charles Babbage

¾1823 - Difference engine - addition

Séquence d’instructions

¾1834 - Analytical engine - toute opération

Contrôle de séquence (programme), ALU et mémoire

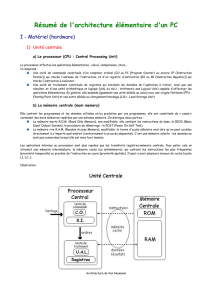

Historique II - Calcul

®Calcul : Z=f(X)

®Turing machine - 1936

¾Instructions: read, write, move, halt

¾Machine “universelle”

H

H

Processor P

Read/Write Head

Memory Tape T

Architecture et technologie des ordinateurs II

G. Tempesti Semaine I 3

Historique III - Deuxième guerre

®Ordinateurs éléctroméchaniques

¾Konrad Zuse - Z3 (1941) - nombres binaires, flottants

¾??? - Colossus (1943/1970) - décodage

¾Howard Aiken - Harvard Mark I (1944)

®Ordinateurs éléctroniques

¾Mauchly & Eckert - ENIAC (1946)

Programmation manuelle, base 10

¾Wilkes - EDSAC (1949)

Programme embarqué, base 2

¾Von Neumann, Mauchly & Eckert - EDVAC (1951)

Rapport Burks, Goldstine et Von Neumann (1946)

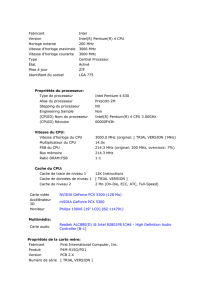

Historique IV - Générations

Dates

1950-1959

1960-1968

1969-1977

1977-????

????-????

1

2

3

4

5

Technologie

Tubes à vide

Transistors

Circuits intégrés

VLSI

????

Produits

Ordinateurs électroniques

Ordinateurs commerciaux

Miniordinateurs

PC et stations de travaille

????

Historique V - Générations

Date

1951

1964

1965

1976

1981

1991

1996

Produit

UNIVAC I

IBM S/360

PDP-8

Cray-1

IBM PC

HP9000

PPro 200

Taille (ft3)

1000

60

8

58

1

2

2

Puissance (W)

124500

10000

500

60000

150

500

500

Add/sec

1900

500K

330K

166M

240K

50M

400M

Prix (1996)

$5M

$4M

$66K

$8.5M

$4K

$8K

$4.5K

Architecture et technologie des ordinateurs II

G. Tempesti Semaine I 4

Performance

®Temps d’exécution et bande passante

®Coups d’horloge et instructions

Performance = 1

Temps d’exécution

Temps d’exécution (CPU) = Fréquence d’horloge

# coups d’horloge pour le programme

# coups d’horloge pour le programme =

# instructions ¥¥

¥¥ # coups d’horloge moyen par instruction

®Améliorations et accélération

®La loi d’Amdahl

Performance - Loi d’Amdahl

Accélération (speedup) = Temps d’exécution après amélioration

Temps d’exécution avant amélioration

Temps d’exécution après amélioration =

Amélioration

Temps d’exécution concerné + Temps d’exécution non concerné

Performance - Mesures

®MIPS et FLOPS

®Fréquence d’horloge

®Performance de pointe (peak)

®Benchmarks

¾Répartition des instructions

¾Taille

¾Localité des références (spatiale et/ou temporelle)

¾SPEC

Architecture et technologie des ordinateurs II

G. Tempesti Semaine I 5

Coûts

Coût du circuit intégré =

Rendement après le test final

Coût de la puce + Coût du test + Coût de la mise en boîtier

Coût d’une puce = Puces par tranche x Rendement des puces

Coût de la tranche (wafer)

®Coût de fabrication

®Coût des composants = 25-30% du prix de vente

Codage binaire

TRANSITORS

C

C=0

C=1

BA

BA

BA

C

C=0

C=1

BA

BA

BA IN OUT

0 1

1 0

IN=1 OUT=0

Vcc

GND

INVERSEUR

Dans les systèmes numériques, toute information est codée en binaire

Codage en base 2:

N = pn2n + … + p222 + p121 + p020

par exemple:

10110 = 1x24 + 0x23 + 1x22 + 1x21 + 0x20 = 16 + 4 + 2 = 22

mais aussi:

10110 = add R1, R2

Logique combinatoire I

A

B

2-INPUT

AND GATE

O

A B O

0 0 0

0 1 0

1 0 0

1 1 1

2-INPUT

OR GATE

IO

INVERTER

I O

0 1

1 0

4-INPUT

MULTIPLEXER

®Portes logiques

®Algèbre booléenne

®Minimisation (tables de Karnaugh)

A

BO

A B O

0 0 0

0 1 1

1 0 1

1 1 1 S0 S1 O

0 0 A

0 1 B

1 0 C

1 1 D

A

BO

C

D

S0

S1

6

6

7

7

8

8

1

/

8

100%