Conséquence de l`architecture mémoire

Cons´equence de

l’architecture

m´emoire

Adrien Poteaux et

Alexandre

Sedoglavic

Introduction

Cons´equence sur

le code

Mesures de performances temporelles

IInstructions per second (ips) ; cette mesure est

d´ependante du programme et du langage.

On estime que un quadricœur intel core 2 cadenc´e

`a 2.5GHz est de l’ordre de 40 gips.

IFLoating-point OPeration (flop) ; cette mesure permet

des comparaison mais ne prend en compte que les

instructions de calculs.

Les microprocesseurs actuels r´ealisent 4 flops par cycle

d’horloge.

IFLoating-point Operation Per Second (flops).

Un cœur cadenc´e `a 2.5GHz pr´esente donc une

performance th´eorique de 10 milliards de flops

(i.e. 10). gflops.

Un quadicœur dispose donc th´eoriquement

de 40 gflops.

Cons´equence de

l’architecture

m´emoire

Adrien Poteaux et

Alexandre

Sedoglavic

Introduction

Cons´equence sur

le code

Mesures de performances spatiales

Ila latence est le temps n´ecessaire `a des donn´ees pour

passer de la source `a la destination (on consid`ere ici la

latence des m´emoires ram).

Ila bande passante est le d´ebit de transmission des

donn´ees entre la source et la destination. La bande

passante est donc le produit :

Ide la latence des m´emoire ;

Ide la quantit´e de donn´ees transmise par cycle (2 mots

de 32 lettres dans le cas des ddr ram ;

Ide la taille du bus (64 lettres actuellement) ;

Inombre de bus — canaux — irriguant le processeur.

Ainsi, une architecture abordable actuellement est

constitu´e de 2 canaux de 64 lettres liant le processeur `a

des m´emoires ddr2 ram cadenc´es `a 400mhz ; cela

correspond `a une bande passante de 12.8gb par

seconde.

Cons´equence de

l’architecture

m´emoire

Adrien Poteaux et

Alexandre

Sedoglavic

Introduction

Cons´equence sur

le code

Constats

ILa plupart des applications n’exploitent que 10% des

performances optimales du processeurs.

ILes limitations principale sont dues `a la circulation des

donn´ees en m´emoire.

´

Ecart de performance entre processeurs et m´emoire :

Les performances de la bande passante progresse plus vite —

23% par an — que la latence du syst`eme de m´emoire — 7%

par an.

Cons´equence de

l’architecture

m´emoire

Adrien Poteaux et

Alexandre

Sedoglavic

Introduction

Cons´equence sur

le code

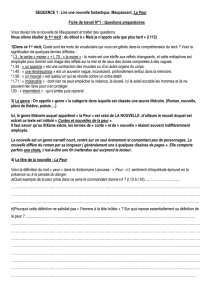

Hi´erarchie de m´emoire

Partant du constat de localit´e :

Ispatiale i.e. les prochaˆınes donn´ees `a utiliser sont

souvent proches des donn´ees actuelles ;

Itemporelle i.e. une donn´ee actuellement utilis´ee `a de

grande chance d’ˆetre r´eutilis´ee,

l’architecture implante un m´ecanisme de tampon

type cache L1 cache L2 ram disque nuage

latence 10−9s 10−8s 10−7s 10−2s 10s

taille kilo-octets m´ega-octets giga-octets tera-octets peta-octets

afin d’am´eliorer les performances moyennes.

La taille est inversement proportionnelle `a la latence (pour

ˆetre plus rapide, il faut partager le mˆeme support physique

ce qui limite la taille).

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

1

/

16

100%