cours3

Algorithmes Parallèles

et Systèmes Réparties

Frédéric Gava (MCF)

LACL, bâtiment P2 du CMC, bureau 221

Université de Paris XII Val-de-Marne

61 avenue du Général de Gaulle

94010 Créteil cedex

Modèle PRAM des

algorithmes parallèles

Introduction

Modélisation théorique de la calculabilité et de la

complexité sur une machine parallèle, on fait un

certain nombre d'hypothèses simplificatrices, voire

très peu réalistes

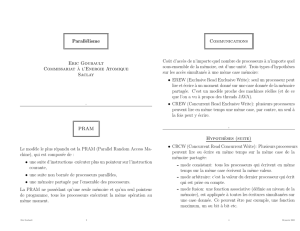

PRAM (Parallel Random Access Machine) :

d'une suite d'instructions à exécuter plus un pointeur sur

l'instruction courante

d'une suite non bornée de processeurs parallèles

d'une mémoire partagée par l'ensemble des processeurs

Une PRAM ne possède qu'une seule mémoire et

qu'un seul pointeur de programme, tous les

processeurs exécutent la même opération au même

Spécificités

Infinité de processeurs disponible

Processeurs synchronisés et exécutent

collectivement un programme

Instructions parallèle du type forall proc=0 to P

Une instruction PRAM synchronise les P

processeurs

Le coût d'accès de n'importe quel nombre de

processeurs à n'importe quel sous-ensemble de la

mémoire, est d'une unité

Il faut fixer un protocole d'accès mémoire

Les modèles

EREW (Exclusive Read Exclusive Write): seul un

processeur peut lire et écrire à un moment donné sur

une case donnée de la mémoire partagée.

CREW (Concurrent Read Exclusive Write):

plusieurs processeurs peuvent lire en même temps

une même case, par contre, un seul à la fois peut y

écrire. C'est un modèle proche des machines réelles

(threads Java p. ex.).

CRCW (Concurrent Read Concurrent Write): c'est

un modèle puissant et assez peu réaliste, mais qu'il

est intéressant de considérer d'un point de vue

théorique. Plusieurs processeurs peuvent lire ou

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

1

/

20

100%