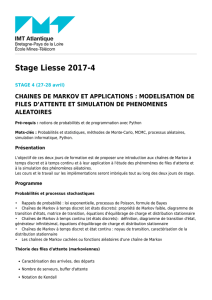

Processus de décisions de Markov (MDP)

IFT 615 –Intelligence artificielle

Processus décisionnels markoviens

(MDP)

Jean-François Landry

Département d’informatique

Université de Sherbrooke

http://planiart.usherbrooke.ca/~eric/ift615/

IFT 615 Processus de décision de Markov 2

Sujets couverts

•Processus de décision de Markov (MDP).

• Algorithme d’itération par valeurs (value-iteration)

• Algorithme d’itération par politiques (policy-iteration)

Rappel: Utility-based agents

IFT615 Processus de décision de Markov 3

Les actions

peuvent

avoir des

effets

incertains!

Les

capteurs

peuvent

être

bruités…

État

incertain.

Incertitude

•Soit Atl’action d’aller à l’aéroport t minutes avant le départ de l’avion.

•Atme permettra-t-il d’arriver à temps?

•Problèmes:

–Observabilité partielle (conditions routières, etc.)

–Senseurs bruités (annonces du trafic, etc.)

– Incertitude dans l’effet des actions (crevaisons, pannes, etc.)

–Immense complexité pour modéliser les actions et le trafic.

•Un raisonnement purement logique

–Risque de tirer des conclusions erronées: « A25 me permettra d’arriver à

temps », ou

–Risque de tirer des conclusions peu exploitable du point de vue « prise de

décision »:

•« A25 me permettra d’arriver à temps, s’il ne pleut pas, s’il n’y a pas

d’accident, si mes pneus ne crèvent pas, etc. »

•« A1440 me permettra raisonnable d’arriver à temps, mais je devrai

passer une nuit à l’aéroport. »

IFT615 Processus de décision de Markov 4

IFT 615 Processus de décision de Markov 5

Grille (occupancy grid)

Actions:

E: Go east

W: Go west

S: Go south

N: Go north

Example 0

Degré de désirabilité

-0.4 -1

: +1

But

Room 1 Room 5

Room 2

Room 4

Room 3

But

0 1 2 3 ….

0 1 2 3 ….

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

1

/

27

100%