apprend par cœur. - Département d`informatique et de recherche

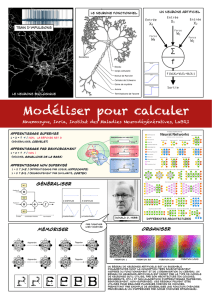

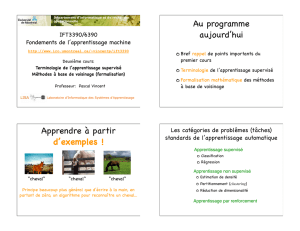

Apprentissage « machine »

Qu’est-ce que l’apprentissage ?

Allons voir ce que le grand dictionnaire

terminologique de l’office québécois de la

langue française en dit…

Apprentissage machine

Pour nos besoins, nous exclurons de

l’apprentissage machine des tâches telles

que l’acquisition et la recherche

d’information, l’expression des

connaissances (représentation et

organisation) et le raisonnement automatisé

(déduction et inférence logique), au profit de

la tâche de reconnaissance de formes.

Reconnaissance de formes

•La reconnaissance de formes est une caractéristique importante de

l’intelligence humaine, elle nous est familier, facile, naturel, automatique.

•Facilement, nous reconnaissons un visage, comprenons des mots et des

phrases parlés, l’écriture manuscrite, nous identifions nos clés parmi

d’autres, détectons un fruit trop mûr par sa texture ou son odeur ainsi que

plusieurs autres tâches de reconnaissance de formes –action de saisir des

données brutes et de poser une action en fonction de la catégorie ou classe

de la forme.

•Depuis notre existence, notre système cognitif a évolué de manière à

effectuer ces tâches cruciales à notre survie.

•Il est donc naturel de vouloir inventer des machines qui peuvent effectuer le

même genre de tâches : la reconnaissance de la parole et de caractères

optiques, et même certaines tâches du même type mais qui sont difficiles,

voir impossibles pour l’humain : la reconnaissance d’empreintes digitales, de

séquences d’ADN, de profils d’expression génétique, etc.

• L’apprentissage machine est donc une approche applicable à un grand

nombre de problèmes, et en particulier de bioinformatique.

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

1

/

18

100%