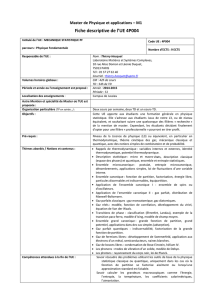

Éléments de Thermodynamique Statistique

1

École nationale supérieure de chimie de Paris

Éléments de

Thermodynamique Statistique

Alain Fuchs

Septembre 2008

2

Ces choses-là sont rudes, il faut pour les comprendre avoir fait ses études

Victor Hugo

Plan du cours

I. Introduction

II. Les Ensembles Statistiques

II.1. La notion d’ensemble statistique

II.2. L’ensemble canonique

II.3. Température et entropie en thermodynamique statistique

II.4. Autres ensembles statistiques

II.5. Fluctuations et condition d’équivalence entre les ensembles

III. Application aux systèmes « dilués »

III.1. Statistiques de Boltzmann, Fermi-Dirac et Bose-Einstein

III.2. Gaz parfait

IV. L’approximation classique

IV.1. Formalisme de Lagrange-Hamilton et fonction de partition classique

IV.2. Théorème d’équipartition de l’énergie et mouvement Brownien

IV.3. Théorie des fluides moléculaires : le modèle de van der Waals

V. Retour aux ensembles statistiques : introduction aux méthodes de simulation

moléculaire

Bibliographie

- D.A. McQuarrie, Statistical Mechanics, Univ. Science Books, Sausalito, 2000

- D.A. McQuarrie et J.D. Simon, Chimie Physique : Approche Moléculaire, Dunod,

Paris, 2000

- B. Diu, C. Guthman, D. Lederer, B. Roulet, Eléments de Physique Statistique,

Hermann, Paris, 1996

- D. Chandler, Introduction to Modern Statistical Mechanics, Oxford Univ. Press,

1987

- B. Widom, Statistical Mechanics : a Concise Introduction for Chemists, Cambridge

Univ. Press, 2002

3

I. Introduction

Expliquer du visible compliqué par de l’invisible simple

Jean Perrin

Dans la deuxième moitié du XIXe siècle, la communauté scientifique internationale

(majoritairement européenne à cette époque) adopte progressivement l’idée selon

laquelle la matière est faite d’atomes et de molécules. Un double défi est alors à relever.

Il s’agit d’une part de développer des modèles de la matière à l’échelle microscopique (ce

qui conduira au développement de la mécanique quantique), et d’autre part de faire

ensuite le lien entre l’échelle atomique et l’échelle macroscopique, ce qui conduira à la

thermodynamique statistique. Au premier de ces défis sont associés les noms de Bohr,

Schrödinger, Heisenberg, de Broglie, … Au second, on associe les noms de Maxwell,

Boltzmann et Gibbs. Einstein quant à lui a contribué a ces deux fronts de la connaissance

(en plus de la théorie de la relativité !).

Au moment où se produisent ces grandes évolutions scientifiques (au début du XXe), le

rêve est d’aboutir à une explication complète du monde basée sur la description

atomique. C’est ce que traduit la phrase de Jean Perrin citée en exergue. Aujourd’hui, on

est plus circonspect sur le fait de savoir ce qui est « simple » et ce qui est « compliqué ».

Il semble bien qu’une certaine forme de « complexité » se retrouve à toutes les échelles.

Il reste toutefois que l’interprétation des phénomènes macroscopiques à l’aide de

mécanismes microscopiques est une des aventures intellectuelles les plus fascinantes qui

soit. Pour cela, la thermodynamique statistique, par la voie traditionnelle analytique, ou

plus récemment par la voie numérique (les simulations moléculaires) est un outil d’une

grande utilité dans beaucoup de problématiques scientifiques et technologiques

contemporaines.

Les notes qui suivent ne constituent pas un ouvrage complet de thermodynamique statistique.

Dans l’esprit de la réforme du cursus ingénieur, il s’agit de passer moins de temps en cours sur les

détails des développements formels et d’insister sur la compréhension des concepts de base. Les

résultats importants sont présentés ici de façon aussi succincte que possible. L’existence de ces

notes ne dispense pas de la présence en cours.

4

II. Les ensembles statistiques

II.1. La notion d’ ensemble statistique

Les premiers développements de thermodynamique statistique sont dus à L. Boltzmann,

qui envisageait simplement l’étude statistique de N particules classiques (il n’y avait pas

de mécanique quantique en 1880) indépendantes dans un système physico-chimique

macroscopique. C’est plus tard, en 1902, que J.W. Gibbs (dont le portrait est reproduit

ci-dessous), proposa une version plus élaborée de la mécanique statistique, en y

introduisant la notion d’ensemble statistique (dans Elementary Principles of Statistical

Mechanics)

Le concept d’ensemble statistique peut-être simplement compris comme la réalisation

d’une expérience de pensée d’une mesure physico-chimique. Une observable

physicochimique s’effectue sur un temps « long » devant les temps caractéristiques

moléculaires. On laissera de côté ici pour l’instant les expériences contemporaines qui se

font aux temps « ultra-courts », et on se référera simplement par exemple à une mesure

de pression d’un gaz à l’équilibre dans un récipient fermé, effectué à l’aide d’un

manomètre. Le chiffre donné par l’appareil de mesure résulte de toute évidence d’une

moyenne effectuée au cours du temps sur un grand nombre d’états microscopiques du

même système.

t t t t

…

C’est cette idée qui est reprise dans la notion d’ensemble statistique.

Un ensemble statistique est un ensemble de A systèmes identiques (avec

!

A" #

).

L’ensemble est fermé, isolé (voir ci-dessous). Pour des raisons pratiques, on ne définit

pas l’ensemble statistique comme dans le schéma ci-dessus, à partir d’une suite

temporelle d’états du même système. Ces deux notions sont toutefois équivalentes.

À l’équilibre thermodynamique, une moyenne effectuée sur une suite d’états du même

système est équivalente à la moyenne effectuée sur une suite de systèmes différents

mais identiques. Cette propriété est reliée à la notion d’ergodicité dans la théorie des

systèmes dynamiques.

5

1

2

Ensemble statistique

3

.

.

.

A

t t t t t

. . .

B

<u>A = <u>B = observable macroscopique

Ergodicité

.

.

. Hypothèse fondamentale de la thermodynamique statistique

A

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

1

/

30

100%