Sujet 2016

UEF Traitement de l’information temps-réel

Pr. Olivier ROMAIN

1

Mini-projet

Intégration de prétraitement dans une

Vidéo-capsule : cas de l’indice

colorimétrique pour l’évaluation de la

qualité de l’examen

UEF Traitement de l’information temps-réel

Pr. Olivier ROMAIN

2

Objectifs

Le cancer colorectal représente la deuxième cause de mortalité dans le monde. Dans 80% des

cas, il se développe à partir d’un polype ou d’un adénome. Le risque de transformation d’un

adénome en cancer varie en fonction de la taille et de la composition de ses cellules. Le

dépistage au plus tôt et l’améliora- tion des traitements ont permis de réduire le taux de

mortalité, mais il reste encore trop important. Le dépistage précoce de ce cancer peut se faire

soit par des tests biologiques (Hémoccult en France) et/ou par un examen d’imagerie

endoscopique (coloscopie, célioscopie ...). Ces examens sont pratiqués à l’aide de vidéo-

endoscopes filaires ou depuis peu par vidéo-capsule. Les praticiens ont recours à ces dernières

dans le cas de patients à risques (anesthésie ...) ou lorsque l’examen porte sur des portions de

l’appareil digestif qui sont inaccessibles par le biais d’instruments classiques.

Les vidéo-capsules sont des dispositifs autonomes et sans fils qui, une fois ingérés, permettent

de prendre des images à intervalles réguliers de l’appareil digestif depuis l’œsophage jusqu’au

rectum. Du fait de leur autonomie limitée (8 h 00), il existe actuellement trois types de vidéo-

capsules (optimisées pour l’oesophage, l’intestin grêle et le gros colon). Aucune ne permet un

enregistrement continu de tout l’appareil digestif. L’examen est réalisé en ambulatoire, le

patient ingère la vidéo-capsule et le praticien récupère sous 24 h 00 le boîtier externe

d’enregistrement. L’analyse par le praticien des images acquises permet de déceler l’origine

des saignements et la présence éventuelle de polypes et/ou d’adénomes. Les vidéo-capsules

possèdent plusieurs limitations de part leur architecture; le capteur d’images est de faible,

résolution de ce fait les images délivrées permettent d’obtenir une estimation des tailles des

lésions avec 50% d’erreur ; l’autonomie est limitée à 8 h 00; le temps de traitement est

important et les outils actuels ne permettent pas d’interpréter le caractère cancéreux des

polypes. Par ailleurs, les images acquises restent de qualité réduite (résolution, conditions

d’éclairement non maîtrisées, mouvements sporadiques...) et la mise en place de méthodes

d’analyse (segmentation) reste une problématique ouverte afin d’éviter une majeure partie du

post-traitement des données par le clinicien ; des problématiques d’adéquation algorithme

architecture se posant alors.

L’objet de cette étude porte sur la modélisation de la vidéo-capsule afin d’évaluer la

pertinence d’embarquer les traitements en vue d’augmenter l’autonomie du dispositif.

Les images émises à travers le corps humain sont récupérées par un boîtier externe via des

électrodes posées sur le corps du patient. Les images enregistrées dans le boîtier externe

(datalogger) sont ensuite traitées « offline » par le clinicien.

UEF Traitement de l’information temps-réel

Pr. Olivier ROMAIN

3

Figure 1 – Synoptique du système complet : vidéo-capsule et datalogger

La vidéo-capsule comporte principalement trois blocs distincts (voir figure 2) :

— une instrumentation optique permettant l’acquisition des images de la zone ;

— un séquenceur ;

— une unité de transmission Radio-Fréquence (RF).

Figure 2 – Descriptif interne de la vidéo-capsule

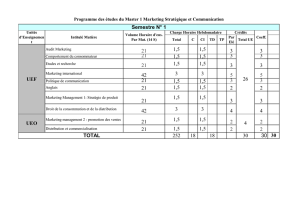

Le sujet aborde 3 parties distinctes :

• Partie 1 : Conception d’une IP pour le calcul de l’indice colorimétrique – IP-IC

• Partie 2 : Conception d’un Softcore et intégration de l’IP

• Partie 3 : Affichage du résultat sur un écran au format VGA

UEF Traitement de l’information temps-réel

Pr. Olivier ROMAIN

4

Etude préliminaire

En France, le nombre d’examen d’endoscopie s’èlève à 1 150 000 par an. Un tiers correspond

à des examens de colonoscopie. Le coût d’une colonoscopie est d’environ 765 euros tandis

que le côut d’un examen par vidéocapsule est de l’ordre de 500 euros. Tous ces examens

d’imagerie ne sont pas dédiés exclusivement au dépistage du cancer du colon, loin s’en faut.

La figure 3 décrit le fonctionnement du système disgestif depuis la bouche jusqu’au

rectum.

Les trois principales parties du tube digestif sont l’estomac, l’intestin grêle et le colon. La

durée de transit dans l’estomac est de l’ordre de 4 h 00 pour un sujet sain et les vitesses

périlstatic (propagation de l’onde digestive) sont respectivement de 3 cm.s−1 dans

l’œsophage, et 2 cm.min−1 dans l’intestin grêle et le gros colon.

La vidéo-capsule a une fréquence d’acquisition qui dépend du segment intestinal. Elle est telle

que :

• dans l’œsophage, la fréquence d’acquisition est de 35 images/seconde ;

• dans l’estomac, la fréquence d’acquisition est de 2 images/seconde ;

• dans l’intestin grêle et le gros intestin, la fréquence d’acquisition est de 15 images/s.

La résolution des images couleurs prises par la vidéo-capsule est de 320 par 280 pixels.

1. Viabilité de l’utilisation d’une vidéo-capsule

Q1. Calculer les économies faites par l’utilisation d’une capsule endoscopique par rapport à

un examen de vidéo-colonoscopie.

UEF Traitement de l’information temps-réel

Pr. Olivier ROMAIN

5

Q2. Conclure sur l’intérêt de cette solution.

2. Étude des performances globales de la vidéo-capsule

Q3. Évaluer la durée totale Ttransit du transit entre l’ingestion de la vidéo-capsule jusqu’à son

évacuation dans les sels.

Q4. Évaluer le nombre d’images Ntot prises par la vidéo-capsule lors d’un transit complet de

l’œsophage à l’anus.

Q5. Évaluer la taille de la mémoire à implanter dans le boitier externe si aucune compression

d’images est mise en œuvre.

Q6. Évaluer l’autonomie de la capsule, et vérifier le cahier des charges.

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

1

/

16

100%

![[Tapez un texte] MENTION SCIENCE POLITIQUE MASTER 1](http://s1.studylibfr.com/store/data/002647483_1-07827b7f60e8bf40c4b073fd30dd5f9a-300x300.png)