La représentation multisensorielle de l`espace dans le cerveau

Article issus des recherches du Pr Duhamel et de son équipe de Lyon (Jean-René Duhamel,

Institut des sciences cognitives, [email protected]).

La représentation multisensorielle de l'espace dans le cerveau

Des chercheurs de l'Institut des sciences cognitives de Lyon (CNRS) en

collaboration avec des chercheurs de l'Université catholique de Louvain et

de l'Université de Rochester, mettent en évidence, à l'aide de modèles

mathématiques, dans Nature Neuroscience du mois de juillet, la capacité

d'un neurone d'une région du cerveau, le cortex pariétal, d'intégrer des

informations spatiales provenant de signaux visuels, sonores, et mécaniques

à la surface du corps. Ces intégrations multisensorielles permettent de

localiser un objet le plus précisément possible à partir d'indices visuels,

mécaniques et auditifs partiels, mais également de prédire au mieux une

entrée sensorielle à partir d'une autre. Un boxeur peut ainsi anticiper

l'impact sur son corps du coup lancé par son adversaire.

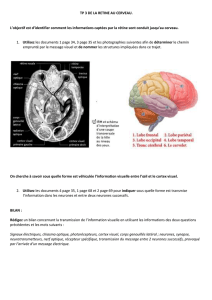

Dans le cerveau, le cortex visuel comporte des aires qui répondent de façon spécifique à des aspects

différents du stimulus visuel (couleur, direction du mouvement, reconnaissance des formes). D'autres

aires corticales participent à l'élaboration de la perception visuelle comme le cortex temporal et le

cortex pariétal. Le cortex pariétal évalue les données comme la position du corps et de la cible dans

l'espace grâce aux informations sensorielles qu'il reçoit. Il produit ainsi des modèles internes du

mouvement à effectuer, en amont des cortex prémoteur et moteur.

Des neurones « géomètres » pour localiser les objets dans l'espace

Chaque fois que notre regard se déplace, l'image du monde visuel se redistribue sur la rétine et par

conséquent, sur la carte visuelle corticale

(1)

. Ainsi selon que notre regard est orienté vers la droite

ou la gauche, un objet stationnaire se situera sur un bord du champ visuel ou sur un autre. En 1997,

l'équipe de Jean-René Duhamel, qui travaillait alors au Collège de France, avait montré, en mesurant

l'activité électrique de cellules nerveuses du cortex pariétal chez le singe, la capacité de ces neurones

à effectuer une combinaison de la carte visuelle corticale avec des informations posturales comme la

position de notre tête et de notre corps, ainsi que celle des yeux dans les orbites. Ce calcul de

coordonnées spatiales permet de localiser un objet dans l'espace dans un répère invariant par

exemple par rapport à la position de la tête, indépendamment de la direction dans laquelle le regard

se porte.

Ce travail laissait toutefois de nombreuses questions en suspens, notamment : comment ces

neurones « géomètres » parviennent-ils à intégrer les informations spatiales extraites des signaux

visuels avec celles provenant d'autres canaux perceptifs ? En effet, le cortex pariétal est une région

du cerveau où convergent, en plus des images visuelles, les impressions que laissent les stimulations

mécaniques à la surface de notre corps, les sons de l'environnement, et les messages produits par

nos propres mouvements dans les organes vestibulaires de l'oreille interne.

Simuler le comportement de milliers de neurones

L'activité électrique des neurones étant non linéaire, il est très complexe d'y additionner ou d'y

soustraire différents signaux électriques. C'est pourquoi les chercheurs ont décidé, pour répondre à

cette question, de faire appel cette fois aux compétences de spécialistes de la modélisation

mathématique afin de pouvoir simuler le comportement de milliers de neurones (et non plus de

dizaines) de façon artificielle et de reproduire certaines propriétés des circuits biologiques.

Les chercheurs et théoriciens ont mené en parallèle des mesures de l'activité électrique dans le

cerveau de singes soumis à des stimulations multisensorielles et des « mesures » de l'activité simulée

au sein d'un réseau de neurones artificiels mimant l'organisation du cortex pariétal. Ces mesures

présentent un double intérêt, permettant d'une part de comparer les activités neuronales réelles à

celles qui émergent des neurones simulés, et d'autre part d'évaluer à un niveau plus global, qui n'est

pas accessible aux mesures in vivo, la capacité du réseau à transformer et représenter correctement

les informations sur la localisation des objets.

Les deux hypothèses avancées par les théoriciens ont été vérifiées expérimentalement.

Premièrement, pour être combinées, les informations sensorielles et posturales convergent sur des

ensembles de cellules au sein d'aires intermédiaires, ces cellules répondant à des combinaisons de

positions de l'objet et de positions du corps. C'est la notion de codage populationnel. Ces populations

sont essentielles pour nouer un véritable dialogue entre les cartes visuelles primaires et les cartes

somatosensorielles(2).

Deuxièmement, les voies de communication nerveuse sont à double sens, et permettent ainsi à

l'information de circuler et recirculer de manière itérative d'une région à l'autre, il s'agit cette fois de la

notion de réseau récurrent. Ce type de réseau est particulièrement intéressant car il permet de réaliser

deux des fonctions les plus fondamentales du cerveau : l'intégration multisensorielle et la prédiction.

En l'occurrence, on peut calculer la localisation la plus probable d'un objet, à partir d'indices visuels et

auditifs partiels comme cela se produit lorsque l'on recherche la personne qui nous appelle au milieu

d'une foule bigarrée et bruyante. Un joueur de football peut ainsi déterminer le point d'impact d'un

ballon se déplaçant sur une trajectoire de collision avec sa tête afin de le dévier, ou un boxeur

anticiper la prochaine attaque de son adversaire.

Les résultats montrent que les données empiriques sont conformes aux prédictions du modèle, même

lorsque ces prédictions ne sont pas intuitives a priori. Par exemple, le modèle prédisait que les cartes

neuronales visuelles et somatosensorielles pouvaient ne pas être dans un alignement parfaitement

congruent, c'est-à-dire qu'elles ne se projettent pas toujours sur le même bord du champ visuel. C'est

effectivement le cas et cette situation ne nuit pas à la capacité du réseau à intégrer correctement les

deux types d'information.

Mieux comprendre les régions équivalentes dans le cerveau humain

Les résultats obtenus sur le cerveau du primate par ces chercheurs sont

particulièrement pertinents pour comprendre le rôle des régions

équivalentes dans le cerveau humain. En effet, les données récentes

d'imagerie cérébrale fonctionnelle chez l'homme confirment l'existence de

multiples subdivisions dans le cortex pariétal qui sont très proches de celles

qui ont été étudiées en détail chez le primate non humain.

Par ailleurs, on sait que des lésions de ces régions, résultant le plus

souvent d'accidents vasculaires cérébraux, provoquent des difficultés dans

l'exécution des gestes et des troubles de l'orientation de l'attention dans

l'espace. Les données de l'imagerie et de la pathologie cérébrales

montrent en outre que le cortex pariétal joue chez l'homme un rôle essentiel

dans la représentation des nombres et dans le calcul, ce qui suggère qu'il

existe une relation étroite entre les mécanismes neuronaux qui nous

permettent de nous orienter dans l'espace et ceux qui nous aident à

manipuler les nombres, autrement dit entre géométrie et arithmétique. Il

semble que cela se vérifie également chez le singe où d'autres données

montrent que la même région du cortex pariétal qui a été étudiée par

l'équipe de Jean-René Duhamel contient des neurones qui sont sensibles à

des quantités numériques.

Ceci suggère l'existence de précurseurs neuronaux de fonctions cognitives

parfois considérées un peu hâtivement comme spécifiquement humaines.

Ces observations soulignent l'importance de procéder à des études

comparatives des bases neuronales des fonctions cognitives chez les deux

espèces en s'aidant de modèles théoriques pour mieux comprendre leur

évolution.

Notes :

(1) Les cartes visuelles corticales résultent de la projection topographique des images perçues

par la rétine dans le cortex visuel

(2) Les cartes somatosensorielles résultent de la projection topographique des surfaces

sensibles corporelles

Références :

1. Avillac, M., Denève, S., Olivier, E., Pouget, A., Duhamel, J.R. Reference frames for

representing visual and tactile locations in parietal cortex. Nature Neuroscience, Jun 12;

[Epub ahead of print], 2005, à paraître dans la version imprimée de Juillet 2005.

2. Duhamel, J.-R., Bremmer, F., Ben Hamed, S., and Graf, W. Spatial invariance of visual

receptive fields in parietal cortex neurons. Nature. 389: 845-848, 1997

Contacts :

Contact chercheur :

Jean-René Duhamel, Institut des sciences cognitives, Tél. : 04 37 91 12 35, Mél. :

Contact presse :

Gaëlle Multier, Tél. : 01 44 96 46 06, Mél. : [email protected]

Contact Département sciences de la vie du CNRS :

Jean-Pierre Ternaux, Tél. : 01 44 96 43 90, [email protected]

1

/

4

100%