Version pdf (188 Ko)

Notes de cours

L1 — MATH120

Herv´

e Le Dret

18 octobre 2004

40

Chapitre 3

Vecteurs dans Rm

Dans ce chapitre, nous allons nous familiariser avec la notion de vecteur du

point de vue alg´

ebrique. Nous reviendrons le moment venu sur le point de vue

g´

eom´

etrique

3.1 D´

efinition et op´

erations sur les vecteurs

D´

efinition 17 Soit m ≥1un entier. Un vecteur de Rmest une matrice `

a m lignes

et 1colonne. Un scalaire est un nombre r´

eel (par opposition `

a un vecteur).

On parle aussi de vecteur-colonne. On va ´

egalement employer une notation pro-

visoire avec des petites fl`

eches, que l’on abandonnera d`

es que l’on aura acquis les

notions de base qui suivent. Ainsi

~u=3

−1, ~v=0,2

√5

sont des vecteurs de R2et

~w=

1

2

3

4

est un vecteur de R4.

Comme un vecteur n’a qu’une seule colonne, il est inutile de conserver la

notation `

a double indice des matrices : un seul indice suffit. La r`

egle d’´

egalit´

e

entre matrices s’applique bien sˆ

ur au cas particulier des vecteurs. Ainsi

si~u=u1

u2,~v=v1

v2,alors~u=~vsi et seulement si u1=v1et u2=v2.

41

42 CHAPITRE 3. Vecteurs dans Rm

En d’autres termes, les lignes d’un vecteur sont ordonn´

ees dans l’ordre de leur

indice. Un vecteur g´

en´

erique de Rms’´

ecrit normalement

~u=

u1

u2

.

.

.

um

.

Cette notation naturelle en colonne a le d´

esavantage de gaspiller l’espace sur une

page ´

ecrite quand elle utilis´

ee comme ici de fac¸on isol´

ee. C’est pourquoi on utilise

occasionnellement une notation en ligne

~u= (u1,u2,...,um)

pour d´

esigner le mˆ

eme objet. C’est en fait la notation d’un m-uplet de scalaires et

il faut ´

eviter de la confondre avec la notation

u1u2··· um

qui d´

esigne une matrice `

a 1 ligne et mcolonnes (aussi appel´

ee vecteur-ligne). Ce

n’est pas du tout la mˆ

eme chose!

Nous allons maintenant introduire les deux op´

erations fondamentales sur les

vecteurs.

D´

efinition 18 On d´

efinit sur Rmune op´

eration interne appel´

ee addition par

∀~u=

u1

u2

.

.

.

um

∈Rm,∀~v=

v1

v2

.

.

.

vm

∈Rm, ~u+~v=

u1+v1

u2+v2

.

.

.

um+vm

∈Rm

et une op´

eration externe appel´

ee multiplication par un scalaire par

∀~u=

u1

u2

.

.

.

um

∈Rm,∀λ∈R,λ~u=

λu1

λu2

.

.

.

λum

∈Rm.

Ces deux op´

erations sont donc d´

efinies ligne par ligne.

3.2. Interpr´

etation g´

eom´

etrique dans le plan et dans l’espace 43

Exemple 8 On a

1

−2+2

5=1+2

−2+5=3

3,21

−2=2×1

2×(−2)=2

−4,etc.

On peut combiner ces op´

erations. Ainsi, si~u=1

−2et~v=2

5alors

2~u+(−3)~v=2×1

2×(−2)+(−3)×2

(−3)×5=2

−4+−6

−15=2−6

−4−15=−4

−19,

et ainsi de suite.

3.2 Interpr´

etation g´

eom´

etrique dans le plan et dans

l’espace

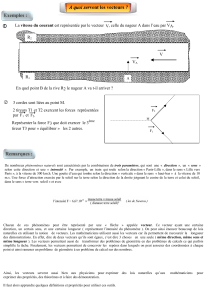

On sait que la donn´

ee d’une origine Oet de deux axes de coordonn´

ees Ox,Oy

munis d’une unit´

e de longueur dans le plan permet de rep´

erer tout point de ce plan

par ses deux coordonn´

ees, un couple de nombre r´

eels. Les vecteurs de R2´

etant

aussi d´

efinis par un couple de nombre r´

eels, on peut se servir de cette correspon-

dance pour repr´

esenter g´

eom´

etriquement les vecteurs de R2. Plus pr´

ecis´

ement, un

vecteur ~u= (u1,u2)de R2sera repr´

esent´

e par le segment orient´

e d’origine Oet

d’extr´

emit´

e le point de coordonn´

ees (u1,u2)dans le rep`

ere cart´

esien choisi. On

le dessine traditionnellement `

a l’aide d’une fl`

eche. De cette fac¸on, les vecteurs

— concept alg´

ebrique — admettent une repr´

esentation g´

eom´

etrique extrˆ

emement

utile pour comprendre et avoir l’intuition de comment ils fonctionnent. Par ailleurs,

cette correspondance ouvre la voie `

a un champ d’application de l’alg`

ebre lin´

eaire

`

a la g´

eom´

etrie plane (et dans l’espace), mˆ

eme si nous ne privil´

egierons pas ce

point de vue, n´

eanmoins tr`

es important.

Oy

u1

u1

u2 2

u

u=

O OOx

Oy

O

x

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

1

/

23

100%