5-10-3 L`hydrogène et la pile à combustible (PAC)

LE GRAND LIVRE DE LA VIE

DU BIG BANG A L’ORDINATEURQUANTIQUE

LE GRAND LIVRE DE LA VIE

Fresque cosmique : DU BIG BANG A L’ORDINATEUR QUANTIQUE

Introduction :Apres le BIG : le BANG

Chapitre I: Les débuts de l’univers

Big Bang

Inflation

L’anti-matière primordiale

Equation de Dirac

Evolution

Chapitre II : Etoiles et galaxies

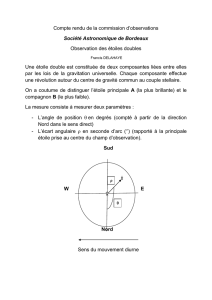

Création des étoiles et des galaxies

Vie et mort des étoiles

Résidus d’étoiles

Etoiles à Neutrons

Trous noirs

Rayon de Schwartzchild

Vitesse de libération

Trou noir de Kerr

Chapitre III : La Terre

De la Terre a la Vie

Apparition de la vie sur terre

Que la lumière soit

Evolution : des algues bleues à l’homo Sapiens

Si l’Univers avait 1an

24 heures de la vie sur terre

Découvertes des continents

Découvertes du 6ème continent

Chapitre IV : Sommes-nous seuls dans l’univers ?

Recherches d’autres vies

Historique des découvertes sur la vie

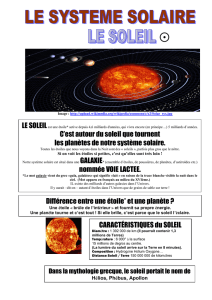

Les planètes du système solaire

Loi de Bode

Les Sondes Spatiales

Exobiologie (recherche de planètes non solaires)

Recherches in situ

Mars

La conquête de Mars

ALH84001

Un homme sur Mars

Europa/Ganymède

Les Fusées de demain

Moteurs ioniques

Moteurs a plasma

Propulsion avancée

Recherches spatiales

HST

COROT

Recherches au sol

Manifestations humaines

Manifestations spontannées anciennes

Géoglyphes

Hiéroglyphes du temple d’Abydos

Hiéroglyphes de la Hunter Valley (Australie)

Civilisation Olmèque

Astronaute de Kiev

Tombes pré-colombiennes

Les lignes de NAZCA

La Madone de San Giovannino

La Bible (Isaï)

Manifestations spontannées récentes

UFOs

40 ans de traques aux ET

Equation de Drake

SETI

VLA

Cyclops

Arecibo

SETI@home

Woh!

Manifestations Humaines vers d’éventuelles vies pensantes

Chapitre V : L’homme et la connaissance (Des algues bleues a Einstein)

Les forces dans la nature

Le modèle Standard

Les quarks

Les Gluons

Les anti-particules

Gravitation

Ondes Gravitationnelles

Projet Virgo

L’ATOME ET SES APPLICATIONS

L’ATOME QUI TUE

Fission

Le Projet Manhattan

Le test Trinity

Little Boy

Fat Man

L’ATOME QUI POURRAIT TUER

Armes nucléaires

Bombes N

Armes électromagnétiques

Radar tueur

Bombe E

Le canon laser du futur

Autres Armes

Armes chimiques

Armes bactériologiques

Armes climatiques

Le Projet HAARP

L’ATOME QUI GUERIT

Imagerie médicale

Ultra-sons

Bio-photonique

Diagnostic au laser

Endoscopie

CHAO

Téléchirurgie

L’ATOME QUI ARRANGE

Datation par le 14C

Le saint suaire de Turin

L’ATOME QUI DERANGE

Ralentissement de la lumière

Plus vite que la lumière !

Sources superluminiques

La Condensation de Bose-Einstein

HIGH TECH AU XXI siècle

Energies

Supraconductivité organique

Piles à combustible

CCD

Nanotubes

Les Nano –mondes

Voir les Atomes

Microscopie par Projection

Microscopes à effet Tunnel

Microscopes à force atomique

Microscopes à champ proche optique

La Nano-écriture

Microscopes à anti-matière

LE GENOME Caryotypes

Gènes

ADN/séquençage

Bases ACGT

Anomalie de Codage

Génomique fonctionnelle

Thérapie Génique

Médecine prédictive

Bio informatique

OGM Une tomate tansgénique

CLONES

Clonage d’une Pomme de terre

Clonage d’animaux

Clonage Humain (recette et risques)

Quand la Fiction devient réalité

Les Chimères

Le jeu de l’Arabette

Le jeu de l’Homme virtuel

Alors les séraphins descendirent de leurs chars de lumière….

Science et éthique

INFORMATIQUE

Semi-conducteurs

Les RAW

Transistors atomiques

Mémoires holographiques

Les ordinateurs du XXIème siècle

Ordinateurs optoélectronique

Ordinateurs biologiques

Ordinateurs quantiques

Chapitre VI : La Fin de l’humanité – La Fin de l’Univers

Evolution du système solaire

Destructions artificielles de la planète Terre

Le feu nucléaire

Agressions

Centrales nucléaires

Usine de retraitement de produits radioactifs

Destructions naturelles de la planète Terre

Heurt d’Astéroides/météroites

Le réchauffement de la Terre

Evolution de l’univers

Big Crunch après Big Bang ?

CONCLUSION : Dieu et la science : Antinomie ?

The overhelming beauty of the Universe

Il est étrange le destin…..

L’ASTRONOMIE

- chant 1 -

L’homme a sondé des cieux la vaste profondeur

Révélé des soleils la marche et la grandeur :

Parmi ces feux lointains qui roulent sur nos têtes,

Chaque jour, plus puissant, son œil fait des conquêtes ;

Des astres inconstants, qui ne brillent qu’un jour,

Son art trace l’orbite, et marque le retour.

Un mortel nous apprit qu’une force invisible

Anime et fait mouvoir la matière insensible.

Tous ces mondes brillants, dans l’espace lancés,

Attirés l’un par l’autre, y restent balancés,

Et, soumis à Newton, dans leur orbite immense

Gravitent par leur poids, qu’affaiblit la distance.

Mais quel est ce pouvoir, ce don mystérieux,

Par qui tout pèse, attire, et flotte dans les cieux ?

Quel peut être ce vide, océan de lumière,

Où tant d’astres brillants achèvent leur carrière ?

Hélas ! l’esprit de l’homme est étroit et borné

Comme le globe obscur sur lequel il est né :

Mais, tout faible qu’il est, il prend un vol sublime :

Du ciel qui l’environne il a franchi l’abîme ;

Et, de ces grands travaux, sous des lauriers en fleurs,

Uranie entretient ses immortelles fleurs.

L’homme ne peut atteindre à la cause première :

Le temps, la pesanteur, l’espace, la matière,

Que l’esprit croit comprendre, et ne peut définir,

Cacheront leur essence aux âges à venir.

Une vie de découvertes

Mon enfance a été de découvrir l’environnement où j’allais évoluer.

Lors de mon adolescence, j’ai appris à découvrir les sciences dont les mystères me

fascinaient.

Ma vie adulte a été de découvrir conjointement les joies de la vie familiale et de participer, à

mon modeste niveau, à faire progresser la connaissance scientifique.

Au soir de ma vie, je tente de faire une synthèse des découvertes majeures.

C’est un travail d’une ambition démesurée, mais quel plaisir de s’intéresser à des domaines

qui vous étaient jusqu’à présent peu familiers.

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

41

41

42

42

43

43

44

44

45

45

46

46

47

47

48

48

49

49

50

50

51

51

52

52

53

53

54

54

55

55

56

56

57

57

58

58

59

59

60

60

61

61

62

62

63

63

64

64

65

65

66

66

67

67

68

68

69

69

70

70

71

71

72

72

73

73

74

74

75

75

76

76

77

77

78

78

79

79

80

80

81

81

82

82

83

83

84

84

85

85

86

86

87

87

88

88

89

89

90

90

91

91

92

92

93

93

94

94

95

95

96

96

97

97

98

98

99

99

100

100

101

101

102

102

103

103

104

104

105

105

106

106

107

107

108

108

109

109

110

110

111

111

112

112

113

113

114

114

115

115

116

116

1

/

116

100%