L`AVENIR DU NoSQL

Meyer Léonard

2014

L’AVENIR DU NoSQL

Quel avenir pour le NoSQL ?

1

L’AVENIR DU NoSQL

SOMMAIRE

Introduction ................................................................................................................. 3

Histoire ..................................................................................................................... 3

Pourquoi NoSQL ? ................................................................................................... 4

Le Sharding .......................................................................................................... 4

La Denormalization ............................................................................................... 5

Le Distributed Caching ......................................................................................... 5

A qui s’adresse le NoSQL ? .................................................................................. 7

Exemples d’utilisation ........................................................................................ 8

Contre exemples ................................................................................................... 8

Théorème CAP ..................................................................................................... 9

ACID ou BASE ? ................................................................................................. 11

Le NoSQL aujourd’hui ......................................................................................... 12

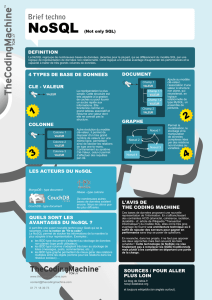

Les différents types de bases ............................................................................. 12

État de l’art ............................................................................................................. 20

Tour d’horizon des leaders .................................................................................. 22

MongoDB ............................................................................................................ 22

Cassandra .......................................................................................................... 22

Redis .................................................................................................................. 23

Couchbase .......................................................................................................... 23

La contre-attaque du NewSQL ............................................................................... 24

NewSQL et théorème de CAP ............................................................................... 25

La relève ? ............................................................................................................. 27

VoltDB................................................................................................................. 27

Aerospike ............................................................................................................ 29

NuoDB ................................................................................................................ 30

Conclusion ............................................................................................................. 31

Résultats et discussions ............................................................................................ 31

Google Spanner ..................................................................................................... 32

Le point de vue du la communauté NoSQL ........................................................... 34

2

Avis des professionnels ......................................................................................... 35

Conclusion ................................................................................................................ 46

Bibliographie.............................................................................................................. 47

3

Introduction

Les bases de données sont un élément très important dans l’informatique moderne.

Ces dernières années, le modèle relationnel s’est imposé comme la norme. En effet ce

dernier permet un respect des propriétés ACID (Atomicity, Consistency, Isolation,

Durability) et garanti ainsi la sécurité des données. Cependant ces propriétés demandent

des prérequis importants, ce qui peut impacter grandement les performances de la base.

A terme cela peut se traduire par une difficulté de scaling. Certaines entreprises ont donc

décidé de se pencher sur une nouvelle technologie afin de pallier aux problèmes de

performances, quitte à sacrifier la consistance des données.

Ces différents constats peuvent soulever plusieurs points : Quels sont les différents

types de base NoSQL ? Quels sont les avantages et inconvénients du NoSQL ? A-t-il des

concurrents ?

L’objet de cette thèse est donc de fournir une réponse à ces questions en

rassemblant des informations pertinentes et en investiguant les bases de données

identifiées comme Not Only SQL, puis de les comparer avec les bases traditionnelles. Leur

popularité générale auprès des professionnels et utilisateurs déterminera leur avenir. Cette

popularité se mesura par la présence des solutions NoSQL au sein des entreprises ou

solutions de ces derniers, le tout sur une échelle mondiale.

Cela permettra de conclure individuellement puis globalement sur leur pertinence

ainsi que leur avenir.

Cette thèse s’adresse donc à tous les novices sur le sujet ainsi que ceux qui

s’interrogent quant au bienfondé de cette technologie.

Histoire

Le terme NoSQL est pour la première fois sorti de la bouche de Carlo Strozzi en

1998, lors de la présentation de son système de gestion de bases de données

relationnelles open source. Il l’a appelé ainsi à cause de l’absence d’interface SQL pour

communiquer. Les bases NoSQL peuvent bien entendu être utilisées avec du SQL, c’est

pourquoi Strozzi précise qu’il est plus pertinent d’utiliser le terme « NoREL » car ces

dernières s'abstraient du côté relationnel des données. Le mot réapparu en 2009

lorsqu’Eric Evans l’utilisa pour caractériser le nombre grandissant de bases de données

non-relationnelles lors d’une présentation sur les bases de données distribuées open

source.

4

Pourquoi NoSQL ?

Une application web moderne peut supporter jusqu’à plusieurs millions d’utilisateurs

simultanés en répartissant la charge sur un ensemble de serveurs, supervisés par un load

balancer. Ces applications sont donc faites pour le scaling out, à savoir ajouter des serveurs

afin de supporter de plus en plus d’utilisateurs. Le scaling horizontal (ou « out ») tient donc

une place importante dans le contexte du cloud computing, où ajouter et retirer des

instances de machines virtuelles se fait à la demande.

A l’opposé, les bases de données relationnelles (RDBMS) n’ont pas tellement

évoluées depuis leur apparition il y a une quarantaine d’années, mais elles restent un choix

de prédilection. Gérer plus d’utilisateurs devient alors synonyme de moyens financiers

importants. Les serveurs imposants sont souvent complexes, propriétaires et très couteux.

De plus les RDBMS nécessitent la conception d’un modèle relationnel avant de

pouvoir stocker une quelconque donnée. Si les développeurs réalisent qu’ils ont oublié un

champ ou mis un mauvais type de donnée par exemple, le changement devient alors un

problème car il modifie en profondeur le modèle de la base. Ainsi ces changements

importants sont fréquemment évités.

Dans ce cadre, les développeurs ont créé des techniques visant à pallier aux

problèmes de performance.

LE SHARDING

Les bases de données actuelles adoptent encore souvent un modèle centralisé : un

serveur unique, éventuellement redondé en mode actif/passif pour la disponibilité. La

solution la plus courante pour supporter plus de transactions est la scalabilité verticale :

acheter une machine plus puissante (plus d’IO, de CPU, de RAM…). Le sharding quant à lui

FIGURE 1 SCALING D’UNE BASE RELATIONNELLE

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

41

41

42

42

43

43

44

44

45

45

46

46

47

47

48

48

49

49

1

/

49

100%