Apprentissage statistique pour construire des méta

Introduction: Qu’est-ce que l’apprentissage automatique ?

Problématique de l’apprentissage

Eléments d’apprentissage statistique

Sélection de modèles en apprentissage supervisé.

Conclusion

Apprentissage statistique pour construire des

méta-modèles

Manuel Samuelides

ONERA/ Institut Supérieur de l’Aéronautique et de l’Espace

Manuel Samuelides Apprentissage statistique pour construire des méta-modèles

Introduction: Qu’est-ce que l’apprentissage automatique ?

Problématique de l’apprentissage

Eléments d’apprentissage statistique

Sélection de modèles en apprentissage supervisé.

Conclusion

Outline

1Introduction: Qu’est-ce que l’apprentissage automatique ?

2Problématique de l’apprentissage

Apprentissage supervisé

Apprentissage non supervisé

Apprentissage par renforcement

Méthodologies utiles

3Eléments d’apprentissage statistique

4Sélection de modèles en apprentissage supervisé.

5Conclusion

Manuel Samuelides Apprentissage statistique pour construire des méta-modèles

Introduction: Qu’est-ce que l’apprentissage automatique ?

Problématique de l’apprentissage

Eléments d’apprentissage statistique

Sélection de modèles en apprentissage supervisé.

Conclusion

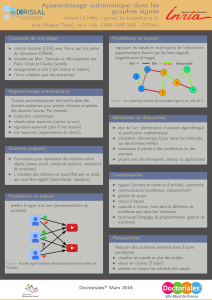

Apprentissage automatique ("machine learning")

L’apprentissage automatique fait partie de l’intelligence

artificielle.

Il s’agit de doter la machine de capacités d’apprentissage,

i.e. capacités d’évoluer en intégrant des données utiles

fournies par l’environnement.

Exemples: lecture automatique, capacité de mobilité dans

un environnement complexe (robotique), exploration du

Web, capacité de réparation (maintenance), analyse

financière (prévision), aide à la personne...

Une première piste a été celle de l’apprentissage

symbolique (systèmes experts) consistant à déduire des

données un système à base de règles (diagnostic, arbres

de décision...).

Manuel Samuelides Apprentissage statistique pour construire des méta-modèles

Introduction: Qu’est-ce que l’apprentissage automatique ?

Problématique de l’apprentissage

Eléments d’apprentissage statistique

Sélection de modèles en apprentissage supervisé.

Conclusion

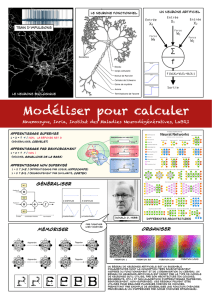

De l’apprentissage symbolique à l’apprentissage

statistique

L’explosion combinatoire du traitement des problèmes

réels a rendu nécessaire la mise en oeuvre de

"prétraitements statistiques".

L’intégration de ces prétraitements dans le système

d’apprentissage a conduit à considérer que l’apprentissage

automatique relève de la méthodologie statistique .

Modélisation des systèmes naturels et de leur adaptation:

règle de Hebb (1949)

perceptron de Rosenblatt (1957)

machine de Hopfield (1982)

perceptron multi-couche (Y.Le Cun, 1985; Rumelhart, 1986)

Vapnik (apprentissage statistique depuis 1971); Valiant

(PAC-learning, 1984)...

Manuel Samuelides Apprentissage statistique pour construire des méta-modèles

Introduction: Qu’est-ce que l’apprentissage automatique ?

Problématique de l’apprentissage

Eléments d’apprentissage statistique

Sélection de modèles en apprentissage supervisé.

Conclusion

Apprentissage supervisé

Apprentissage non supervisé

Apprentissage par renforcement

Méthodologies utiles

Outline

1Introduction: Qu’est-ce que l’apprentissage automatique ?

2Problématique de l’apprentissage

Apprentissage supervisé

Apprentissage non supervisé

Apprentissage par renforcement

Méthodologies utiles

3Eléments d’apprentissage statistique

4Sélection de modèles en apprentissage supervisé.

5Conclusion

Manuel Samuelides Apprentissage statistique pour construire des méta-modèles

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

1

/

38

100%