Carte graphique

Cosme Florian

Leblond Erik

BTSIG1

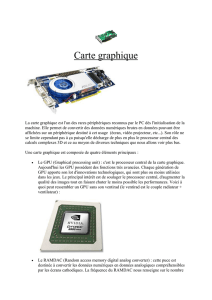

Carte graphique

Introduction :

Une carte graphique ou carte vidéo (anciennement par abus de langage une carte VGA), ou

encore Adaptateur graphique; est une carte d'extension d'ordinateur dont le rôle est de

produire une image affichable sur un moniteur d'ordinateur. La carte graphique convertit les

données numériques internes à l'ordinateur en un signal électrique numérique ou analogique

compatible avec le moniteur.

La carte graphique (écran) est la carte d'extension d'un ordinateur qui transforme un flux de

données numériques en un signal analogique compréhensible par un écran. Les cartes

graphiques Hercule furent les premières cartes dédiées au PC, elles étaient en noir et blanc (ou

plutôt selon le moniteur ambré). La couleur est réellement apparue avec les premiers 286. A

cette époque, la norme était le CGA ou EGA, le moniteur devait être compatible avec la carte

écran. Utilisant une résolution et un nombre de couleurs restreint, cette norme fut remplacée

par la norme VGA. La norme VGA permettait d'afficher une résolution de 640 * 480 points

en 16 couleurs. Une carte graphique VGA inclut 256 k de mémoire.

Comme chaque constructeur souhaite toujours améliorer, chacun a sorti des cartes graphiques

S-VGA (pour Super VGA). Ces cartes ne répondent pas à une norme, chaque constructeur

développe un pilote (un programme) qui permet au système d'exploitation de gérer ses

possibilités. Chaque pilote est spécifique au modèle de carte graphique mais aussi au système

d'exploitation. Le mode VGA est reconnu par tous les systèmes d'exploitation actuels. Pour

passer en mode supérieur, un pilote-driver (le programme spécifique au matériel) doit être

installé. Il est normalement spécifique au système d'exploitation (XP et 2000 acceptent

généralement les mêmes pilotes. Vista en nécessite des nouveaux.

Une zone mémoire est réservée dans la mémoire haute depuis les premiers 8088. Elle est

actuellement largement inférieure à celles utilisées par une carte graphique (jusque 256 MB)

et peut être récupérée par les commandes DOS de mémoires hautes. Le processeur graphique

garde les zones non modifiées dans sa propre mémoire. Ceci permet de ne pas trop utiliser le

processeur.

Une carte écran se caractérise par:

1) Processeur

2) Chipset

3) Mémoire

4) RAMDAC : Convertisseur digital – analogique (DAC)

5) Taux de rafraîchissement maximum.

6) Possibilités 3D

7) BIOS Vidéo

8) Connectique

9) Performances

Quelques unes de ces caractéristiques sont identiques à celle d'un système à

microprocesseur: processeur, mémoire et Bios. En effet, le sous système vidéo est un

système à microprocesseur tout à fait conforme dont le seul but est de traiter des

informations digitales provenant du PC pour les transférer vers le convertisseur.

1) Composants

Le processeur graphique

Le processeur graphique NV43 d'une GeForce 6600 GT

Les performances d'une carte graphique dépendent en grande partie du processeur central. En

effet, le processeur indique à la carte graphique tout ce qu'elle doit calculer. Cependant celui-

ci devant aussi gérer les autres paramètres du jeu, il se peut qu'il ne fournisse pas assez

d'informations, et alors la carte graphique doit attendre que le processeur ait terminé de

mouliner. Il faut un processeur bien adapté à la carte vidéo afin d'éviter ce genre de piège.

Mais il ne sert à rien d'avoir un processeur dernier cri avec une carte graphique d'entrée de

gamme en utilisation ludique.

Plus la résolution augmente, plus le travail de la carte graphique sera important.

Le processeur graphique (Graphical Processing Unit ou GPU en anglais) sert à libérer le

micro-processeur de la carte mère en prenant en charge les calculs spécifiques à l’affichage,

en particulier les calculs spécifiques à l’affichage en 3D ou la conversion YCbCr vers RGB.

Cette division des tâches entre les deux processeurs libère le processeur principal de

l’ordinateur et en augmente d’autant la puissance.

Le processeur graphique est très souvent muni de son propre radiateur ou ventilateur pour

évacuer la chaleur qu’il produit.

Ces 15 dernières années, les cartes graphiques ont fortement évolué. Autrefois, la fonction

essentielle d'une carte graphique était de transmettre les images produites par l'ordinateur à

l'écran. C'est encore sa fonction principale sur beaucoup de machines à vocation bureautique

ou l'affichage d'images en 3D n'offre que peu d'intérêt. Toutefois aujourd'hui même les cartes

graphiques les plus simples gérent aussi le rendu d'images en 3D temps réél avec plus ou

moins de succès. C'est une activité très couteuse en terme de calculs et en terme de bande

passante mémoire. Le GPU est donc devenu un composant très complexe, très spécialisé et

presque imbatable dans sa catégorie (rendu d'images en 3 dimensions). Hormis pour les jeux

vidéos ou quelques usages en infographie, les possibilités des cartes graphiques ne sont que

très peu exploitées en pratique. Ainsi ce sont essentiellement les joueurs qui achetent et

utilisent des GPU de plus en plus puissant.

Depuis quelques années, la puissance de calcul des cartes graphiques est devenue tellement

importante pour un coût finalement très réduit (100 à 700€ pour les modéles grand public) que

les scientifiques sont de plus en plus nombreux à vouloir en exploiter le potentiel dans

d'autres domaines. Il peut s'agir de faire tourner des simulation de modèles météo, financiers

ou toute opération parallélisable et nécessitant une très grande quantité de calcul. NVIDIA et

AMD, les 2 principaux fabriquants de cartes graphiques haute performance grand public

proposent chacun des solutions propriétaires afin de pouvoir utiliser leur produit pour du

calcul scientifique[réf. nécessaire].

2) Chipset : le circuit intégré.

Le chipset graphique transforme les signaux digitaux en signaux digitaux organisés et lisibles

par le convertisseur digital - analogique. Généralement, le circuit est conçu pour utiliser une

certaine capacité mémoire. Par exemple, une S3 TRIO 3D gère une mémoire de 4 MB, mais

une extension de 4 MB supplémentaire est possible. Ceci n'est pas à conseiller. Même si le

bus d'adresse est conçu pour gérer l'extension, l'intérieur du processeur est conçu pour la

mémoire de base. Vous autorisez de meilleure résolutions, mais n'améliorez pas les

performances globales de la carte graphique.

Parler des circuits pourrait prendre de nombreux chapitres, et vu la vitesse où les chipset

vidéo apparaissent et disparaissent, une mise à jour hebdomadaire serait nécessaire, surtout au

niveau 3D. Les informations suivantes sont donc données à titre indicatif.

Les principaux constructeurs de cartes graphiques sont

S3. Cette firme très active fabrique généralement en bas de gamme, mais peut parfois

surprendre, comme la SAVAGE 4 (16MB de base, 3D). Racheté par VIA.

ATI: d'excellentes cartes écrans de bas milieux de gamme. Racheté par AMD en 2006

INTEL: s'est intéressé un peu aux cartes écrans avec le i740. Ce processeur est également

intégré dans le chipset 1810, gérant en base 8 MB, il est 3D. Ceci explique que les cartes à

base de I810 n'incluent pas de bus AGP. Actuellement, INTEL est le principal fabricant de

cartes graphiques, intégrées dans le chipset.

Diamond. Généralement haut de gamme, mais spécialisé plutôt vers les jeux. Racheté par S3

en 1999.

Nvidia: premier fabricant mondial, toute la gamme avec la série Gforce

3) La mémoire vidéo

La mémoire vidéo conserve les données numériques qui doivent être converties en images par

le processeur graphique et les images traitées par le processeur graphique avant leur affichage.

Toutes les cartes graphiques supportent deux méthodes d'accès à leur mémoire. L'une est

utilisée pour recevoir des informations en provenance du reste du système, l'autre est sollicitée

pour l'affichage à l'écran. La première méthode est un accès direct conventionnel (RAM)

comme pour les mémoires centrales, la deuxième méthode est généralement un accès

séquentiel à la zone de mémoire contenant l’information à afficher à l'écran.

La mémoire vidéo : variant généralement de 16 à 512 Mo, elle est utilisée pour stocker les

textures (généralement sous formes d'images). Plus la taille de cette mémoire est importante,

mieux c'est. Attention de ne pas non plus tomber dans l'inutile : 16 Mo (mémoire partagée,

utilisée notamment par la technologie Turbo Cache que nous allons détailler plus bas) sont

largement suffisants en utilisation bureautique et multimédia. Les jeux en revanche ne se

satisferont pas d'une quantité aussi limitée, même si la mémoire vive vient en renfort avec

cette technologie. La largeur du bus de la mémoire joue également beaucoup : un bus de 128

bit de largeur sera généralement moins performant qu'un 256 bit.

Aujourd'hui, il existe deux types de mémoire vidéo :

- La mémoire GDDR 2 (DDR pour Double Data Rate), exploitant les fronts montants et

descendants de la mémoire, autrement dit la bande passante est doublée par rapport à la SD-

RAM à même fréquence. On trouve plutôt ce type de mémoire sur les cartes graphiques bas

de gamme.

- La mémoire GDDR 3 : presque identique à la GDDR 2, elle gagne en fréquence et sa tension

d'alimentation diminue. Elle est toujours utilisée même dans les cartes graphiques les plus

haut de gamme.

La mémoire de la carte graphique permet d'augmenter la résolution tout en gardant un nombre

de couleurs respectables. Par exemple, un écran de 1024 * 768 pixels en 2 couleurs (noir et

blanc) nécessite 786.432 pixels * 1 bit /8 (pour codage en octets)=98 K. Pour 4 couleurs (nb.

Octets =2), 196,6K et en 16 couleurs (4 bits):384 K. Ceci donnerait pour 1600 * 1200 en 16

millions de couleurs (14 bits)=30.000 MB, blups …

Résolution

Nombre de couleurs

Mémoire

640 * 480

256

512K

32 K

1 MB

64 K

1 MB

16 Millions ( 24 bits)

1 MB

800 * 600

16

512 K

256

512K

32 K

1 MB

64 K

1 MB

16 M

2 MB

1024 * 768

16

512K

256

1 MB

32 K

2 MB

64 K

2 MB

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

1

/

15

100%