Indications pour le TD de codage source Fichier

Indications pour le TD de codage source

I. Anticléricalisme :

Pauvre Paula ! Elle devrait prendre davantage le soleil !

II. Chienchiens :

Au lieu de transmettre les 39 octets correspondant aux lettres du texte, on transmet 16 couples : on

gagne donc 7 octets en appliquant Lempel-Ziv comme on l’a fait en cours.

Mais si on code, en plus, les caractères d’arrêt par la méthode de Huffman, ceux-ci occupent

moins de 6 octets (45 bits) au lieu de 16 : le gain est important !

La répartition statistique des caractères d’arrêt est non plate, et donc leur entropie inférieure au

maximum possible, ce qui rend leur codage toujours intéressant.

La question cachée de cet exercice est la suivante : est-il, de même, intéressant de coder, par une

méthode de type Huffman, les indices qui constituent la première partie des couples transmis ?

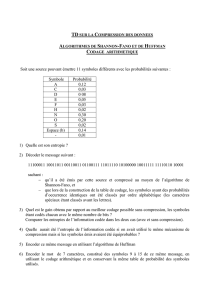

III. Shannon-Fano :

Pour comprendre pourquoi la méthode de Shannon-Fano se contente de diviser en deux blocs

contigus l’ensemble des messages considérés, sans chercher à les réorganiser pour trouver une

répartition plus proche de l’équiprobabilité, vous devez vous poser deux questions :

Quel serait le coût d’une telle recherche ?

Est-il sûr qu’une répartition plus favorable à l’étape n de l’algorithme donnerait

une répartition des messages restant intéressante à l’étape n + 1 ?

Vous constaterez, en tout cas, sur les exemples fournis que l’algorithme de Shannon-Fano,

malgré sa simplicité, donne des résultats très proches de ceux de Huffman, qui reste

cependant optimal pour le critère de la longueur moyenne des messages codés.

IV. Beethoven :

La loi

)1(*)(

ˆ txtx

suffit à atteindre l’objectif de transmettre en 49 bits le début de

l’Hymne à la Joie . Ceci dit, des étudiants ont trouvé une autre loi de prédiction, guère plus

compliquée, qui permet de transmettre le même morceau en 40 bits seulement !

Quant aux « quatre coups du destin » qui inaugurent la 5e, le codage avec perte proposé y

introduit deux couacs, ce qui est relativement peu compte tenu du caractère extrême du

codage des écarts.

1

/

1

100%