BLABLAB

Fonctionnement des CNNs :

Un Réseau de Neurones Convolutifs, également connu sous le nom de

CNN ou ConvNet, est une classe de réseaux neuronaux spécialisée dans

le traitement de données ayant une topologie en grille, comme une image.

Une image numérique est une représentation binaire de données visuelles.

Elle contient une série de pixels disposés de manière grillaire, avec des

valeurs de pixels indiquant la luminosité et la couleur de chaque pixel.

Architecture d'un Réseau de Neurones Convolutifs

Un CNN a généralement trois couches : une couche convolutive, une

couche de pooling et une couche entièrement connectée.

Couche Convolutive

La couche convolutive est le bloc de construction central du CNN. Elle

supporte la majeure partie de la charge computationnelle du réseau.

Cette couche effectue un produit scalaire entre deux matrices, où une

matrice est l'ensemble de paramètres apprenables, également appelé

noyau, et l'autre matrice est la partie restreinte du champ récepteur. Le

noyau est spatialement plus petit qu'une image mais plus en profondeur.

Cela signifie que si l'image est composée de trois canaux (RVB), la hauteur

et la largeur du noyau seront spatialement petites, mais la profondeur

s'étend à tous les trois canaux.

Au cours de la propagation vers l'avant, le noyau glisse sur la hauteur et la

largeur de l'image, produisant la représentation de l'image de cette région

réceptive. Cela produit une représentation bidimensionnelle de l'image

appelée carte d'activation, qui donne la réponse du noyau à chaque

position spatiale de l'image. La taille de glissement du noyau est appelée

pas (stride).

Si nous avons une entrée de taille W x W x D avec un nombre Dout de

noyaux ayant une taille spatiale F avec un pas S et une quantité de

rembourrage P, alors la taille du volume de sortie peut être déterminée par

la formule suivante :

Wout = (W-F+2P)/S + 1

Cela donnera un volume de sortie de taille Wout x Wout x Dout.

Couche de Pooling

La couche de pooling remplace la sortie du réseau à certaines positions en

dérivant une statistique récapitulative des sorties voisines. Cela contribue à

réduire la taille spatiale de la représentation, diminuant ainsi la quantité

requise de calculs et de poids. L'opération de pooling est effectuée sur

chaque tranche de la représentation individuellement.

Il existe plusieurs fonctions de pooling telles que la moyenne du voisinage

rectangulaire, la norme L2 du voisinage rectangulaire et une moyenne

pondérée en fonction de la distance par rapport au pixel central.

Cependant, le processus le plus populaire est le max pooling, qui rapporte

la sortie maximale du voisinage.

Si nous avons une carte d'activation de taille W x W x D, un noyau de

pooling de taille spatiale F et un pas S, alors la taille du volume de sortie

peut être déterminée par la formule suivante :

Wout = (W-F)/S + 1

Cela produira un volume de sortie de taille Wout x Wout x D.

Dans tous les cas, le pooling offre une certaine invariance de translation,

ce qui signifie qu'un objet serait reconnaissable indépendamment de

l'endroit où il apparaît sur l'image.

Couche Entièrement Connectée

Les neurones de cette couche ont une connectivité complète avec tous les

neurones de la couche précédente et de la couche suivante, comme on

peut le voir dans les Réseaux de Neurones Entièrement Connectés

(FCNN) classiques. C'est pourquoi elle peut être calculée comme

d'habitude par une multiplication de matrices suivie d'un effet de biais.

La couche entièrement connectée aide à établir la correspondance entre la

représentation en entrée et la sortie.

Architecture d’un Convolutional Neural Network-CNN

Les CNN désignent une sous-catégorie de réseaux de neurones =modèles de

classification d’images

entrée une image sous la forme d’une matrice de pixels.

3dimensions:

-Deux dimensions pour une image en niveaux de gris.

-(RGB)

un cnn est composé de 2 partie:

1)Une partie convolutive extraire de l’image les données en compressant ce

qui réduit leur taille. l’image passe donc par des FILTRES pou creer une

nouvelle image la carte de convulsion. cette derniere est concaténé dans

un vecteur nommé code CNN

2) une partie classification:le code CNN est l’entre de cette partie. elle est

ensuite entré au perceptron MLP(Multi Layers Perceptron). Pour combiner

les caractéristiques du code CNN afin de classer l’image.

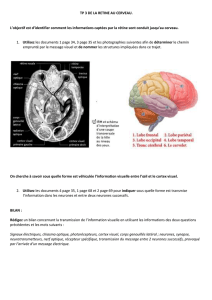

PK LA convolution ?:

KEZAKO: FLEMME J’expliquerai pas peut etre pour le gros rapport

Mias voila quand meme une image

Juste a savoir: on applique le filtre par convolution.

Sources :Convolutional Neural Network : Tout ce qu'il y a à savoir (datascientest.com)

https://www.mygreatlearning.com/blog/types-of-neural-networks/

Apprentissage des CNNs :

Les CNN apprennent en utilisant un processus appelé backpropagation, composé de

d’une succession d’étapes afin d’arriver à un résultat. On considérera le cas ou l’on entre une

image dans le modèle afin de l’expliquer :

1. Initialisation : On initialise les poids des différentes parties du réseau en leur donnant

des valeurs aléatoires. Cela n’est pas pénalisant étant donné que les données vont

ensuite être ajustées lors de la backpropagation.

6

6

7

7

8

8

1

/

8

100%