Deep Learning et Classification d'Images : Mémoire de Master

Telechargé par

Alioune GAYE

République Algérienne Démocratique et Populaire

Université Abou Bakr Belkaid– Tlemcen

Faculté des Sciences

Département d’Informatique

Mémoire de n d’études

pour l’obtenon du diplôme de Master en Informaque

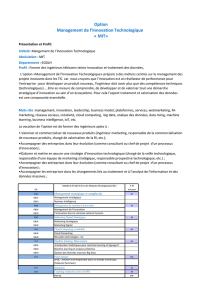

Opon: Modèle Intelligent et Décision(M.I.D)

Deep Learning pour la classification des

images

Réalisé par :

-Moualek Djaloul Youcef

Présenté le 3 Juillet 2017 devant le jury composé de MM.

-Hadjila Fethallah (Président)

-Benazzouz Mourtada (Encadreur)

-El Habib Daho Mostafa (Examinateur)

-Nessma Settouti (Examinatrice)

Année universitaire : 2016-2017

DEDICACES ET

REMERCIEMENTS

LA FAMILLE, LES AMIS, LES

ENSEIGNANTS, LES COLLEGUES

Table des matières

Table des figures 7

Liste des tableaux 8

Acronyms 9

I Introduction générale 9

1 Introduction 11

2 problématique 11

3 Contribution 12

II État de l’art 12

1 Qu’est ce que le machine learning ? 14

2 performance et surapprentissage 15

3 Les différents types de machine learning 16

3.1 apprentissage supervisé et non supervisé . . . . . . . . . . . . . . . . . . . . . . . . . . . . 16

3.2 régressionetclassification .................................... 17

4 Les différents type d’algorithme 17

4.1 Larégressionlinéaire....................................... 17

4.2 Leskplusprochesvoisins .................................... 18

4.3 LeclassifieurnaïfdeBayes ................................... 19

4.4 k-means.............................................. 19

4.5 Lesarbresdedécision ...................................... 20

4.6 Lesforetsaléatoires ....................................... 22

4.7 Les machines à vecteur de support . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 22

4.8 Leperceptronmulticouches ................................... 25

5 Conclusion 26

III Deep Learning 26

1 Introduction 28

2 Histoire du deep learning 29

3 Pourquoi le deep learning ? 29

4 Les différents types de modèles 31

4.1 Les réseaux de neurones convolutifs . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 31

4.1.1 Inspiration ........................................ 31

4.1.2 L’opération de convolution . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 32

4.1.3 Coucheconvolutif .................................... 32

3

4.1.4 Couchedepooling .................................... 33

4.1.5 Perceptron ........................................ 35

4.1.6 Quelques réseaux convolutifs célèbres . . . . . . . . . . . . . . . . . . . . . . . . . . 35

4.2 Réseaudeneuronesrécurrents.................................. 36

4.2.1 C’est quoi un Recurrent Neural Network (RNN) ? . . . . . . . . . . . . . . . . . . . 36

4.2.2 Apprentissage....................................... 37

4.2.3 Application........................................ 39

4.3 deepgenerativemodel ...................................... 39

5 Optimisation pour l’apprentissage en Deep Learning 39

5.1 Les variantes de la descente de gradient . . . . . . . . . . . . . . . . . . . . . . . . . . . . 39

5.1.1 Batchgradientdescent.................................. 40

5.1.2 Descente de gradient stochastique . . . . . . . . . . . . . . . . . . . . . . . . . . . 40

5.1.3 Mini-batch gradient descent . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 40

5.2 Algorithmes d’optimisation de la descente de gradient . . . . . . . . . . . . . . . . . . . . 41

5.2.1 Momentum ........................................ 41

5.2.2 Nesterov accelerated gradient . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 42

5.2.3 Adagrad.......................................... 42

5.2.4 RMSprop ......................................... 43

5.2.5 Adamoptimizer ..................................... 43

5.3 Lesméthodesdusecondordre.................................. 44

5.4 Les limites théoriques de l’optimisation . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 44

6 Les fonctions d’activation 45

6.1 Caractéristiques.......................................... 45

6.2 Quelque fonction d’activation . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 45

6.2.1 Rectified Linear Units et leur généralisations . . . . . . . . . . . . . . . . . . . . . 45

6.2.2 Sigmoïde et tangente hyperbolique . . . . . . . . . . . . . . . . . . . . . . . . . . . 46

7 Conclusion 47

IV Contribution 47

1 Introduction 49

2 Problématique étudié 49

3 Présentation des outils 49

3.1 Lesoftware ............................................ 49

3.1.1 Theano .......................................... 49

3.1.2 TensorFlow........................................ 50

3.1.3 Keras ........................................... 50

3.1.4 PyTorch.......................................... 50

3.1.5 Autresframeworks.................................... 50

3.2 Lehardware............................................ 51

4 Quelques notions 51

5 Architecture 53

6 initialisation des paramètres 54

6.1 Glorotinitialization ....................................... 54

6.1.1 Comment? ........................................ 54

7 L’apprentissage 55

7.0.1 Discussion......................................... 55

4

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

41

41

42

42

43

43

44

44

45

45

46

46

47

47

48

48

49

49

50

50

51

51

52

52

53

53

54

54

55

55

56

56

57

57

58

58

59

59

60

60

61

61

62

62

63

63

64

64

65

65

66

66

67

67

68

68

69

69

70

70

71

71

72

72

73

73

74

74

75

75

76

76

77

77

78

78

79

79

1

/

79

100%