Stats

Pougne Pandore Statistiques

Part I

Rappels et formules utiles

Ceci est plus une liste des choses à réviser qu’un rappel en soit, tout le reste se trouve dans la pougne de proba.

Il faut aussi savoir faire des calculs d’espérance. Toutes les formules ici sont à connaître, elles sont toutes utiles et

utilisées.

1 Rappels généraux

Définition d’un espace probabilisé (Ω,A, P )est un espace probabilisé où Ωun ensemble, A ∈ P(Ω) est une

tribu et Pprobabilité

Tribu borélienne B(R) = {]− ∞, a[, a ∈R}

Probabilités conditionnelles

Formule des probabilités totales Soit Cnfamille de Aoù aucun des termes n’a une probabilité nulle,

∀A∈ A, P (A) =

+∞

X

n=1

P(A|Cn)P(Cn)

Formule de Bayes

Si P(A)6= 0, P (Ci|A) = P(A|Ci)P(Ci)

+∞

X

n=1

P(A|Cn)P(Cn)

2 Espérance mathématique

Calcul v.a discrète E[X] = X

ω∈Ω

X(ω)P(ω) = X

k∈(1,...n)

anP(X=an)

v.a continue E[X] = Zω∈Ω

X(ω)dP (ω) = ZR

xdPX(x)

Propriétés

•E[X+Y] = E[X] + E[Y]

•Linéarité : E[aX +b] = aE[X] + b,a, b ∈R(⇒E[XE[X]] = E[X]2car E[X]est un scalaire)

•Formule à retenir : E[1C] = P(C)

•En pratique si les Xisont nv.a.i.i.d., E[PXi] = nE[X1]

3 Variance

Calcul V ar(X)

=E[(X−E[X])2](Définition)

=RR(x−E[X])2fX(x)dx (Théorème de transfert)

=E[X2]−E[X]2(Pour les calculs. ATTENTION à vérifier que X2est intégrable)

Covariance Définition : Cov(X, Y ) = E[(X−E[X])(Y−E[Y])] = E[XY ]−E[X]E[Y]

page 2

Pougne Pandore Statistiques

Propriétés

•V ar(aX +b) = a2V ar(X)

•V ar(X+Y) = V ar(X) + V ar(Y)+2Cov(X, Y )

•Si Xet Ysont indépendants alors E[XY ] = E[X]E[Y]et Cov(X, Y ) = 0 donc V ar(X+Y) = V ar(X) +

V ar(Y)

Ecart type σX=pV ar(X)

Relations entre les convergences

Xn

Lα

−−→ X

⇓

Xn

p.s.

−−→ X⇒Xn

P

−→ X⇒XnL

−→ X

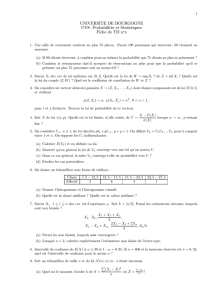

Les principales lois à connaître (minimum)

Nom Formule Espérance Variance Graph

Uniforme [a, b]fX(x) = 1

b−a1[a,b]a+b

2

(b−a)2

12

Binomiale B(n, p)P(X=k)=( n

k)pk(1 −p)n−knp np(1 −p)

Normale N(µ, σ)f(x) = 1

√2πσ2exp h−(x−µ)2

2σ2iµ σ2

Part II

Estimateurs

1 Définition

Introduction Lorsque l’on a un problème complexe avec beaucoup de données, cela devient vite intraitable.

On décide donc de prendre un échantillon, ce qui implique ne plus avoir des valeures excates mais des échantillons.

Une estimation est une valeur calculée sur un échantillon, que l’on espère proche de la valeur d’un paramètre

et qui permet de caractériser la population totale. En général, la problématique ici est de trouver le "meilleur"

estimateur.

Contexte Soient (X1, ...Xn)v.a. indépendantes de loi commune appartenant à la famille (Pθ)θ∈Θ, la famille de

modèle probabiliste (A⊂R,An⊗Pθ)θ∈Θest dite modèle statistique

2 Qualité d’un estimateur

Minimisation de l’erreur Si ˆ

Tnestimateur de t, on minimise les critères suivants :

•biais(ˆ

Tn)=|E[t−ˆ

Tn]|=|t−E[ˆ

Tn]|

•Var(ˆ

Tn)=E[(ˆ

Tn−E[ˆ

Tn])2](stabilité autour de la valeur)

•Erreur quadratique : EQM(ˆ

Tn) =E[(t−ˆ

Tn)2] = V ar(ˆ

Tn)+biais(ˆ

Tn)2

Remarque : l’erreur quadratique est UNE façon de mesurer l’erreur, mais il y en a d’autre..

page 3

Pougne Pandore Statistiques

Convergence en probabilité si ∀ > 0,lim n→+∞

−−−−−→ P(|t−ˆ

Tn|>0) = 0

Estimateur sans biais si E[ˆ

Tn] = t

Construction des estimateurs

•Sans biais (on s’arrange pour qu’après calcul, le biais soit nul)

•Maximum de vraissemblance ( b

θ(x1, ..., xn) = arg maxθlog fn

θ(x1, ...., xn))

•Méthode des moments (exemple E[X] = kθ ⇒θ=kE[X]⇒b

θn=k

nPXi

•Moindre carrés (p37)

En pratique : Il faut savoir faire des calculs d’espérance...

3 Stratégie bayésienne

Notation poly p59

•θparamètre

•ˆsestimateur

•ξv.a. de densité f

•Q= (Q1, ..., Qk)loi de ξ, probabilité "a priori"

•Qx

i=Qifi(x)

PjQjfj(x)probabilité "a posteriori"

Fonction de perte L={0si θi=θj

λi,j si θi6=θjoù λi,j modélise la gravité de l’erreur "on a choisi θiau lieu de θj

Risque R(ˆs, θ) = E[L(ˆs(X), θ)] = RRL(ˆs(x), θ)dPθ(x)

Stratégie bayésienne ou estimateur bayésien ˆsBpermet de prendre des décisions et vérifie E[L(ˆsB(X), ξ)] =

minˆsE[L(ˆs(X, ξ)]

mais surtout (2.10) [ˆsB=θm]↔[∀1≤i≤k, Pjλmj Qx

j≤Pjλij Qx

j

Probabilité d’erreur se calcule souvent grâce aux probabilités conditionnelles

Coût d’une erreur (perte moyenne) formule 2.8 E[L(ˆs(X), ξ)]

PS : Le poly est sympa, y’a plein plein d’annales à la fin...

page 4

1

/

4

100%