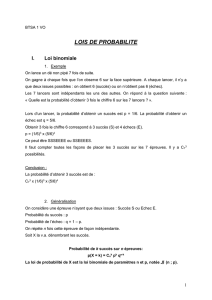

Prob(X=a)

8INF430 1

Algorithmes probabilistes

On suppose l’existence d’un générateur de

nombres aléatoires dont l’utilisation se fait à

coût unitaire.

Définition: Soit a b , deux nombres réels.

La fonction uniforme(a,b) retourne une

valeur x choisie de façon aléatoire et

uniforme dans l’intervalle [a,b]

8INF430 2

Définition: Si a et b sont deux entiers, alors

la fonction uniforme(a,b) retourne la valeur

entière a ≤ v ≤b avec probabilité 1/ (b-a+1)

Définition: Si S est un ensemble fini non

vide, alors uniforme(S) retourne la valeur v

S avec probabilité 1/|S|

8INF430 3

Nombres aléatoires et pseudo-aléatoire

Dans les années 50: Certains ordinateurs

possèdent des dispositifs apparemment aléatoires:

–compteur de particules cosmique,

–bit le moins significatif de l’horloge

Impopulaire car il devient impossible de répéter

l’exécution d’un calcul:

–Programmes difficiles à déboguer

–Difficile de comparer l’exécution de deux programmes

8INF430 4

Pour certaines applications le vrai

hasard est important:

–loteries

–cryptographie

En pratique, on utilise des générateurs

de nombres pseudo-aléatoires.

8INF430 5

Définition: Une séquence de

nombres est dite pseudo-aléatoire si

elle est générée de façon déterministe

mais semble avoir été produite de

façon purement aléatoire (passe avec

succès certains tests statistiques).

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

1

/

22

100%