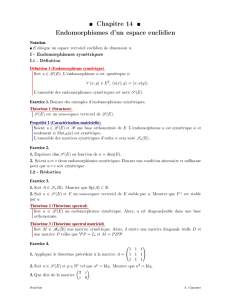

Réduction des matrices symétriques réelles

(E, < ., . >)f

E E

f

∀S∈ Sn(R),∃(Ω, D)∈On(R)×Dn(R)/ S = ΩDΩ−1

(E, < ., . >)f

E f

λ µ f λ 6=µ x λ y µ < x, y >= 0

λ, µ ∈R(f)λ6=µ x ∈SEP (f, λ)y∈SEP (f, µ)

x6= 0, y 6= 0, f(x) = λx, f(y) = µy

hλx, yi=hf(x), yi=hx, f(y)i=hx, µyi(λ−µ)hx, yi= 0 hx, yi= 0

f E

F E f F ⊥f

F E f x ∈F⊥∀y∈F, hf(x), yi=hx, f(y)i= 0

x∈F⊥f(y)∈F f(x)∈F⊥

n= dim(E)

n= 1

n≥1E n + 1

f E B1E A =B1(f)A

A=µαtC

C B ¶, α ∈R, C ∈ Mn,1(R), B ∈ Sn(R)

Ω∈On(R), D ∈Dn(R)B= ΩDΩ−1

U=µ1 0

0 Ω ¶U U−1=µ1 0

0 Ω−1¶

U−1AU =µαtCΩ

Ω−1C D ¶

G= Ω−1C A0=U−1AU =µαtG

G D ¶

•A0

G=

g1

gn

D= (d1, . . . , dn)A0=

α g1· · · gn

g1d10

gn0dn

k∈ {1, . . . , n}gk= 0 dkA0

Ek+1 ∀k∈ {1, . . . , n}, gk6= 0

λ∈R, V ∈ Mn+1,1(R)

V V =µx

X¶x∈RX∈ Mn,1(R)

A0V=λV ⇐⇒ µαtG

G D ¶µ x

X¶=λµx

X¶⇐⇒ ½αx +tGX =λx

xG +DX =λX

d1≥. . . dnλ > d1D−λIn

A0V=λV ⇐⇒ ½X=−x(D−λIn)−1G

αx −xtG(D−λIn)−1G=λx

tG(D−λIn)−1G+λ=α⇐⇒

n

X

i=1

g2

i

di−λ+λ=α

ϕ:

]d1,+∞[→R

λ7→

n

X

i=1

g2

i

di−λ+λ]d1,+∞[−∞ d+

1

+∞+∞λ∈]d1,+∞[

ϕ(λ) = α

f

•x0fRx0f(Rx0)⊥

f E 1

kx0kx0

fµλ00

0S¶λ0∈RS∈ Sn(R)

Ω1∈On(R), D1∈Dn(R)S= Ω1D1Ω−1

1Ω2=µ1 0

0 Ω1¶

D2=µλ00

0D1¶

Ω2∈On+1(R), D2∈Dn+1 (R),µλ00

0S¶= Ω2D2Ω−1

2

E f

≥2µ2i

i0¶

S={x∈E / kxk= 1}ϕ:S→R

x7→ hx, f(x)i

•ϕ E x0∈S

ϕ(x0) = sup

x∈S

ϕ(x)

•x1∈E(x0, x1)hx1, f(x0)i= 0

cos(θ)x0+ sin(θ)x1θ∈Rkcos(θ)x0+ sin(θ)x1k2= cos2(θ) + sin2(θ) = 1

ϕ(cos(θ)x0+ sin(θ)x1)≤ϕ(x0)

2 sin(θ) cos(θ)hx1, f(x0)i ≤ sin2(θ) (hx0, f(x0)i−hx1, f(x1)i)

½∀θ∈]0, π[,2 cos(θ)hx1, f(x0)i ≤ sin(θ) (hx0, f(x0)i−hx1, f(x1)i)

∀θ∈]−π, 0[,2 cos(θ)hx1, f(x0)i ≥ sin(θ) (hx0, f(x0)i−hx1, f(x1)i)

θ0+0−hx1, f(x0)i= 0

•x0f

x∈x⊥

0\{0}¿1

kxkx, f(x0)À= 0 hx, f(x0)i= 0

x⊥

0⊂(f(x0))⊥

Rx0=x⊥

0⊃(f(x0))⊥⊥ =Rf(x0)

f(x0)∈Rx0x0f

1

/

2

100%