I. les premieres formes d`apprentissage

769784939 3/18

L

LE

ES

S

T

TH

HE

EO

OR

RI

IE

ES

S

D

DE

E

L

L’

’A

AP

PP

PR

RE

EN

NT

TI

IS

SS

SA

AG

GE

E

I. LES PREMIERES FORMES D’APPRENTISSAGE

A. L’HABITUATION

L’habituation est généralement considérée comme la forme la plus simple d’apprentissage.

Elle se rencontre dans tout le règne animal, des protozoaires à l’homme.

L’habituation est la diminution de l’intensité, de l’amplitude ou de la durée d’une réponse,

réponse comportementale, végétative ou nerveuse. C’est donc la diminution puis la

disparition de cette réponse lors de la répétition du stimulus évocateur.

Exemple :

Si l’on présente à un enfant le même objet plusieurs fois de suite, on constate que le temps

pendant lequel l’enfant fixe l’objet diminue. Si l’objet change, le temps de fixation

augmente à nouveau. C’est ce qu’on appelle « la réaction à la nouveauté ».

Depuis 1963, on considère l’habituation comme une forme d’apprentissage.

B. L’EMPREINTE

L’empreinte est issue des anthropologistes qui étudient les animaux.

Le petit apprend à reconnaître sa mère quelques heures après sa sortie de l’œuf, ce qui lui

permet de la suivre dans tous ses déplacements. Ainsi, on a pu observer que l’oisillon

développe une préférence envers un objet qui, dans les premières heures qui suivent

l’éclosion, se trouve dans son environnement. On observe des conduites de poursuite à

l’égard d’un stimulus qui peut n’avoir aucun caractère commun avec la mère biologique.

L’empreinte correspond donc à une acquisition brusque par un jeune au cours d’une

période biologiquement privilégiée.

769784939 4/18

Toutefois, 3 caractéristiques sont nécessaires :

Il faut d’une part une période critique, il faut que l’objet soit mobile.

Les conséquences sont très importantes sur son devenir. L’empreinte sociale que va subir

l’animal a une influence sur sa future vie. Les effets sont irréversibles.

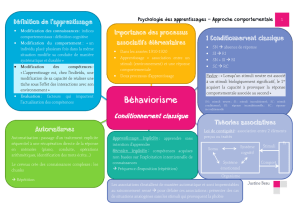

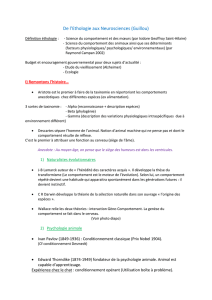

II. LES THEORIES BEHAVIORISTES

A. LA LOI DE L’EFFET OU APPRENTISSAGE PAR « ESSAIS ET ERREURS »

1. PRESENTATION

La loi de l’effet ou apprentissage par « essais et erreurs » a été initialement étudié par

Thorndike (1874 – 1944).

La plus connue de ses expériences a été conduite sur des chats qui sont placés dans des

boîtes que l’on appellera plus tard « des boîtes à problèmes ». Elles sont munies d’un

dispositif permettant l’ouverture d’une porte par le chat. On enferme donc un chat affamé

et on met de la nourriture en dehors de la cage pour l’attirer.

Des réactions comportementales ont été observées, le chat tourne dans la cage, la griffe, la

mord et se dresse sur ses pâtes arrières.

Comme par hasard, la cage va s’ouvrir. Il a appris par essais et erreurs et s’il recommence,

il ouvrira la cage beaucoup plus rapidement. Il y a eu un apprentissage.

La nourriture à l’extérieure de la cage est une forme de récompense pour le motiver à

sortir.

Cette forme d’apprentissage est un processus associatif caractérisé par la formation de

connexions entre un stimulus (S) et une réponse (R).

S R

Eléments de situation Eléments de réponse

Cage expérimentale Ouvrir la porte de la cage

A partir de ces études des lois de l’apprentissage ont été mises en avant. On peut citer des

lois principales et des lois secondaires.

769784939 5/18

2. LOIS PRINCIPALES

Loi de l’exercice ou de l’oubli

Plus le nombre d’essais augmente, moins l’animal fait d’erreurs.

En revanche, si on se limite dans le nombre d’essais, il y a oubli donc pas de connexion et

pas d’apprentissage Le non-exercice provoque l’oubli.

Loi de l’effet

Une connexion S – R peut être renforcée mais aussi affaiblie par l’effet de ses

conséquences.

Si à la sortie de la cage on donne à l’animal de la nourriture, il y a un effet positif alors que

s’il ouvre et qu’on lui donne une décharge électrique il n’appréciera pas. La connexion

sera affaiblie et il n’aura aucun intérêt à essayer d’ouvrir la porte.

Ces deux lois sont principales car ce sont les conditions nécessaires à l’apprentissage.

3. QUELQUES LOIS SECONDAIRES

Réponses multiples

Il faut que le sujet ait un répertoire de réponses suffisamment variées.

Si ses capacités réactionnelles sont insuffisantes ou si elles sont peu diversifiées, la

réalisation d’un apprentissage par essais et par erreurs devient improbable.

Attitudes

La motivation est un déterminant majeur de l’apprentissage. Si par exemple on met un

chat qui a bien mangé il ne cherchera pas à sortir de la cage.

Réponses par analogie

Lorsqu’une situation antérieure a donné lieu à un certain type de comportement, une

situation nouvelle similaire à la précédente tendra à provoquer un comportement identique

ou analogue.

4. CONCLUSION

Il existe des mécanismes similaires en ce qui concerne l’apprentissage humain.

C’est une théorie toujours d’actualité, notamment reprise dans les sciences de l’éducation

(concept de transfert).

Il y a une importance de la loi de l’effet avec le principe de renforcement et de punition.

769784939 6/18

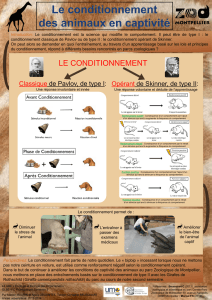

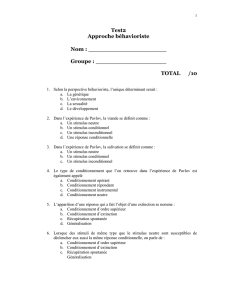

B. LE CONDITIONNEMENT CLASSIQUE OU CONDITIONNEMENT

REPONDANT

1. QUELQUES POINTS

On doit le conditionnement répondant à Ivan PAVLOV (1849 – 1936) qui a reçu le prix

Nobel de physiologie et de médecine en 1904.

Il a fait l’étude physiologique de la sécrétion salivaire chez le chien pour décrire la réponse

ou la réaction conditionnelle classique.

Cette réaction ou cette réponse conditionnelle repose sur la possibilité pour un organisme

d’acquérir et de retenir l’association de 2 stimuli de telle sorte qu’une réponse (salivation)

naturellement provoquée par un stimulus (viande) dit « inconditionnel » puisse après

apprentissage être obtenue par le second (son) dit « conditionnel ».

2. LA REACTION CONDITIONNELLE

La réaction conditionnelle va se construire à partir de plusieurs éléments :

Réaction inconditionnelle (RI)

= la salivation : Un chien salive sans apprentissage.

Stimulus inconditionnel (SI)

La poudre de viande suscite un réflexe de salivation. Ce n’est pas encore un apprentissage.

Stimulus neutre (SN)

Une sonnerie ne déclenche pas de salivation chez le chien.

Stimulus conditionnel (SC)

Un son est capable dans l’apprentissage de susciter une réponse de type salivation.

Réaction conditionnelle (RC)

C’est une réponse réflexe déclenchée artificiellement (salivation).

Le conditionnement classique consiste donc en une opération qui va rendre efficace

l’action d’un stimulus qui ne l’était pas auparavant.

769784939 7/18

Schéma de l’expérimentation

Il va y avoir association de 2 stimuli (viande + sonnerie), si bien que le chien, après

conditionnement, sera capable de saliver à l’unique son de la cloche.

Avant le conditionnement :

Stimulus Neutre (SN) aucune réponse ou

(cloche) réponse d’orientation

Stimulus Inconditionnel (SI) Réaction Inconditionnelle (RI)

(nourriture) (salivation)

Durant le conditionnement :

Stimulus Conditionnel (SC)

(cloche)

Réponse Inconditionnelle (RI)

Stimulus Inconditionnel (SI) (salivation)

(nourriture)

Après le conditionnement :

Stimulus Conditionnel (SC) Réaction Conditionnelle (RC)

(cloche) (salivation)

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

1

/

18

100%