Cours 2.key

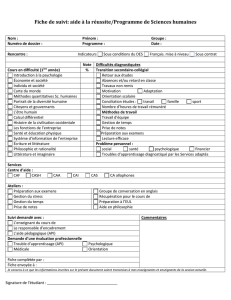

DÉFINITION DU WEB SCRAPING

•Récolte de données à partir de pages web à l’aide d’un

programme

•Peu de contraintes : tout ce qui est visible à l’écran est

techniquement récupérable

•Règle de bonne conduite : délai entre les requêtes pour éviter

de surcharger le serveur web

•Risque de blocage de l’adresse IP

•Peut être illégal : certains sites interdisent la récupération

automatique de leur contenu

•La qualité du contenu récupéré dépend de la qualité du

formatage de la page HTML

<!DOCTYPE html>

<html>

<head>

<meta charset="utf-8">

<title>Proverbes</title>

<link rel="stylesheet" type="text/css" href="style.css">

</head>

<body><!-- éléments visibles à l’écran -->

<h1 id="titre_principal">Proverbe du jour</h1>

<div class="proverbe">

<p lang="en">Once bitten, twice shy.</p>

<p lang="fr">Chat échaudé craint l'eau froide.</p>

</div>

</body>

</html>

STRUCTURE D’UN FICHIER HTML

•Balises

•Attributs

•Identifiants (chaque

valeur doit être unique

dans le document)

•Classes

STRUCTURE D’UN FICHIER HTML : BALISES

<title>

Titre de la page

<link />

Lien vers une feuille de style

<meta />

Métadonnée de la page (mots-clés, encodage, auteur, …)

<div><span>

Balises génériques pour organiser le contenu,

particulièrement intéressantes lorsqu’elles sont associées à

un attribut class ou id

<h1> à <h6>

Titres

<p>

Paragraphe

<a>

Lien hypertexte

<img />

Image

<br/>

Retour à la ligne

<abbr>

Abréviation

<ul><ol><dl>

Listes

<table>

Tableau

<form>

Formulaire

<style>

Code CSS

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

1

/

28

100%