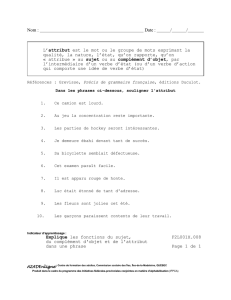

Data Mining With Decision Trees

DATA MINING

Arbres de décision

Juan Manuel Torres

www.lia.univ-avignon.fr/chercheurs/torres/cours/dm

LIA / Université d'Avignon

Octobre 2006

Généralités

3

Arbres de décision (1)

Structure de données utilisée comme modèle pour la

classification [Quinlan]

Méthode récursive basée sur diviser-pour-régner pour créer des

sous-groupes (plus) purs (un sous-groupe est pur lorsque tous les

éléments du sous-groupe appartiennent à la même classe)

Construction du plus petit arbre de décision possible

4

Arbres de décision (2)

Nœud = Test sur un attribut

Une branche pour chaque valeur d’un attribut

Feuilles : désignent la classe de l’objet à classer

Taux d’erreur: proportion des instances qui

n’appartiennent pas à la classe majoritaire de la

branche

Problèmes: Choix de l’attribut, terminaison

5

Algorithmes

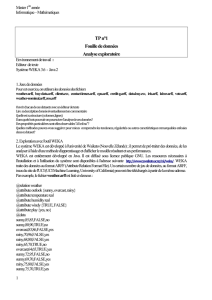

2 algorithmes les plus connus et les plus utilisés (l'un ou

l'autre ou les deux sont présents dans les

environnements de fouille de données) : CART

(Classification And Regression Trees [BFOS84]) et C5

(version la plus récente après ID3 et C4.5 [Qui93]).

[BFOS84] L. Breiman, J. H. Friedman, R. A. Olshen, and C. J.

Stone. Classification and regression trees. Technical report,

Wadsworth International, Monterey, CA, 1984

[Qui93] J. R. Quinlan. C4.5: Programs for Machine Learning.

Morgan Kaufmann, San Mateo, CA, 1993

6

Découpages

Données IRIS

Les décisions

correspondent à des

découpages des

données en

rectangles

7

I.H. Witten and E. Frank, “Data Mining”, Morgan Kaufmann Pub., 2000.

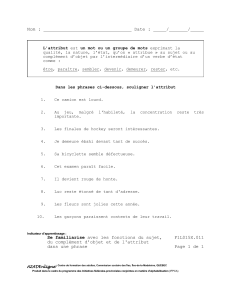

Météo et match de foot

Attribut

2 classes: yes et

no

Prédire si un

match de foot va

avoir lieu ou non

Température est

un nominal

8

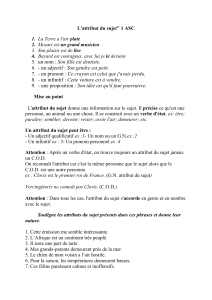

2 classes: yes et no

Température est un numérique

Météo et match de foot

I.H. Witten and E. Frank, “Data Mining”, Morgan Kaufmann Pub., 2000.

9

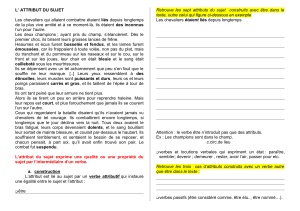

Quel attribut faut-il sélectionner?

Classe:

NO

Classe

:YES

Classe

: YES

10

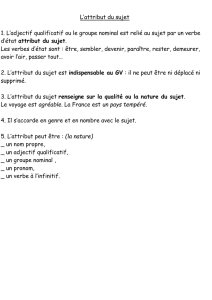

Arbre de décision final

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

1

/

27

100%