RÉALISATION D`UN MODÈLE DE FILTRAGE DE DONNÉES THIẾT

UNIVERSITE NATIONALE DU VIETNAM, HANOI

INSTITUT FRANCOPHONE INTERNATIONAL

POLLA DE NDJAMPA Félix-Bazin

RÉALISATION D’UN MODÈLE DE FILTRAGE DE DONNÉES

THIẾT LẬP MỘT MÔ HÌNH LỌC DỮ LIỆU

MEMOIRE DE FIN D’ETUDES DU MASTER INFORMATIQUE

HANOI – 2015

ATTESTATION SUR L’HONNEUR

J’atteste sur l’honneur que ce mémoire a été réalisé par moi-même et que les

données et les résultats qui y sont présentés sont exacts et n’ont jamais été publiés

ailleurs. La source des informations citées dans ce mémoire a été bien précisée.

LỜI CAM ĐOAN

Tôi cam đoan đây là công trình nghiên cứu của riêng tôi.

Các số liệu, kết quả nêu trong Luận văn là trung thực và chưa từng được ai

công bố trong bất kỳ công trình nào khác. Các thông tin trích dẫn trong Luận văn

đã được chỉ rõ nguồn gốc.

Signature de l’étudiant

POLLA DE NDJAMPA Félix-Bazin

Table des matières .......................................................................................................... iii

Remerciements ................................................................................................................ v

Résumé ........................................................................................................................... vi

Abstract ......................................................................................................................... vii

Liste des figures ........................................................................................................... viii

Liste des tableaux ........................................................................................................... ix

Introduction ..................................................................................................................... 1

Chapitre 1 ........................................................................................................................ 3

Synthèse bibliographique ................................................................................................ 3

Contexte : .................................................................................................................... 3

1.1. Langages de représentation des connaissances ............................................ 3

1.1.1 Graphe conceptuel ...................................................................................... 4

1.1.2 Langage du Web Sémantique ..................................................................... 4

1.1.3 Tableau comparatif des GC et OWL2 ........................................................ 5

1.2. L’apprentissage automatique ......................................................................... 6

1.2.1 Généralités sur la programmation logique inductive (PLI) ....................... 7

1.2.2 Apprentissage sur des ontologies (OWL) ................................................... 8

1.2.2.1. DL-Foil ................................................................................................ 9

1.2.2.2. DL-Learner ........................................................................................ 10

1.2.2.3. YINYANG (Yet another INduction Yields to ANother

Generalization) .................................................................................................. 12

1.2.2.4. Tableau comparatif ............................................................................ 13

Conclusion ................................................................................................................ 14

Chapitre 2 - Apports ...................................................................................................... 15

Approche méthodologique ............................................................................................ 15

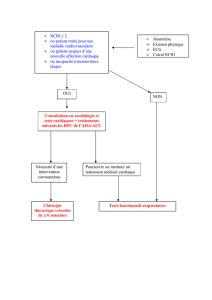

2.1. Etape de génération du modèle de situation .................................................... 16

2.2. Étape1 : Modélisation de la base de connaissance .......................................... 17

2.3. Étape 2 : Extraction d’exemples positifs ......................................................... 18

iv

2.4. Étape 3 : Apprentissage ................................................................................... 19

2.4.1 Définition de quelques notions ................................................................. 21

2.4.2 Définition de l’opérateur de raffinement .................................................. 22

2.4.3 Propriétés de l’opérateur de raffinement ................................................. 24

2.4.4 Preuve des propriétés de l’opérateur de raffinement ............................... 25

2.4.5 Algorithme d’obtention de modèles .......................................................... 26

Conclusion ................................................................................................................ 28

Chapitre 3 ...................................................................................................................... 29

Expérimentation et analyses des résultats .................................................................... 29

3.1. Présentation des cas d’étude ..................................................................... 29

3.1.1. Scénario d'apprentissage .................................................................... 29

3.1.2. Les paramètres d’expérimentations ................................................... 30

3.1.3. Critères d’évaluation .......................................................................... 31

3.2. Résultats d'expérimentations et interprétations ........................................ 31

3.2.1. Résultat du scénario 1 ........................................................................ 32

3.2.2. Interprétations des résultats du scénario1 ......................................... 33

3.2.3. Résultat du scénario 2 ........................................................................ 34

3.2.4. Interprétations des résultats du scénario 2 ........................................ 36

Conclusion .................................................................................................................... 38

Perspectives ................................................................................................................... 39

Références ..................................................................................................................... 41

ANNEXES A : Présentation de tous les modèles de situation du scénario 1 .............. 44

ANNEXES B : Opérateur de DL learner ...................................................................... 47

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

41

41

42

42

43

43

44

44

45

45

46

46

47

47

48

48

49

49

50

50

51

51

52

52

53

53

54

54

55

55

56

56

57

57

1

/

57

100%