Document

Cours 4

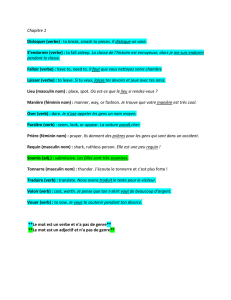

Étiquettes lexicales

Catégories grammaticales

En anglais parts of speech (POS)

Exemple de liste de catégories grammaticales

nom, verbe, adjectif, adverbe, pronom, préposition, conjonction,

déterminant

En général, 10 à 15 catégories par langue

Information sur les voisins du mot

Un pronom est souvent suivi d'un verbe : il intervient

Un déterminant est souvent suivi d'un nom : les annonces

Information sur la prononciation du mot

Président peut être un nom : Le président de séance est en retard

Président peut être un verbe : Ils président la séance à tour de rôle

La prononciation est différente

Les poules du couvent couvent

Catégories grammaticales

Catégories grammaticales et suffixes

vaccine est un verbe, on peut le regrouper avec vacciner

féminine est un adjectif, on peut le regrouper avec féminin

Application : la recherche d'informations

Catégories grammaticales et pertinence

Les noms sont souvent pertinents : balle, film, banque...

Les prépositions le sont moins : selon, depuis, malgré...

une croix en or et pierres précieuses... nom

Or la version de la chanson... conjonction

Définition des catégories grammaticales

Par les suffixes

Deux mots qui prennent les mêmes suffixes ont des chances d'appartenir à

la même catégorie

vaccine, vaccinent, vacciné, vaccines/juge, jugent, jugé, juges verbes

parent, parents, parente, parentes/ami, amis, amie, amies noms

Par les contextes

Deux mots qui acceptent les mêmes contextes ont des chances d'appartenir

à la même catégorie

Les représentants des pays concernés

Les représentants des partis concernés noms

Le TGV n'avait pas prévu de s'arrêter

Le TGV n'avait pas cessé de s'arrêter verbes

Catégories ouvertes/fermées

Catégories fermées

Les éléments sont en nombre limité et fixe

Mots grammaticaux (jouent un rôle important dans la grammaire), courts

et fréquents

Prépositions : à de par pour sans selon depuis malgré...

Quelques dizaines

On en crée rarement de nouvelles

Catégories ouvertes

Les éléments sont nombreux et de nouveaux sont créés continuellement

Noms : futon MP3 pseudotéléspectateur triréacteur...

Quelques dizaines de milliers

Verbes : faxer surréglementer sursubventionner télécopier...

Quelques milliers

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

1

/

27

100%