BCI - TPSP - Électronique Numérique Intégrée

BCI - TPSP - Électronique Numérique Intégrée

Jean-Luc Danger

Sylvain Guilley

Philippe Matherat

Yves Mathieu

Lirida Naviner

Alexis Polti

Jean Provost

26 septembre 2005

Résumé

Polycopié des cours du module ENI (Électronique Numérique Intégrée) de Telecom Paris.

Le polycopié est disponible au format PDF à l’adresse suivante :

http ://www.comelec.enst.fr/tpsp/eni/poly/eni.pdf

L’accès est libre depuis l’ENST ou Eurécom.

Les corrigés des TD sont accessibles à l’adresse suivante :

http ://www.comelec.enst.fr/tpsp/eni/poly_corr/

Cours 1A Cours 2A Intitulé

L1 L1 Traitement matériel de l’information (chapitre 1page 21)

LG2 LG2 Fonctions de base, bibliothèque (chapitre 2page 35)

LG3 LG3 Opérateurs arithmétiques (chapitre 3page 49)

TD1 TD1 Fonctions de base : applications (chapitre 10 page 167)

TP9 TP3 Combinatoire dans CLP

L1 SC L4 Du Silicium aux transistors (chapitre 4page 59)

L4 L5 Du Transistor à la logique complémentaire (chapitre 5page 83)

TD2 TD2 Analyse et synthèse de portes logiques (chapitre 12 page 173)

L5 L6 Performances de la logique complémentaire CMOS (chapitre 6page 99)

TD3 TD3 Temps de propagation, surface, bibliothèques (chapitre 13 page 177)

TP10 TP4 Caractérisation électrique de portes

LG6 LG7 Logique séquentielle synchrone, bascules (chapitre 7page 111)

TD4 TD4 Utilisation des bascules (chapitre 14 page 181)

LG7 LG8 Machines à états finis (chapitre 8page 125)

TD5 TD5 Utilisation et synthèse des machines à états (chapitre 15 page 185)

TP11 Machines à états dans CLP

LG8 LG9 Processeurs (chapitre 9page 143)

LG9 Processeurs (2) (chapitre 9page 143)

TP12 TP5 Nano processeur dans CLP

CC CC Contrôle de connaissances

2

Table des matières

Table des matières 3

Liste des tableaux 11

Table des figures 15

I Leçons 19

1 Traitement matériel de l’information 21

1.1 Du composant au systèmes numériques ......................... 21

1.2 Signal et Information ................................... 22

1.2.1 Signal électrique et traitement de l’information ................ 22

1.2.2 Codage analogique de l’information : l’exemple du signal sonore . . . . . . . 24

1.2.3 Codage numérique de l’information ....................... 24

1.2.4 L’exemple du signal binaire ........................... 26

1.3 Le signal binaire représenté par une grandeur électrique ............... 27

1.3.1 Comment peut-on générer un signal électrique binaire ? ........... 27

1.3.2 Comment peut-on extraire un symbole binaire d’un signal électrique ? . . . 27

1.3.3 Comment peut-on créer un opérateur de traitement binaire ? . . . . . . . . 29

1.4 La technologie micro-électronique ............................ 29

1.4.1 Quelles propriétés des matériaux peut-on exploiter pour créer des transistors ? 30

1.4.2 Quelles sont les différentes étapes de la fabrication des circuits intégrés ? . . 31

1.5 Les filières technico-économiques ............................ 31

1.5.1 La recherche d’un optimum de rendement dans l’utilisation de la technologie 31

1.5.2 Les circuits « universels » tels les microprocesseurs .............. 32

1.5.3 Les circuits spécifiques à une application .................... 32

1.5.4 Les circuits logiques programmables ...................... 33

1.5.5 Les systèmes intégrés sur puces ......................... 33

1.6 Bibliographie ....................................... 33

2 Fonctions de base 35

2.1 Introduction ........................................ 35

2.2 Variables et fonctions logiques, tables de vérité .................... 35

2.3 Représentations des fonctions logiques ......................... 36

2.3.1 Formes algébriques ................................ 36

2.3.2 Forme disjonctive ................................. 36

2.3.3 Forme conjonctive ................................ 37

2.3.4 Équivalence entre la table de vérité et les formes canoniques . . . . . . . . . 37

2.3.5 Forme canonique disjonctive ........................... 37

2.3.6 Forme canonique conjonctive .......................... 38

2.4 Description de méthodes de simplification ....................... 38

2.4.1 Utilisation des propriétés de l’algèbre de Boole ................ 39

2.4.2 Simplification à partir de la forme algébrique ................. 39

2.4.3 Méthode des tables de Karnaugh ........................ 40

3

4TABLE DES MATIÈRES

2.4.4 Construction du tableau de Karnaugh ..................... 40

2.4.5 Règles de simplification ............................. 41

2.4.6 Fonctions non complètement définies ...................... 42

2.4.7 Pertinence de la méthode ............................ 42

2.5 Représentation schématique des fonctions logiques .................. 43

2.6 Quelques fonctions combinatoires importantes ..................... 44

2.6.1 Fonctions d’aiguillage : multiplexeurs ...................... 44

2.6.2 Opérateurs de comparaison ........................... 44

2.7 Annexes .......................................... 46

2.7.1 Exercice de consolidation ............................ 46

2.7.2 Bibliographie ................................... 48

3 Opérateurs arithmétiques 49

3.1 Introduction ........................................ 49

3.2 Représentation (codage) des nombres .......................... 49

3.2.1 Représentation Simples de Position ....................... 49

3.2.2 Conversions entre Bases ............................. 50

3.2.3 Représentation en Signe et Valeur Absolue .................. 51

3.2.4 Représentation en Complément à 2 ....................... 51

3.2.5 Autres Codes ................................... 52

3.3 Fonctions arithmétiques ................................. 53

3.3.1 Additionneur ................................... 53

3.3.2 Soustracteur ................................... 55

4 Du silicium aux transistors 59

4.1 Introduction ........................................ 59

4.1.1 Historique ..................................... 59

4.1.2 Objectifs ..................................... 59

4.1.3 Organisation de la leçon ............................. 59

4.2 Circuit élémentaire .................................... 60

4.3 Rappels de physique simplifiée ............................. 61

4.3.1 Notion de courant ................................ 61

4.3.2 Conducteur, semi-conducteur, dopages ..................... 62

4.3.3 La jonction PN .................................. 65

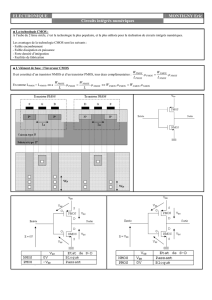

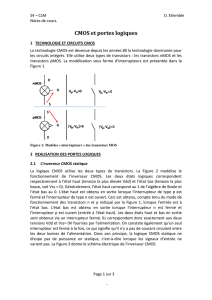

4.4 Composants MOS .................................... 66

4.4.1 Première étape : la résistance .......................... 66

4.4.2 Seconde étape : la diode ............................. 67

4.4.3 Troisième étape : le transistor bipolaire .................... 67

4.5 Le transistor MOS .................................... 68

4.5.1 Le fonctionnement des transistors CMOS ................... 68

4.5.2 Connexions des transistors ........................... 70

4.6 Modèle électrique ..................................... 70

4.6.1 Les jonctions ................................... 70

4.6.2 Formation du canal : la capacité MOS CGB .................. 70

4.6.3 Le courant drain-source (VGB > VTN)..................... 72

4.6.4 Le condensateur élémentaire ........................... 72

4.6.5 Calcul de IDS ................................... 73

4.6.6 Le courant IDS en résumé ............................ 76

4.6.7 La tension de seuil ................................ 76

4.6.8 Conclusion sur le courant IDS .......................... 78

4.6.9 Modélisation des capacités ............................ 78

4.6.10 Schéma du modèle ................................ 79

4.7 Caractéristiques de la technologie CMOS ....................... 80

4.7.1 Intégrabilité .................................... 80

4.7.2 Diminution des géométries “scaling down” ................... 80

4.8 Bibliographie ....................................... 81

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

41

41

42

42

43

43

44

44

45

45

46

46

47

47

48

48

49

49

50

50

51

51

52

52

53

53

54

54

55

55

56

56

57

57

58

58

59

59

60

60

61

61

62

62

63

63

64

64

65

65

66

66

67

67

68

68

69

69

70

70

71

71

72

72

73

73

74

74

75

75

76

76

77

77

78

78

79

79

80

80

81

81

82

82

83

83

84

84

85

85

86

86

87

87

88

88

89

89

90

90

91

91

92

92

93

93

94

94

95

95

96

96

97

97

98

98

99

99

100

100

101

101

102

102

103

103

104

104

105

105

106

106

107

107

108

108

109

109

110

110

111

111

112

112

113

113

114

114

115

115

116

116

117

117

118

118

119

119

120

120

121

121

122

122

123

123

124

124

125

125

126

126

127

127

128

128

129

129

130

130

131

131

132

132

133

133

134

134

135

135

136

136

137

137

138

138

139

139

140

140

141

141

142

142

143

143

144

144

145

145

146

146

147

147

148

148

149

149

150

150

151

151

152

152

153

153

154

154

155

155

156

156

157

157

158

158

159

159

160

160

161

161

162

162

163

163

164

164

165

165

166

166

167

167

168

168

169

169

170

170

171

171

172

172

173

173

174

174

175

175

176

176

177

177

178

178

179

179

180

180

181

181

182

182

183

183

184

184

185

185

186

186

187

187

188

188

189

189

190

190

191

191

192

192

193

193

194

194

195

195

196

196

197

197

198

198

199

199

200

200

201

201

202

202

203

203

204

204

205

205

206

206

207

207

208

208

209

209

210

210

211

211

212

212

213

213

214

214

215

215

216

216

217

217

218

218

219

219

220

220

221

221

222

222

223

223

224

224

225

225

226

226

227

227

228

228

229

229

230

230

231

231

232

232

233

233

234

234

235

235

1

/

235

100%