fonctionnement de l` ordinateur

FONCTIONNEMENT DE L’ ORDINATEUR

Date : Octobre 2005

But : Quelle image de la société et de l'homme véhicule l'objet ordinateur? Comment fonctionne-t-il?

Statut du document : Assemblages simples d’extraits glanés sur Internet (ressources disponibles en fin de

chapitre) et sur quelques livres.

Pour toutes remarques : [email protected]

Quelques pionniers : Von Neumann (architecture machine), Shannon (binaire/contacteurs, théorie de

l'information), Norbert Wiener (cybernétique), Turing (machine universelle), Babbage et Ada Lovelace

(machine analytique), Vannevar Bush (memex).

Un objet porteur de sens

Le projet cybernétique

Au-delà des prouesses techniques et de l'ingéniosité du système, que nous allons

aborder par la suite, les idées qui portent le développement de l'ordinateur se retrouvent

essentiellement dans le projet cybernétique. Un projet mené presque exclusivement par des

scientifiques. Ces derniers ont joué depuis la révolution industrielle une importance de plus en

plus grande dans la transformation de la société à travers la technique. Les effets de la

cybernétique sont visibles dans l'émergence de nouveaux domaines de recherches et

d'application comme la systémique, la théorie de la communication et de l'information,

l'intelligence artificielle, la bio-informatique, la robotique, etc... Tous ces domaines en

imbriquent d'autres qui s'interpénètrent, comme l'économie, l'art, la philosophie et bien

entendu la politique. La société occidentale, et maintenant le monde, dans son ensemble ont

été transformés. Il est néanmoins important de noter le malentendu souvent volontaire qui

enveloppe ces idées pour justifier une idéologie du progrès, avec un arrière goût amer de

totalitarisme.

Pour un panorama plus détaillé de la cybernétique et de son rapport avec la société :

http://www.terminal.sgdg.org/articles/61/identitespouvoirslacroix.html

http://perso.wanadoo.fr/metasystems/Cybernetics.html

La cybernétique : Une nouvelle science

"(...) le mot cybernétique, que j'ai fait dériver du mot grec kubernetes, ou "pilote", le

même mot grec dont nous faisons en fin de compte notre mot "gouverneur". Par ailleurs, j'ai

trouvé par la suite que ce mot avait été déjà employé par Ampère en référence à la science

politique, et qu'il avait été introduit dans un autre contexte par un savant polonais, cet

emploi, dans les deux cas, datant des premières années du XIXe siècle."(extrait de la

traduction francaise "cybernétique et société" de Norbert Wiener, 1948)(2)

"La cybernétique est une science du contrôle des systèmes, vivants ou non-vivants,

fondée en 1948 par le mathématicien américain Norbert Wiener. Notre monde est

2.FonctionnementOrdinateur.doc Page 1 sur 22

intégralement constitué de systèmes, vivants ou non-vivants, imbriqués et en interaction.

Peuvent ainsi être considérés comme des "systèmes": une société, une économie, un réseau

d'ordinateurs, une machine, une entreprise, une cellule, un organisme, un cerveau, un

individu, un écosystème…" (1)

Une représentation informationnelle de l'Homme

Le but est de construire une réplique de l'homme via son cerveau et uniquement son

cerveau. C’est une approche de l'homme sous l'angle presque exclusif de son intelligence,

définie comme capacité à traiter et échanger de l'information, c’est-à-dire calculer et

communiquer. Le calcul va ainsi se substituer progressivement à la perception humaine. To

compute, "calculer", et son dérivé computer, ou "calculateur" sera d'ailleurs le terme anglais

choisi pour désigner cette machine.

La cybernétique, c'est aussi une réflexion sur la société. Elle propose une

représentation de l'Homme purement social, sans organes, vivant sans conflits dans une

société autorégulé. C’est une position profondément égalitaire, une fusion de disciplines qui

va à l’encontre de toutes les hiérarchies.

"L'utopie de la communication : le mythe du village planétaire », Philippe Breton, Paris, La découverte, 1997.

"A l'image de l'homme ; du golem au créatures virtuelles", Philippe Breton, éd. du Seuil, novembre 1995.

Malgré cela, l'usage travesti de ces idées a aussi permis l'apparition d'un nouveau type

de guerre que l'on aime appeler la guerre "propre" pour se distinguer de façon illusoire de

guerres plus primitives, où le contact humain était obligatoire. Ce type de guerre est à la fois

une guerre à distance (missiles téléguidés, avions, ...) et une guerre de l"information et du

renseignement (satellites, surveillance, cryptage, reconnaissance, médias, ...).

2.FonctionnementOrdinateur.doc Page 2 sur 22

L' Homme transparent

Dresde, Deutsches Hygiene-Museum, 1911

Modèle numérique / modèle analogique

Pour créer une machine qui tend vers une forme d'intelligence, Alan Turing et John

Von Neumann (tout deux pionniers de l'informatique) l'imaginent comme un enfant qui

apprendrait, donc dans le langage cybernétique, qui stockerait de l'information. Turing pense

même que le siège du raisonnement se situe dans la mémoire.

Pour stocker ces informations, ils perfectionnent le modèle numérique, qui prendrait

son origine du boulier chinois et par la suite, de la recherche d'un certain nombre de

mathématiciens ou scientifiques géniaux tout au long de l'histoire (voir le fichier

"HistoriqueOrdinateur.doc" pour avoir plus de renseignements). On peut distinguer le modèle

numérique du modèle analogique de la façon suivante :

- le modèle analogique transforme une énergie en une autre, en

sympathie et en continu.

- le modèle numérique transforme une énergie en une suite discontinue

(ou discrète) d'états "tout ou rien".

Par exemple dans le domaine de l'enregistrement sonore, le numérique permet

d'enregistrer et de dupliquer sans fin les informations, sans y ajouter de "bruits" (terminologie

adoptée dans la théorie de l'information), contrairement à un enregistrement analogique.

Codage et perception

Turing et Neumann s’appuient sur une croyance : le cerveau fonctionnerait sur un

mode discret, par "changements d'états successifs". Neumann est persuadé que les tubes à

vide peuvent constituer un strict équivalent aux neurones humains. La perception peut,

effectivement, être considérée comme une transformation d'évènements continus en

évènements discontinus. Par exemple, en deçà du seuil d'audition, en dessous de 20 Hz, dans

le domaine des infrasons, l'oreille cesse de percevoir une vibration continue, pour la

remplacer par une série de pulsations discrètes.

Les sensations ne sont pourtant pas linéaires et toutes égales, on dit qu'elles sont liées

aux phénomènes physiques par des lois logarithmiques. Toute perception est relative, elle

dépend de l'âge, de l'expérience, de l'attention, et de bien d'autres paramètres. Il est commun

de dire par exemple que la sensation de temps est élastique. Emile Leipp précise, à propos de

l'audition, que "contrairement à ce qui est encore soutenu couramment, et l'expérience le

montre bien, le système auditif humain n'est pas un système d'analyse spectrographique et de

mesure. Aucun auditeur au monde n'est capable de dire : "tel son à 972 Hz, 87 dB, 35

harmoniques, ce son dure 98 ms, etc..."" Notre intelligence ne fonctionne pas comme un

mécanisme infaillible et objectif. Turing l’avait compris : "Si une machine n'a pas le droit à

l'erreur, on ne peut attendre d'elle qu'elle soit intelligente".

"L'utopie de la communication : le mythe du village planétaire », Philippe Breton, Paris, La découverte, 1997.

"A l'image de l'homme ; du golem au créatures virtuelles", Philippe Breton, éd. du Seuil, novembre 1995.

« Acoustique et musique » , Emile Leipp, 1989, éd. Masson.

2.FonctionnementOrdinateur.doc Page 3 sur 22

La sensation de continuité de notre perception ne serait qu'une illusion, comme

l'illusion du mouvement au cinéma, le modèle discret serait dans la structure même de

l'univers ! Comme le décrit Albert Jacquart : "La physique quantique, développée à partir

d'une hypothèse proposée par Max Planck en 1900, a pris en compte le caractère « granulaire

» de la plupart des caractéristiques décrivant le monde réel. La longueur, la masse, et même la

durée ne peuvent être non seulement mesurées mais définies en dessous d'un certain seuil :

compte tenu de la nature même de notre univers, aucune longueur plus petite que 1,6.10-33

cm, aucune masse inférieure à 2,2.10-5 grammes, aucune durée moindre que 5. 10-44

secondes ne peut avoir d'existence. Il ne s'agit pas d'une limite technique provisoire que des

progrès dans la précision de nos instruments permettraient de repousser, il s'agit de la

structure même de la réalité du monde où nous vivons." (Albert Jacquart, la Science à l'usage

des non scientifiques, p148)

La clé : Boole - binaire - interrupteurs

L'idée géniale est énoncée par Claude Shannon entre 1937 et 1938, dans la thèse qu'il

présenta au M.I.T (Massachusetts Institute of Technology) de Boston. Il y démontra comment

l'algèbre de Boole pourrait être utilisé dans l'analyse et la synthèse de relais

électromagnétiques (interrupteurs) (3). Il démontre qu'à l'aide de "contacteurs" fermés pour

"vrai" et ouverts pour "faux" on peut effectuer des opérations logiques en associant le nombre

"1" pour "vrai" et "0" pour "faux" (4). Il définit le chiffre binaire ou bit, abréviation de BInary

digiT, autrement dit "compter avec deux chiffres" pour nommer la plus petite unité

manipulable, le 0 ou le 1.

Ainsi, il combine les découvertes de Boole, les nombres binaires et les circuits

électriques. Il crée un pont entre deux mondes, entre le raisonnement humain à travers

la logique booléenne, et la matière physique à travers la manipulation d'interrupteurs

électriques puis électroniques.

Pourquoi avoir choisi la base 2 ?

* La base 2 présente l'avantage d'être aisément transcrite physiquement. Il suffit en

effet d'un seul composant qui joue le rôle d'interrupteur pour pouvoir l'utiliser. Cette

simplification permet un coût matériel et énergétique minimal. Par contre, il faut la compenser

avec un nombre important de composants.

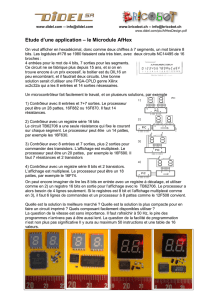

Par exemple, un des premiers ordinateurs, l' ENIAC en 1946 était composé de 19000

tubes à vides remplissant le rôle d'interrupteurs. Etant donné la dimension de ces tubes, la

machine présente des caractéristiques impressionnantes : 42 armoires de 3m de haut, 80m² au

sol, 30 tonnes !

2.FonctionnementOrdinateur.doc Page 4 sur 22

Huit lampes (ou tubes à vide) représentant chacune 1 bit (4)

Ainsi le composant principal, la plus petite unité manipulable physiquement par le

calculateur devient un enjeu important de recherche. A ces lampes succèderont au cours des

années 1950, les fameux transistors, ouvrant la voie à la miniaturisation des processeurs, à

leur capacité de calcul, et à la rapidité des opérations.

* Un autre avantage de la base 2 est, comme l'a démontré Shannon, que l'on peut la

lier aisément à l'algèbre de Boole, aux fonctions logiques. L'algèbre de Boole se base

essentiellement sur des propositions simples qui sont vérifiées ou non. On dit qu'elles sont

vraies ou fausses. Il est alors possible en attribuant à "vrai" le chiffre binaire 1 et à "faux le

chiffre 0, d'utiliser toutes les propositions et organisations possibles de l'algèbre de Boole.

Avec cette technique, les calculs sont considérablement simplifiés. Trois opérations de base

(appelées portes logiques) AND, OR, NOT suffisent pour effectuer n'importe quelles

opérations: additionner, soustraire, multiplier, diviser et comparer des nombres.

En effet, toute opération peut être décomposée par l'opération la plus simple :

l'addition. Dans l'ordinateur toutes les opérations sont faîtes à partir de celle-ci, le calcul étant

très rapide, on a l'illusion d'opérations plus complexes. Pour soustraire on ajoute un nombre

négatif et pour diviser 42 par 7, l'ordinateur soustrait 7 de 42 (il additionne le négatif de 7 à 42

jusqu'à obtenir 0 et il compte le nombre de soustraction = 6). Nous verrons plus en détail le

fonctionnement de la logique booléenne dans une prochaine rubrique.

Le processeur

Le processeur est considéré comme le "cerveau" de l'ordinateur, c'est lui qui effectue

tous les calculs. Par le biais de ces calculs, il exécute toutes les instructions écrites dans les

programmes. Les instructions sont placées en mémoire centrale suivant différents niveaux,

plus ou moins proches du processeur. Il lit les instructions en mémoire centrale et la copie

dans un registre ensuite il exécute les instructions, et ainsi de suite jusqu’à la dernière. Le

premier microprocesseur (Intel 4004) a été inventé en 1971. Il s'agissait d'une unité de calcul

de 4 bits, cadencé à 108 kHz.

2.FonctionnementOrdinateur.doc Page 5 sur 22

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

1

/

22

100%