Implantation et analyse d`un modèle graphique à entraînement

Implantation et analyse d’un modèle graphique à

entraînement supervisé, semi-supervisé et

non-supervisé pour la désambiguïsation

sémantique

Yoshua Bengio, Hugo Larochelle

Département d’Informatique et Recherche Opérationnelle

Université de Montréal

Montréal, Québec, Canada, H3C 3J7

{bengioy,larocheh}@iro.umontreal.ca

Technical Report 1252,

Département d’Informatique et Recherche Opérationnelle

Abstract

La désambiguïsation sémantique est un sujet qui suscite beaucoup d’intérêt

dans la communauté scientifique en apprentissage automatique. Quoique cette

tâche ait été abordée depuis les débuts du traitement automatique de la langue, peu

de progrès ont été accomplis jusqu’à maintenant. Nous présentons ici une applica-

tion de désambiguïsation basée sur un modèle graphique probabiliste. Ce modèle a

été appris sur des données étiquetées, non-étiquetées, et sur la hiérarchie WordNet.

Avec peu d’examples d’apprentissage, ses performances sont comparables à celles

de l’algorithme de Bayes naïf. Il pourrait éventuellement être adapté à des corpus

bi-textes.

1 Introduction

La désambiguïsation attire actuellement beaucoup d’attention en traitement automa-

tique de la langue. Cette tâche, quoique n’étant pas une fin en soi (Wilks and Stevenson,

1996), a été identifiée comme étant IA complète (Ide and Veronis, 1998), i.e. qu’elle

nécessiterait la résolution de tous les problèmes courants en apprentissage automa-

tique. Elle consiste simplement à identifier le sens correct d’un mot ambigu (i.e. ayant

plus d’un sens), à l’aide d’information contextuelle. Elle peut donc être vue comme

une application de classification multi-classe, mais où l’ensemble des classes possibles

est fonction du mot cible. Des percées dans ce domaine auraient un impact bénéfique

dans d’autres tâches, comme la traduction automatique, l’extraction de terminologie,

la recherche d’information et la catégorisation de textes.

1

Plusieurs approches variées ont été proposées jusqu’ici. Il y a les méthodes Lesk

(Lesk, 1980) datant des années 80 et qui utilisent directement les mots de la défini-

tion des sens afin de déterminer l’étiquette sémantique d’un mot cible. Il y a aussi

les méthodes connectionnistes (e.g. (Veronis and Ide, 1990)), les listes de décisions

(Yarowsky, 1994), les méthodes d’apprentissage basé sur des exemples ou “instance

based learning” (Mihalcea, 2002), et encore beaucoup d’autres.

Cependant, chacune des méthodes citées ci-dessus utilisent seulement de l’information

lexicale ou syntaxique, e.g. en considérant seulement les mots contenus dans une

fenêtre de longueur donnée (normalement 5 ou 7 mots) centrée sur le mot cible. La

modélisation en est alors une de la relation entre les mots et leurs sens, et non pas des

sens entre eux.

Pourtant, on image facilement qu’il y ait un lien entre les sens des mots d’un texte.

C’est à ce lien qu’on fait implicitement référence lorsqu’on parle du sujet d’un texte.

Nous proposons donc une approche utilisant un modèle graphique, qui tente de mod-

éliser une relation sémantique liée à ce concept de sujet (“topic”).

2 Présentation du modèle

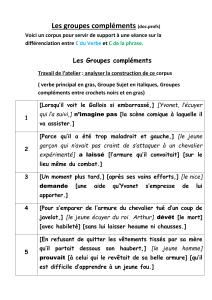

Notre modèle graphique contient trois types de variables: les mots ou lemmes licon-

tenus dans une fenêtre de longueur n(valeur à calibrer), les sens associés siet un sujet

t. On ne considère donc que les mots ayant un ou plusieurs sens, soit les noms, verbes,

adverbes et adjectifs. Comme on n’observe pas le sujet, alors on devra aussi calibrer

le nombre Tde valeurs possibles pour t. On peut voir sur la figure 1 que les seules

relations de dépendances sont entrent les mots et leur sens respectif, puis entre les sens

et le sujet. Bien sûr, il est irréaliste de croire qu’aucun lien direct n’existe entre chacuns

des mots, mais nous croyons que ceux-ci ne sont pas nécessaires pour une modélisation

sémantique raisonnable.

...

...

t

s

s

s

s

1l

l

l

l

1

22

n−1 n−1

n n

Figure 1: Modèle graphique

Le modèle graphique implique alors que la probabilité jointe de toutes les variables

du modèle peut être écrite comme suit:

2

P(t, sn

1, ln

1) = P(t)

n

Y

i=1

P(li|si)P(si|t)(1)

où P(t)et P(s|t)sont les tables de probabilités à apprendre, et où P(l|s)est es-

timée directement sur les données d’entraînement par simple comptage. On note aussi

que les tables P(s|t)et P(l|s)ne dépendent pas de la position i.

3 Désambiguïsation avec le modèle

Afin de choisir les sens sn

1corrects, on peut simplement choisir, pour chaque position

i, le sens qui maximise P(si|ln

1). De plus, puisqu’on a accès aux étiquettes grammat-

icales ou “part of speech” (POS) des mots dans la plupart des corpus disponibles, on

peut réduire directement le nombre de sens possibles en fonction de cette information.

On aimerait cependant profiter de la notion de sujet, qui a inspirée l’approche

courante. On doit donc désambiguïser en choisissant la séquence de sens sn

1qui max-

imise:

P(sn

1|ln

1) = (1/Z)P(sn

1, ln

1) = (1/Z)X

t

P(t, sn

1, ln

1)

avec Z=Psn

1P(sn

1, ln

1). Puisque Za la même valeur pour chaque sn

1, alors on peut

simplement maximiser P(sn

1, ln

1).

Malheureusement, s’il y a en moyenne Msens possibles pour chaque lemme, alors

il y a en moyenne Mnséquences possibles. Le temps de calcul est donc trop important.

Une alternative est d’utiliser une heuristique, afin de sélectionner seulement quelques

unes des séquences possibles, pour ensuite comparer leur valeur de P(sn

1, ln

1)associée.

Nous proposons ici de faire cette sélection en restreignant les sens possibles de cha-

cun des mots li. Pour ce faire, on va se baser sur l’ambiguïté a posteriori individuelle

des li, i.e. la probabilité P(si|ln

1). Les sens possibles du mot cible lipeuvent alors

être classés par ordre de leur probabilité P(si|ln

1), et on peut ensuite sélectionner un

sous-ensemble de ceux-ci, e.g. en prenant les kmeilleurs sens dont la probabilité est

plus grande que la moyenne (i.e. 1/M s’il y a Msens possibles). Les séquences sn

i

retenues sont alors celles qui peuvent être générées par les sous-ensembles créés.

On calcule P(si|ln

1)en utilisant le modèle, pour chaque position i, comme suit:

P(si|ln

1) = X

t

P(si|li, t)P(t|ln

1)(2)

où P(si|li, t)peut être calculée comme suit:

P(si|li, t) = P(li|si)P(si|t)

Psi∈sens(li)P(li|si)P(si|t)(3)

et où on peut calculer d’avance la probabilité a posteriori de t

3

P(t|ln

1) = P(t)Qn

i=1 P(li|t)

PtP(t)Qn

i=1 P(li|t)(4)

en utilisant

P(li|t) = X

s∈sens(li)

P(li|si=s)P(si=s|t)(5)

En bref, on doit:

• calculer (5) de i= 1 àn,t= 1 àT, en temps O(MnT ), et sauvegarder alors les

résultats pour chacune des T×npaires (li, t);

• calculer (4) de t= 1 àT, en temps O(T n), et sauvegarder les résultats pour

chaque valeur de T;

• calculer (3), puis (2) de i= 1 àn, pour chaque sens possible sde li, en temps

O(MnT ), et sauvegarder les résultats pour chacun des M×nsens possibles.

4 Apprentissage dans le modèle

Pour apprendre P(si|t)et P(t), on va utiliser l’algorithme EM, qui peut être adapté à

toute sorte de données (du moins en principe), e.g.:

• des données totalement étiquetées avec sn

1et ln

1;

• des données partiellement étiquetées avec des sens sur seulement un sous-ensemble

des lemmes;

• des données totalement non-étiquetées ln

1;

• des “pseudo-données” qui renforcent le lissage des probabilités P(si, sj)ou

P(li, sj)à l’aide de poids de pseudo-occurences q(si, sj)ou q(li, sj).

À titre de données totalement et partiellement étiquetées, on a à notre disposition:

• le corpus SemCor, qui comporte 230 000 mots étiquetés;

• le corpus eXtended WordNet, qui est simplement l’ensemble des définitions de

sens de la version 1.7 de WordNet ayant été désambiguïsées. Ceci représente

560 000 mots étiquetés;

• le corpus de la tâche “English All Words” de la compétition Senseval-2, soit

2400 mots étiquetés;

4

Le corpus d’entraînement supervisé sera formé du corpus d’eXtended WordNet et

de la majeur partie du corpus SemCor, soit 760 000 exemples. Le corpus de validation

comporte la partie restante de SemCor, et le corpus de test sera simplement le corpus

Senseval-2. Les étiquettes sémantiques sont celles de la version 1.7.1 de WordNet

(Fellbaum, 1996).

À titre de données non-étiquetées, on utilise le corpus Brown, qui comporte 480

000 mots à classe ouverte (noms, verbes, adjectifs et adverbes).

À titre de “pseudo-données”, on va utiliser la hiérarchie de WordNet, en considérant

l’ensemble des couples de sens (si, sj)ayant le même parent. Ces couples sont alors

traités comme s’ils avaient été observés dans un corpus, mais on devra calibrer le poids

qu’ils auront dans l’apprentissage.

La procédure générale consiste donc, pour chaque observation “réelle” ou “pseudo”

notée obs, à faire la mise à jour de la façon suivante:

P(t|obs)→pour réestimer P(t)

P(si|t, obs)→pour réestimer P(s|t)

Lorsque ces probabilités a posteriori sont calculées, et en supposant que chaque

“observation” obs possède un poids w(obs)(ou fréquence), les formules EM de réesti-

mation sont simplement:

P(t)←Pobs P(t|obs)∗w(obs)

Pobs w(obs)

P(s|t)←Pobs PiP(si=s|t, obs)P(t|obs)∗w(obs)

Pobs nP (t|obs)∗w(obs)

L’algorithme EM itère sur les mises à jour ci-dessus, jusqu’à ce qu’un critère de

convergence soit atteint (e.g. la performance en validation atteint son maximum) ou

pour un nombre prédéfini d’itérations.

5 Calcul des probabilités a posteriori

Voici maintenant comment on calcule ces probabilités a posteriori.

1. Considérons premièrement le cas avec données totalement étiquetées:

P(t|ln

1, sn

1) = P(t|sn

1)

=P(sn

1|t)P(t)

PtP(sn

1|t)P(t)

=P(t)Qn

i=1 P(si|t)

PtP(t)Qn

i=1 P(si|t)

P(Si=s|t, ln

1, sn

1) = 1si=s

i.e. 1 si siest s, 0 sinon.

Ces probabilités peuvent être calculées efficacement, en temp O(T n).

5

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

1

/

20

100%