UNIVERSITE HASSAN II

CASABLANCA

ECOLE NATIONAL

SUPERIEURE D4ELECTRICITE

ET DE MECANIQUE

Compte rendu Simulation :

Analyse Numérique

DEPARTEMENT : GENIE ELECTRIQUE.

OPTION : Génie des Systèmes électriques (GSE)

ENCADREE PAR : MME .A.RADID

REALISE PAR :

֎ BARBOURI YASSIR

֎ EL AKKAOUI SABRINE

Année universitaire : 2021-2022

Page 2

Certains problèmes de mathématiques peuvent être résolus numériquement (c.-

à-d., sur ordinateur) de façon exacte par un algorithme en un nombre fini

d'opérations. Ces algorithmes sont parfois appelés méthodes directes ou qualifiés

de finis. Des exemples sont l’élimination de Gauss-Jordan pour la résolution

d’un système d’équations linéaires et l’algorithme du simplexe en optimisation

linéaire.

Cependant, aucune méthode directe n’est connue pour certains problèmes (de

plus, pour une classe de problèmes dits NP-complets, aucun algorithme de

calcul direct en temps polynomial n'est connu à ce jour). Dans de tels cas, il est

parfois possible d’utiliser une méthode itérative pour tenter de déterminer une

approximation de la solution. Une telle méthode démarre depuis une valeur

devinée ou estimée grossièrement et trouve des approximations successives qui

devraient converger vers la solution sous certaines conditions. Même quand une

méthode directe existe, une méthode itérative peut être préférable car elle est

souvent plus efficace et même souvent plus stable (notamment elle permet le

plus souvent de corriger des erreurs mineures dans les calculs intermédiaires)

Par ailleurs, certains problèmes continus peuvent parfois être remplacés par un

problème discret dont la solution est connue pour approcher celle du problème

continu ; ce procédé est appelé discrétisation. Par exemple la solution

d’une équation différentielle est une fonction. Cette fonction peut être

représentée de façon approchée par une quantité finie de données, par exemple

par sa valeur en un nombre fini de points de son domaine de définition, même si

ce domaine est continu.

L’analyse numérique a pour propos la recherche et l’optimisation de méthodes

qui permettent d’approcher la solution d’un problème mathématique pour lequel

la solution exacte est inaccessible. Cette branche des mathématiques appliquées

s’est fortement développée avec la montée en puissance des moyens de calcul

informatique.

INTRODUCTION

Page 3

֎ But de simulation :

Ce TP vise à :

Se familiariser avec le logiciel MATLAB.

Savoir comment résoudre le système d’équation en utilisant :

L’opérateur de division.

La décomposition LU.

La méthode de Gauss.

La méthode de pivot de Gauss.

֎ Exercice 1 :

Soit :

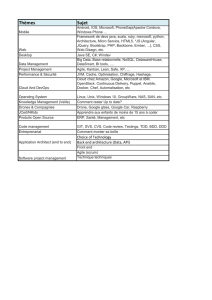

A=[110

122

023] et b=[1

2

3]

1- Création de la matrice A en utilisant la fonction diag et le vecteur b avec

un pas fixe :

Programme :

A=diag(1:3)+diag(1:2,-1)+diag(1:2,1);

b=[1:3]';

Simulation:

TP : EQUATION LINAIRE

Page 4

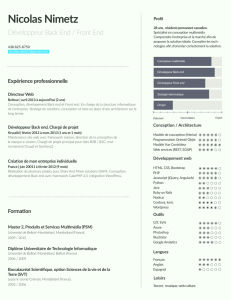

2- Résolution du système d’équation Ax=b en utilisant :

a- L’opérateur de division :

Programme:

A=diag(1:3)+diag(1:2,-1)+diag(1:2,1)

b=[1:3]'

x=A\b

x=inv(A)*b

x=A^(-1)*b

Simulation:

Page 5

b- La décomposition LU :

Programme :

A=diag(1:3)+diag(1:2,-1)+diag(1:2,1)

b=[1:3]'

x=A\b

[L,U,P]=lu(A);

Y = linsolve(L,P*b)

X=linsolve(U,Y)

Simulation:

֎ Exercice 2:

1- La forme matricielle du problème :

Programme :

fg=50;

w=2*pi*fg ;

Ug= 220 ;

R1= 10 ;

R2= 3 ;

C= 10e-6 ;

L= 100e-3 ;

Z=[R1 1/j*C*w 0;0 -1/j*C*w R2+j*w*L;1 -1 -1];

U=[Ug; 0 ; 0]

I=inv(Z)*U

6

6

7

7

8

8

9

9

10

10

11

11

1

/

11

100%