Calcul de Logarithmes Discrets dans Fp par Crible Spécial de Corps

Master 2 Recherche

Algèbre Appliquée au Calcul Formel et à la Cryptographie

Master de Science de l’Université de Versailles Saint-Quentin

Calcul de Logarithmes Discrets dans Fpn

par Crible Spécial de Corps de Nombres.

Application aux courbes elliptiques bien couplées.

Cécile Pierrot

Projet de recherche effectué au laboratoire :

PRiSM - Parallèlisme, Réseaux, Systèmes et Modélisation

Université de Versailles Saint-Quentin

Sous l’encadrement de :

Antoine Joux

Soutenu le 24 Septembre 2013

Résumé

L’objet de ce mémoire est d’étendre le crible spécial de corps de nombres, qui ne portait,

jusqu’ici, que sur des corps de cardinal premier. Notre nouvel algorithme s’étend sur tout

le domaine d’exécution du crible de corps de nombres général, et, en améliore la complexité

asymptotique. Il permet le calcul de logarithmes discrets dans des corps finis dont la carac-

téristique admet une représentation creuse adéquate, ce qui autorise son application sur des

corps finis issus de procédés de couplage.

Introduction

Depuis son introduction, la cryptographie à base de couplage a permis le développement de

nombresux protocoles cryptographiques, des primitives basées sur l’identité [BF03, SK03, CC03,

Pat02], aux schémas de signature courte [BLS04], en passant par l’échange de clef entre trois

individus en un seul tour [Jou04]. Certains de ces protocoles ont d’hors et déjà été déployés

sur le marché, comme l’illustre l’utilisation de la primitive de D. Boneh et M. Franklin par

l’entreprise Voltage [vol].

En pratique, l’un des défis principaux de la cryptographie basée sur les couplages réside

à la fois en la construction de courbes bien couplées qui soient efficaces pour des protocoles

asymétriques à haut niveau de sécurité, et, conjointement, en l’estimation précise de la sécu-

rité de ces courbes. Il s’agit là d’un défi compliqué, puisque sa résolution nécessite la mise en

place de courbes elliptiques particulières : non contentes d’être adaptées aux procédés de cou-

plage, il faut veiller à équilibrer les différents algorithmes de calcul de logarithmes discrets qui

apparaissent dans différentes types de groupes. De nombreux articles se sont attelés à cette

tâche, comme [BLS03] ou [KM05]. Pour évaluer la sécurité d’une construction donnée, l’ap-

proche classique consiste à équilibrer, d’une part, la complexité d’algorithmes en racine carrée

pour résoudre le logarithme discret dans le sous-groupe approprié de la courbe elliptique en

question, avec, d’autre part, la complexité du crible de corps de nombres (NFS1) sur le corps

fini d’arrivée du couplage. La complexité du problème du logarithme discret sur des corps finis

dans ce contexte est habituellement estimée à l’aide de tables de taille de clef telles que [Nat03]

ou [LV01]. Cette approche fait cependant une hypothèse implicite, celle de considérer que la

complexité du NFS dans les corps finis est sensiblement la même que la complexité de la facto-

risation d’un entier de même taille que le corps. Pour autant que nous puissions le dire, cette

hypothèse implicite n’a été vérifiée dans la littérature associée ni à l’un, ni à l’autre de ces deux

problèmes.

La but de ce mémoire est de présenter les outils et le cheminement qui nous ont permis

d’aboutir à l’article The Special Number Field Sieve in Fpn, Application to Pairing-Friendly

Constructions [JP13]. Dans celui-ci, notre visée est double. Tout d’abord, nous montrons que

pour les paramètres actuels utilisés en cryptographie basée sur les couplages, l’hypothèse im-

plicite est incorrecte : l’algorithme le plus performant pour résoudre le logarithme discret dans

cette configuration est la variante de haut degré du crible sur corps de nombres introduit dans

l’article [JLSV06], dont la complexité est plus grande que celle de la factorisation. Nous réexa-

minons ensuite les algorithmes de calcul de logarithme discret pour montrer que, en s’appuyant

sur la forme spéciale de la caractéristique du corps de définition des courbes bien couplées qui

apparait dans les constructions les plus classiques, comme celle de Barreto-Naehrig [BN05], il

est possible de concevoir des algorithmes plus efficaces en généralisant le crible spécial de corps

de nombres (SNFS2) [Gor93, Sch08]. Pour être plus précis, nous allons au-delà de cet objec-

tif et nous présentons des variations du SNFS qui s’appliquent à toute l’étendue du domaine

1De l’anglais, Number Field Sieve.

2De l’anglais, Special Number Field Sieve.

d’application couvert par NFS, dès lors que la caractéristique du corps en question admet une

représentation creuse adéquate.

Ce mémoire s’articule comme suit : en première partie nous rappelons très simplement le

problème du logarithme discret, les algorithmes classiques généraux, ainsi que le principe du

calcul d’indice. Nous exposons ensuite l’algorithme pilier de notre nouveau crible : le crible de

corps de nombres général (NFS), qui est un algorithme par calcul d’indice adapté au calcul

de logarithmes discrets dans les corps finis. Enfin, nous abordons le problème du logarithme

discret dans les corps finis sous un nouvel angle : celui du couplage. Cette étude aboutit à un

crible spécial sur corps de nombres (SNFS), dont la complexité asymptotique au cas par cas est

meilleure que celle du NFS sur tout l’étendue de son domaine d’application.

Le lecteur pressé se dirigera directement au paragraphe 2.4 et en partie 3 où se trouvent les

résultats originaux de ce mémoire.

2

Table des matières

Table des matières 3

1 Le problème du logarithme discret 5

1.1 Algorithmesgénéraux ................................. 7

1.1.1 Pas de bébé/Pas de géant . . . . . . . . . . . . . . . . . . . . . . . . . . . 7

1.1.2 ρdePollard .................................. 8

1.1.3 Algorithme de Pohlig-Hellman . . . . . . . . . . . . . . . . . . . . . . . . 9

1.2 Algorithmes par calcul d’indice . . . . . . . . . . . . . . . . . . . . . . . . . . . . 11

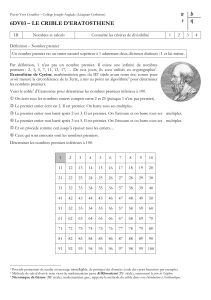

2 Logarithme discret dans les corps finis : le crible de corps de nombres (NFS) 13

2.1 Outilsdivers ...................................... 13

2.1.1 Notations .................................... 13

2.1.2 Probabilités de lissité et heuristiques classiques . . . . . . . . . . . . . . . 14

2.1.3 Algèbre linéaire sur matrice creuse . . . . . . . . . . . . . . . . . . . . . . 15

2.1.4 Algèbre sur corps de nombres . . . . . . . . . . . . . . . . . . . . . . . . . 17

2.2 Lecriblepasàpas ................................... 24

2.2.1 Le cas p=LQ(lp, cp)où 1/3< lp<2/3................... 25

2.2.2 Le cas p=LQ(lp, cp)où 2/36lp61..................... 26

2.3 Mathématiques sous-jacentes . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 27

2.3.1 Factorisation d’idéaux dans l’anneau des entiers OK............ 27

2.3.2 Des idéaux aux éléments . . . . . . . . . . . . . . . . . . . . . . . . . . . . 28

2.4 NFS étendu : le cas p=LQ(1/3, cp)......................... 31

2.5 Complexités asymptotiques . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 33

3 Logarithme discret dans les corps finis issus du couplage 37

3.1 Algorithmes actuels pour la cryptographie à base de couplage . . . . . . . . . . . 37

3.1.1 Erreur sur les tailles de clef . . . . . . . . . . . . . . . . . . . . . . . . . . 37

3.1.2 Choix correct des paramètres . . . . . . . . . . . . . . . . . . . . . . . . . 38

3.2 Crible spécial de corps de nombres (SNFS) . . . . . . . . . . . . . . . . . . . . . 38

3.2.1 Structure des corps finis issus de couplage . . . . . . . . . . . . . . . . . . 38

3.2.2 Choixdespolynômes.............................. 39

3.3 Complexités asymptotiques du SNFS . . . . . . . . . . . . . . . . . . . . . . . . 40

3.3.1 Cas p=LQ(lp, cp)où 1/36lp<2/3..................... 40

3.3.2 Le cas p=LQ(2/3, cp)............................. 42

3.3.3 Crible pour les grandes caractéristiques . . . . . . . . . . . . . . . . . . . 45

3.4 Limites d’application du SNFS . . . . . . . . . . . . . . . . . . . . . . . . . . . . 46

Bibliographie 51

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

41

41

42

42

43

43

44

44

45

45

46

46

47

47

48

48

49

49

50

50

51

51

52

52

53

53

54

54

55

55

1

/

55

100%