REPUBLIQUE ALGERIENNE DEMOCRATIQUE ET POPULAIRE MINISTERE DE L’ENSEINEMENT SUPERIEUR

REPUBLIQUE ALGERIENNE DEMOCRATIQUE ET POPULAIRE

MINISTERE DE L’ENSEINEMENT SUPERIEUR

ET DE LA RECHERCHE SCIENTIFIQUE

UNIVERSITE DE BATNA

FACULTE DES SCIENCES DE L’INGENIEUR

MEMOIRE

Présenté au

DEPARTEMENT D’ELECTRONIQUE

Pour l’obtention du diplôme de

MAGISTER EN MICROELECTRONIQUE

Option : IC Design

Par

Badraddine BEZZA

Ingénieur, Département d’Electronique-Université de Batna

Intitulé

Devant le jury constitué de :

Dr. S.AOUAGHLENT M.C. U. Batna Président

Dr. Z.DIBI M.C. U. Batna Rapporteur

Dr. A.CHAABI Pr. U. Constantine Examinateur

Dr. N.ATHEMENA M.C. U. Batna Examinateur

2010

Micro processeur a instructions variables

DEDICACES

Je dédie ce travail à :

Ma mère,

Mon père,

Ma femme,

Mes frères et mes sœurs,

Tous mes amis sans exception.

Remerciements

Je tiens à remercier, en premier lieu, Mr DIBI Zohir, chef de département d’Electronique

et maître de conférences à l’université de Batna, pour avoir accepté d’encadrer ce travail. Ses

conseils judicieux, ses suggestions pertinentes et la chaleur de ses encouragements m’ont permis

de mener ce projet à terme.

Je remercie aussi les membres du jury pour avoir pris sur leur temps et sur leurs occupations

multiples, ces moments de lecture et de réflexion en vue de cette soutenance.

A tous mes collègues et amis, je dis encore merci pour votre sollicitude et votre

compréhension.

A ma famille, à mes parents, à mes proches, et à tous les miens, merci à tous, pour tout.

Symbole Description

ASIC Application Specific Integrated Circuit

BRAM Block RAM

CISC Complex Instruction Set Computer

CLB Configurable Logic Block

EEPROM Electrically-Erasable Programmable Read-Only Memory

FSM Final State Machine

FPGA Field Programmable Gate Array

ISE Integrated Software Environment

ISA Instruction Set Architecture

JTAG Joint Test Action Group

LC Logic Element

LUT Lock Up Table

MGA Masked Gate Array

MUX Multiplexer

PCB Printed Circuit Board

SR Shift Register

SRAM Static RAM

RISC Reduced Instruction Set Computer

VHSIC Very High Speed Integrated Circuit

VHDL VHSIC Hardware Description Language

HDL Hardware Description Language

Sommaire

Introduction générale .................................................................................................................... 7

Chapitre I : Les plates-formes matérielles......................................................................................... 12

I.1. INTRODUCTION ..................................................................................................................... 13

I.2. GENERALITES ........................................................................................................................ 13

I.2.1. LA LOI DE MOORE ...................................................................................................... 13

I.2.2. LES METRIQUES DE CONCEPTION ......................................................................... 14

I.2.2.1. LA CONCEPTION POUR LA SURFACE

I.2.2.2. LA CONCEPTION POUR LA PERFORMANCE

I.2.2.3. LA CONCEPTION POUR FAIBLE CONSOMMATION

I.2.2.4. LA CONCEPTION POUR FAIBLE COUT

I.2.2.5. LA CONCEPTION POUR LE TEMPS DE MISE SUR LE MARCHE

I.2.2.6. LA CONCEPTION POUR LA PORTABILITE ET LA REUTILISATION .......... 20

I.3. LA PLATE-FORME FPGA ...................................................................................................... 21

I.3.1. LES RESSOURCES LOGIQUES .................................................................................. 21

I.3.2. AUTRES RESSOURCES LOGIQUES .......................................................................... 23

I.3.3. LES RESSOURCES D’INTERCONNEXION............................................................... 24

I.4. LA PLATE-FORME ASIC ........................................................................................................ 25

I.5. LA PLATE-FORME PROCESSEUR ....................................................................................... 26

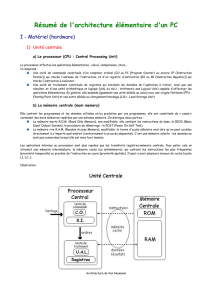

I.5.1. L'ARCHITECTURE DU PROCESSEUR ...................................................................... 26

I.5.2. LA MICROARCHITECTURE DU PROCESSEUR ...................................................... 28

I.6. POURQUOI UTILISE-T-ON EN UTILISANT LA PLATE-FORME FPGA ? ....................... 28

I.6.1. ASIC CONTRE FPGA ................................................................................................... 28

I.6.2. LE SOFTWARE (PROCESSEUR) CONTRE L’FPGA ................................................ 29

I.6.3. LE PROCESSEUR HARD CONTRE LE PROCESSEUR SOFT ................................. 30

I.7. CONCLUSION .......................................................................................................................... 31

Chapitre II : Configuration des FPGA ............................................................................................... 32

II.1. INTRODUCTION .................................................................................................................... 33

II.2. LES GRANULARITE DES FPGA .......................................................................................... 33

II.3. LA MEMOIRE DE CONFIGURATION DE L’FPGA ............................................................ 34

II.4. LES MODELES DE MEMOIRE DE CONFIGURATION ..................................................... 34

II.5. LES TECHNOLOGIES DE CELLULE DE CONFIGURATION DES FPGA ....................... 35

II.5.1. LES DISPOSITIFS A BASE DE SRAM ...................................................................... 35

II.5.2. LES DISPOSITIFS A BASE DE L’ANTI-FUSIBLE ................................................... 36

II.5.3. LES DISPOSITIFS A BASE DE E2PROM/FLASH ..................................................... 36

II.6. LES INTERFACES DE CONFIGURATION FPGA ............................................................... 37

II.7. LES STRATEGIES DE RECONFIGURATION ..................................................................... 37

II.7.1. LA RECONFIGURATION STATIQUE ...................................................................... 38

II.7.2. LA RECONFIGURATION DYNAMIQUE A L'EXECUTION ................................... 38

II.8. CONCLUSION ........................................................................................................................ 39

Chapitre III: Méthodologie et flot de conception ............................................................................. 40

III.1. INTRODUCTION

III.2. LES METHODES ET LES LANGAGES DE CONCEPTION MATERIELLE

III.2.1. LE LANGAGE VHDL ................................................................................................. 42

III.2.2. LA METHODOLOGIE RTL (REGISTER TRANSFER LEVEL) ............................. 43

III.3. LES FLOTS DE CONCEPTION FPGA

III.3.1. LE FLOT DE CONCEPTION FPGA TYPIQUE ........................................................ 45

III.3.2. LE FLOT DE CONCEPTION SPECIALE .................................................................. 47

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

41

41

42

42

43

43

44

44

45

45

46

46

47

47

48

48

49

49

50

50

51

51

52

52

53

53

54

54

55

55

56

56

57

57

58

58

59

59

60

60

61

61

62

62

63

63

64

64

65

65

66

66

67

67

68

68

69

69

70

70

71

71

72

72

73

73

74

74

75

75

76

76

77

77

78

78

79

79

80

80

81

81

82

82

83

83

84

84

85

85

86

86

87

87

88

88

89

89

90

90

91

91

92

92

93

93

94

94

95

95

96

96

97

97

98

98

99

99

100

100

101

101

102

102

103

103

104

104

105

105

106

106

107

107

108

108

109

109

110

110

111

111

112

112

113

113

114

114

1

/

114

100%