1 INTRODUCTION 2 L`ALGORITHME GSW RLS

0.1 0.2 0.3 0.4 0.5 0.6 0.7 0.8 0.9 1

1

1.2

1.4

1.6

1.8

2

2.2

2.4

2.6

2.8

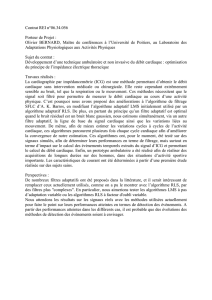

Desajustement du au bruit

Desajustement du a la variation du canal

GSW RLS

WRLS

SWC RLS

0.92 0.93 0.94 0.95 0.96 0.97 0.98 0.99 1

0.15

0.2

0.25

0.3

0.35

0.4

0.45

0.5

0.55

Facteur d’oubli

EQM totale

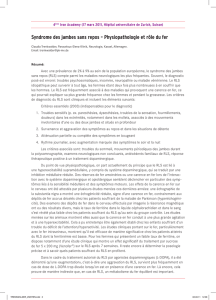

0.95

0.97

0.99

0.995

50 100 150 200 250 300

0.32

0.33

0.34

0.35

0.36

0.37

0.38

0.39

L

EQM totale

0.986

0.987

0.988

0.989

1

/

4

100%