Polytechnique - La Jaune et la Rouge

La Jaune et la Rouge,

revue mensuelle de la Société amicale

des anciens élèves de l’École polytechnique

Directeur de la publication :

Pierre-Henri GOURGEON (65)

Rédacteur en chef :

Jean DUQUESNE (52)

Rédacteur conseil :

Alain THOMAZEAU (56)

Secrétaire de rédaction :

Michèle LACROIX

Éditeur :

SOCIÉTÉ AMICALE DES ANCIENS ÉLÈVES

DE L

’ÉCOLE POLYTECHNIQUE

5, rue Descartes, 75005 Paris

Tél. : 01.56.81.11.00

Mél : [email protected]g

Fax : 01.56.81.11.01

Abonnements, Annuaire, Cotisations :

01.56.81.11.15

Annonces immobilières : 01.56.81.11.11

Fax : 01.56.81.11.01

Bureau des Carrières : 01.56.81.11.14

Fax : 01.56.81.11.03

Rédaction :

5, rue Descartes, 75005 Paris

Tél. : 01.56.81.11.13

Mél : jaune-r[email protected]g

Fax : 01.56.81.11.02

Tarif 2005

Prix du numéro : 8 euros

Abonnements :

10 numéros par an : 33 euros

Promos 1995 à 1998 : 25 euros

Promos 1999 à 2001 : 17 euros

Publicité :

FFE, 18, AVENUE PARMENTIER

BP 169, 75523 PARIS CEDEX 11

TÉLÉPHONE : 01.53.36.20.40

Impression :

EURO CONSEIL ÉDITION

LOIRE OFFSET PLUS

Commission paritaire n° 0109 G 84221

ISSN n°0021-5554

Tirage : 12 500 exemplaires

N° 604 – AVRIL 2005

EUTELSAT WA.

© FRANCE TÉLÉCOM 5Éditorial de Maurice BERNARD (48), ancien professeur de physique

à l’École polytechnique

7Avant-propos, 2005, année mondiale de la physique

par Gabriel CHARDIN, DAPNIA, CEA Saclay

8L’étrangeté du monde quantique

par Roger BALIAN (52), membre de l’Académie des sciences

14 Nanosciences et nanotechnologies

par Jean-Yves MARZIN (75), directeur du Laboratoire de photonique

et de nanostructures (LPN), Marcoussis

19 Recherches et enjeux en physique des plasmas

par Jean-Marcel RAX, professeur à l’Université Paris XI,

directeur du Laboratoire de physique et technologie des plasmas (LPTP),

École polytechnique

24 La physique des particules

par Bruno MANSOULIÉ (75), Commissariat à l’Énergie atomique, Saclay

29 Évolution du climat : le témoignage des glaces polaires

par Jean JOUZEL, directeur du Laboratoire des sciences du climat

et de l’environnement (LSCE)

34 Les tours de passe-passe des topoisomérases

par Gilles CHARVIN,Kerr NEUMAN, David BENSIMON et

Vincent CROQUETTE, Laboratoire de physique statistique,

École normale supérieure, et Terence STRICK, Institut Jacques Monod,

Université Paris VII

5

43 Les télécommunications et le XXIesiècle : une révolution en marche

par Didier LOMBARD (62), président-directeur général de France Télécom

48 La mutation des réseaux

par Jean-Philippe VANOT (72), directeur exécutif Réseaux, Opérateurs et

Système d’information, France Télécom

53 Les réseaux multiservices

par Patrice COLLET (65), directeur Architectures et planification,

France Télécom, et Jean CRAVEUR, Direction Architectures et

planification, France Télécom

57 Réseaux de télécommunications et services de contenus : l’addition de

forces complémentaires aux services des clients

par Patricia LANGRAND (83), directeur exécutif, agrégation des contenus,

France Télécom

43

39 Les polytechniciens et le développement de la physique

par Jean-Claude TOLEDANO (60), président du Département

de physique de l’X

41 Courrier des lecteurs

39

L E

69

77 Bureau des carrières

79 XMP-Entrepreneur

80 Autres annonces

77

Comité éditorial

de La Jaune et la Rouge :

Pierre LASZLO,

Gérard PILÉ (41),

Maurice BERNARD (48),

Michel HENRY (53),

Michel GÉRARD (55),

Nicolas CURIEN (70),

Bruno BENSASSON (92).

69 Procès-verbal de la réunion du Conseil d’administration de l’AX du 16 décembre 2004

70 Cotisation 2005

72 Le Grand Prix de l’Innovation Chéreau-Lavet, prix de l’Académie des technologies,

Prix Pierre Faurre 2005,

Rectificatif,

Réunion scientifique dans le cadre de l’année de la physique

73 Vie des promotions

Groupes X,

Carnet professionnel,

Géostratégies 2000

74 GPX

75 Carnet polytechnicien

68

68 Polytechnique : un campus en pleine évolution

par Yannick d’ESCATHA (66), président du Conseil d’administration de l’École polytechnique

et le général Gabriel de NOMAZY, directeur général de l’École polytechnique

63

63 Prochains séminaires

LA JAUNE ET LA ROUGE – AVRIL 2005

BEAUTÉ DE LA PHYSIQUE

Dans l’histoire de la pensée scientifique, 1905 est une date mythique. En proclamant

que 2005 serait l’année mondiale de la physique, l’Unesco a souligné le caractère

exceptionnel de ce millésime, tout en attirant l’attention universelle sur un siècle de progrès.

La Jaune et la Rouge a, naturellement, souhaité se faire l’écho de cette célébration.

Qu’est-ce que la physique aujourd’hui pour un polytechnicien? Le souvenir d’une des

épreuves du concours d’entrée? La réminiscence de feuilles de cours avalées avec plus

ou moins d‘appétit, rue Descartes ou sur le Plateau? Ou encore, pour certains d’entre

nous, une discipline scientifique devenue métier, passion même, tant sa beauté saute

aux yeux? Cet intérêt éminemment divers que les lecteurs de La Jaune et la Rouge

portent à la physique constitue un défi qu’il convenait de relever, d’autant plus que

l’engouement des jeunes pour les sciences décline, en France, comme d’ailleurs dans

les autres pays développés. Notre ami Gabriel Chardin, encouragé par Roger Balian et

Édouard Brézin, a droit à nos remerciements et à nos félicitations pour avoir su réunir

et coordonner les remarquables contributions à ce numéro, toutes dues à des scientifiques

français de grand talent.

Au moment où le XIXesiècle, celui de l’industrialisation rapide de l’Europe, cède la place

au XXe, le siècle des barbaries modernes, plusieurs énigmes redoutables se posent aux

physiciens. La lumière, désormais bien apprivoisée, avait déployé sa nature ondulatoire

tandis que le champ électromagnétique qui en était la substance même obéissait à des

équations aux dérivées partielles linéaires aux solutions connues. Soudain, l’aspect

corpusculaire de la lumière, abandonné depuis longtemps et apparemment contradictoire

avec son évidente nature ondulatoire, resurgit. En même temps, et pour d’autres raisons,

le support des ondes électromagnétiques, l’éther, devient un concept mystérieux qui contredit

la conception que, depuis bien longtemps, l’homme se fait de l’espace et du temps. À la

même époque, atome, molécule, électron sont des hypothèses commodes, vraisemblables,

mais personne ne sait bien quelle réalité se cache derrière les idées.

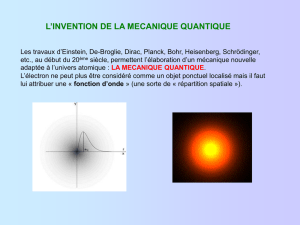

En 1905, un jeune inconnu, Albert Einstein, frappe trois coups éclatants dont l’écho

retentit encore un siècle plus tard :

•pour comprendre l’effet photoélectrique il faut admettre que la lumière est absorbée

par quantas, ces grains de lumière dont, à son corps défendant, quelques années plus

tôt, Max Planck avait dû, pour expliquer le rayonnement du corps noir, admettre

l’existence,

•l’espace et le temps, pour deux observateurs en mouvement rectiligne uniforme l’un

par rapport à l’autre, sont relatifs puisqu’ils se transforment l’un en l’autre de manière

différente,

•l’explication du mouvement brownien donne à l’existence des molécules l’évidence

d’une observation au microscope.

de Maurice Bernard (48),

ancien professeur de physique à l’École polytechnique

AVRIL 2005 – LA JAUNE ET LA ROUGE

Ces avancées, et quelques autres, ouvrent la voie à un siècle de développement prodigieux

de la physique sous tous ses aspects :

•les théoriciens, plus proches que jamais des mathématiciens, imaginent des concepts

nouveaux pendant que les expérimentateurs, auxquels la technique apporte des moyens

d’une puissance inouïe, s’efforcent peu à peu de les valider ou de les réfuter,

•les diverses branches de la physique contribuent au développement et parfois au

bouleversement de toutes les sciences de la nature : mécanique, chimie, biologie,

astrophysique, géologie, etc.,

•de ces progrès résultent des applications pratiques, stupéfiantes et inquiétantes à la

fois. Santé, longévité, biens matériels, civilisation de la connaissance changent la société,

mais les menaces nucléaires, terroristes, écologiques mettent en question l’avenir même

de l’espèce.

Le XIXesiècle avait vu grandir, héritée des Lumières, une foi en la Science que confortent

les premiers pas de la physique. Pourtant, lorsque Jules Verne meurt, justement en

1905, le rêve de progrès qu’il incarne ne va pas tarder à se dissiper.

Le XXesiècle n’est pas, pour la Science, le siècle d’or qu’il aurait pu être. Les succès

mêmes de cette dernière ont mis en évidence les formidables dangers que l’action

technique de l’homme fait désormais peser sur son propre avenir, avec pour conséquences

les peurs, la superstition, l’astrologie, l’occultisme, etc. La Science, largement redevable

à la physique de ses progrès incessants n’est, aujourd’hui, ni suffisamment comprise

par la société, ni réellement reconnue par l’opinion. Jamais notre société n’a autant

reposé sur la “Techné”, au sens que les Grecs donnaient à ce mot, alors que recule,

chez les jeunes, la curiosité pour la science et la technique. Or qui peut douter que les

progrès de l’humanité viennent de la connaissance au sens large, que le développement

durable s’appuie sur le progrès technique et que l’écologie ne peut se construire contre

la science? L’Homme aurait-il une chance de sauver sa planète sans la connaissance?

Le paradoxe est que, dans une fraction significative de l’opinion publique de la plupart

des pays développés, progressent des croyances rétrogrades, des comportements

irrationnels, que diminuent la curiosité technique et l’attrait des jeunes pour les carrières

scientifiques, bref que la confiance en la physique s’effrite.

La beauté de la physique serait-elle la beauté du diable ? Ou plutôt la beauté de

l’inconnaissable? Ceux qui comme moi, dans les années 1950, ont appris la Mécanique

quantique dans l’inoubliable ouvrage d’Albert Messiah se souviennent des épigraphes

qui en ornaient les différents chapitres et peut-être, notamment, de celle qui annonçait

les éléments de mécanique quantique relativiste : “Je suis noire et pourtant je suis

belle…” (Cantique des cantiques).

Je suis sûr que de nombreux lecteurs seront sensibles à la beauté de la physique

d’aujourd’hui, beauté que les textes qui suivent auront contribué, je l’espère, à rendre

moins secrète et plus accessible. Un souhait pour conclure : passé l’année de la physique,

La Jaune et la Rouge ne pourrait-elle aborder le thème du regard que portent la société

et notamment les jeunes sur la science et la technique?■

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

41

41

42

42

43

43

44

44

45

45

46

46

47

47

48

48

49

49

50

50

51

51

52

52

53

53

54

54

55

55

56

56

57

57

58

58

59

59

60

60

61

61

1

/

61

100%