Fonctions logiques Et Circuits

CHAPITRE 2. Fonctions Logiques et Circuits

Des 0 et des 1…

1

2

2

C

CH

HA

AP

PI

IT

TR

RE

E

2

2

F

Fo

on

nc

ct

ti

io

on

ns

s

l

lo

og

gi

iq

qu

ue

es

s

E

Et

t

C

Ci

ir

rc

cu

ui

it

ts

s

D

De

es

s

0

0

e

et

t

d

de

es

s

1

1.

.

Faire simple, mais pas plus (A. Einstein)

CHAPITRE 2. Fonctions Logiques et Circuits

Des 0 et des 1…

2

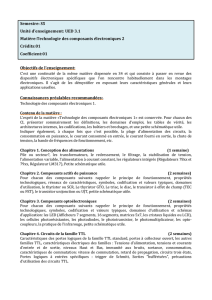

L’objectif de ce chapitre est de montrer d’une part, que le traitement des

données par une Unité Arithmétique et Logique et leur stockage dans une

mémoire peut être entièrement décrit par des fonctions logiques très

simples(ET, OU, NON) et d’autre part, que ces fonctions peuvent être réalisées

par des circuits tout aussi simples. Avec des dispositifs très simples (transistors

par exemple) mais certainement en grand nombre, il est possible de réaliser

les fonctions de traitement (calcul) et de mémorisation d’un ordinateur.

Les technologies utilisées dans les ordinateurs actuels s’appuient toutes sur

des systèmes physiques ayant deux états stables : allumé – éteint, ouvert –

fermé, trou – bosse, etc. Mais pour se dégager des contraintes physiques de

ces systèmes, il est avantageux de travailler sur un modèle mathématique

commun comme la logique.

Après de brefs rappel sur l’algèbre de Boole, la première partie du chapitre

est consacrée à la conception de circuits permettant de réaliser des fonctions

logiques et arithmétiques. Il s’agit de la spécification d’une fonction à l’aide

d’une table de vérité (Boole), de la synthèse de la fonction (minterms) et

finalement sa réduction (Karnaugh). Ces étapes sont basées sur la logique

combinatoire.

La deuxième partie est dédiée à la conception de circuits mémoire en utilisant

les mêmes fonctions élémentaires logiques de base. La modélisation fait

intervenir la logique séquentielle et de manière plus générale la théorie des

automates finis (automates de Moore, Mealy)

A partir de ces circuits de traitement et de stockage, la troisième partie donne

un exemple d’architecture générale d’un microprocesseur très simple avec son

Unité Arithmétique et Logique et ses mémoires internes (les registres) et les

caractéristiques principales d’une « carte unité centrale ».

CHAPITRE 2. Fonctions Logiques et Circuits

Des 0 et des 1…

3

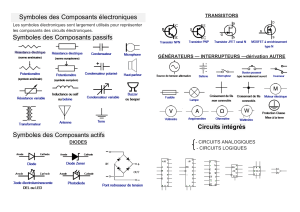

2.1 Algèbre de Boole & Logique.

George Boole a donné une base algébrique à la logique des propositions, une

proposition étant un énoncé qui peut être vrai (V) ou faux (F). Ces propositions

peuvent être reliées par des connecteurs pour élaborer de nouvelles propositions de

ce système binaire. Les connecteurs usuels sont le ¬ (non logique), le ∧ (et

logique) et le ∨ (ou logique). Par exemple, le connecteur ¬ appliqué à une

proposition vraie la rendra fausse. Le « robinet est ouvert » est une proposition p

qui peut prendre les deux valeurs V et F. La proposition q « l’eau coule » est une

proposition qui peut être vraie ou fausse. S’il y a deux robinets, alors la proposition

« l’eau coule » est à vrai si l’un ou l’autre des robinets est à vrai. Les variables

associées aux propositions pour manipuler celles-ci de manière plus abstraites sont

appelées des variables booléennes. Nous avons ainsi la formalisation

q=V lorsque p1=V ou p2=V et

q=F dans tous les autres cas.

La représentation algébrique donne q= p1 ∨ p2 à condition de définir totalement

(pour toutes les valeurs possibles des variables p1 et p2) l’opérateur ∨.

A l’instar des opérations arithmétiques qui sont définies à l’aide de tables

(d’addition, de multiplication, ..), un opérateur (connecteur) logique est défini par

une table dite de vérité. Pour des propositions p et q quelconques, la table de

vérité de l’opérateur logique ou est donnée en figure 2-1.

Longtemps après les travaux de

George Boole, Claude Shannon a fait

le lien entre les états ouvert et fermé

des relais électromagnétiques utilisés

dans les centraux téléphoniques et les

nombres binaires 0 et 1. Les

principaux résultats de l’algèbre vont

être rappelés avec la notation de Shannon. La même table de vérité devient alors,

en prenant la convention V=1 et F=0, les variables sont dénommées a et b.

Intéressons nous plus particulièrement, l’ensemble étant dénombrable, à l’ensemble

de toutes les fonctions à deux variables. Il y a 16 fonctions de ce type, mais qui ne

sont évidemment pas toutes indépendantes les unes des autres.

a b f1

f2

f3

f4

f5

f6

f7

f8

f9

f10 f11 f12 f13 f14 f15 f16

0 0 0 1 0 1 0 1 0 1 0 1 0 1 0 1 0 1

0 1 0 0 1 1 0 0 1 1 0 0 1 1 0 0 1 1

1 0 0 0 0 0 1 1 1 1 0 0 0 0 1 1 1 1

1 1 0 0 0 0 0 0 0 0 1 1 1 1 1 1 1 1

Figure 2–2 Les fonctions logiques à 2 variables.

a

b

a∨b

1 1 1

1 0 1

0 1 1

0 0 0

p

q

p∨q

V V V

V F V

F V V

F F F

Figure

2

–

1

Table de vérité du

ou

logique.

CHAPITRE 2. Fonctions Logiques et Circuits

Des 0 et des 1…

4

Parmi ces fonctions certaines sont plus intéressantes que d’autres : f1 ne présente

pas un intérêt majeur (elle produit la valeur 0 quelque soient les valeurs de a et b.

Par contre celles qui sont surlignées (f2, f7, f8, f8, f15,) sont plus utiles et certaines

mêmes fondamentales. Avec les notations en chiffres binaires, les opérateurs ∧ et ∨

sont remplacés par les signes . et +.

and a.b nand (a.b) nor (a+b) xor a ⊕ b or a +b

Figure 2–3 Les fonctions logiques usuelles à 2 variables.

De fait on peut montrer que toutes les fonctions logiques, quelles qu’elles soient,

peuvent être construites à partir de deux opérateurs (¬ et +) ou (¬ et .). Ce résultat

peut paraître curieux, mais effectivement toute opération faite par l’ordinateur, que

ce soit le calcul d’un logarithme ou un classement par ordre alphabétique, sera

traduite in fine en fonctions élémentaires de ce type.

Le complément d’une variable peut s’écrire de différentes manières :

¬a, que l’on lit non a, a barre, a étoile, a complémenté (et à tort a inversé). La

notation a prime ( a’ ) est une des plus usitée.

Les principaux résultats de l’algèbre de Boole sont résumés en figure ?2-4.

Figure 2–4 Algèbre de Boole : quelques résultats.

Le théorème fondamental est celui de De Morgan : il dit que le complément d’un

OU donne le ET des compléments, et inversement.

Théorème des constantes

a + 0 = a

a . 0

= 0

a + 1 = 1 a . 1 = a

Idempotence a + a = a a . a = a

Complémentation a + a= 1 a . a = 0

Commutativité a + b= b + a a . b= b . a

Distributivité sur OU a + (bc) = (a + b) . (a + c)

sur ET a . (b + c)= (a.b) + (a.c)

Associativité sur OU a + (b + c) = (a + b) + c = a + b + c

sur ET a .(b.c) = (a. b). c = a.b.c

Théorème de De Morgan baab += et baba=+

On notera aussi la relation définissant le ou exclusif.

bababa+=⊕

111

001

010

000

f9

ba

111

001

010

000

f9

ba

011

001

010

100

f2

ba

011

001

010

100

f2

ba

011

101

110

100

f8

ba

011

101

110

100

f8

ba

011

101

110

000

f7

ba

011

101

110

000

f7

ba

111

101

110

000

f15

ba

111

101

110

000

f15

ba

CHAPITRE 2. Fonctions Logiques et Circuits

Des 0 et des 1…

5

2.2 Logique Combinatoire.

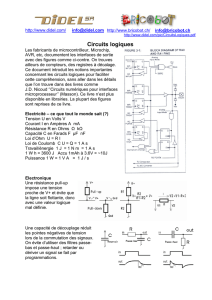

Lorsque l’on passe à une réalisation pratique à l’aide de circuits électronique on

utilise parfois le symbolisme suivant dit des portes logiques (gates). Un ensemble

de portes connectées constitue un circuit logique.

2.2.1 Les circuits combinatoires

a.b a +b non a ⊕ b

Figure 2–5 Les circuits de base.

Le circuit de la figure 2-6 donne la réalisation d’un ou exclusif à l’aide de portes

et/ou et d’inverseurs.

Ce circuit correspond à la matérialisation de la relation bababa+=⊕ et est

appelé un logigramme.

Figure 2–6 Logigramme du XOR.

Ce type de réalisation est un circuit combinatoire : les sortie évoluent «

simultanément » avec les entrées au temps de propagations près.

Ces circuits se distinguent des circuits séquentiels par le fait que ces derniers ont

une capacité de mémorisation.

Les circuits combinatoires vont nous permettre d’aboutir à la construction d’une

Unité Arithmétique et Logique (UAL), composant qui dans un processeur effectue

les calculs sur les données. Les circuits séquentiels vont être à la base des circuits

de mémorisation et donc de la mémoire tout court.

Circuits électroniques et transistors.

Un transistor est fondamentalement un composant

électronique réalisant une amplification de courant : le courant

dans le collecteur est proportionnel (gain β) au courant injecté

dans la base. Ce gain peut être de l’ordre de 100 mais peut

aussi prendre des valeurs très importantes. Le transistor utilisé

en mode amplificateur sert essentiellement dans les dispositifs

destinés au traitement analogique du signal : amplification,

filtrage, modulation, …

collecteur

base

émetteur

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

41

41

42

42

43

43

44

44

45

45

46

46

47

47

48

48

49

49

50

50

51

51

1

/

51

100%