Prétraitement des données

Prétraitementdesdonnées

Piét it ldé?

1

•

P

ourquo

i

pr

ét

ra

it

er

l

es

d

onn

é

es

?

•Nettoyagedesdonnées

•

Intégration et transformation

Intégration

et

transformation

•Réductiondesdonnées

•Discrétisationet

g

énérationdehiérarchiesde

g

concepts

Pourquoiprétraiterlesdonnées?

é é

2

•Donn

é

esr

é

ellessouvent

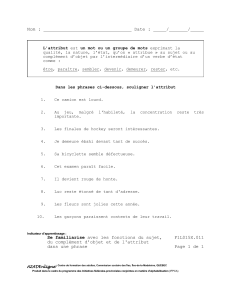

incomplètes :valeurs manquantes données

incomplètes

:

valeurs

manquantes

,

données

simplifiées

bruitées:erreursetexceptions

ihét d

i

nco

hé

ren

t

es:nommage,co

d

age

•Résultatsdelafouilledépendentdelaqualitédes

données

Principalesétapesdansleprétraitementdesdonnées 3

•Nettoyage

•Intégration

Data cleaning

Data integration

•Transformation

•Réduction

Data transformation

Data reduction attributes attributes

A1 A2 A3 ... A126

2, 32, 100, 59, 48 0.02, 0.32, 1.00, 0.59, 0.48

s

A1 A3 ... A115

•Discrétisation

A1 A2 A3 ... A126

T1

T2

T3

T4

...

tra

nsactions

transaction

s

A1 A3 ...

T1

T4

...

T1456

A115

...

T2000

tra

Donnéesmanquantes

é

4

•Donn

é

esnondisponibles

certains attributs n

’

ont pas de valeur

certains

attributs

nont

pas

de

valeur

•Causes:

mauvaisfonctionnementdel’équipement

incohérencesavecd’autresdonnéesetdonc

supprimées

supprimées

nonsaisiescarnonoumalcomprises

considéréespeuimportantesaumomentdela

ii

sa

i

s

i

e

•

Ces données doivent être inférées

Ces

données

doivent

être

inférées

Commentremplirlestrous?

I l tl

5

•

I

gnorer

l

e

t

up

l

e

peuefficacequandlepourcentagedevaleursmanquantesestélevé

Clé ll ldé

•

C

omp

lé

termanue

ll

ement

l

es

d

onn

é

es

Laborieuxouinfaisable

•Utiliseruneconstanteglobale

ex:« inconnue »,unenouvellecatégorie?

•Utiliserlamoyennedel’attribut

•Utiliserlamo

y

ennedel’attribut

p

ourlamêmeclasse

y p

mieux

•

Utiliser la valeur la plus probable

Utiliser

la

valeur

la

plus

probable

formuleBayésienneouarbrededécision

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

1

/

27

100%