Rapport TP Matlab : Méthodes d'Optimisation

Compte rendu de TP Matlab

Apprentissage de Matlab via l’implémentation de méthodes d’optimisation

Par Henri-

François Chadeisson,

Compte rendu de TP Matlab

Apprentissage de Matlab via l’implémentation de méthodes d’optimisation

François Chadeisson,

Manuel Rolland et Mickaël Mounier.

Apprentissage de Matlab via l’implémentation de méthodes d’optimisation

05/05/08

Compte rendu de TP Matlab

Page 2

Compte rendu de TP Matlab

Apprentissage de Matlab via l’implémentation de méthodes d’optimisation

Sommaire

1. D

ESCENTE DE GRADIENT

..................................................................3

a.

Principe ..................................................................................... 3

b.

Résultats .................................................................................... 3

c.

Conclusions ................................................................................. 5

2. M

ETHODE DE

N

EWTON

....................................................................6

a.

Principe ..................................................................................... 6

b.

Résultats .................................................................................... 6

c.

Conclusions ................................................................................. 7

3. BFGS ....................................................................................7

a.

Principe ..................................................................................... 7

b.

Résultats .................................................................................... 8

c.

Conclusions ................................................................................. 8

4. E

SSAIM DE PARTICULES

....................................................................9

a.

Principe ..................................................................................... 9

b.

Résultats .................................................................................... 9

c.

Conclusions ................................................................................ 13

Compte rendu de TP Matlab

Page 3

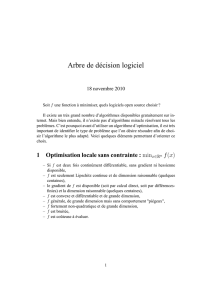

1. Descente de gradient

a. Principe

La descente de gradient est une méthode d’optimisation très simple où l’on utilise la dérivée

(ou le gradient, en dimension > 1) d’une fonction afin de trouver un extremum local. La

méthode repose sur la formule itérative :

On arrête l’itération lorsque le vecteur

« ne varie plus ». Soit donc quand

|

| .

Physiquement, dans le cas de la recherche de minima d’une fonction de R

2

dans R, en

imaginant que le point soit une bille, cette méthode revient à trouver la zone où

l’accélération est minimale en se laissant guider par la pente de la surface.

Comment choisir ? Grossièrement, détermine la vitesse de descente de la pente, si on le

choisi trop gros on risque de sauter par-dessus l’extrema. Mais si on le choisit trop petit la

convergence est lente. Une solution intéressante est donc de le décrémenter à chaque

itération. Cette méthode n’est pas satisfaisante car on fini par ne plus avancer du tout au

bout de plusieurs itérations (alors que l’on est peut être encore loin de l’extrema). Une

solution plus appropriée qui marche bien dans la pratique est de l’incrémenter si

ou de le décrémenter sinon.

b. Résultats

Avec la fonction f(x) = x² (fichier « gradient.m ») :

Compte rendu de TP Matlab

Page 4

La méthode fonctionne bien car la pente est grande et la courbe simple.

Avec la fonction de Rosenbrock (fichier « gradient2.m ») :

Compte rendu de TP Matlab

Page 5

Il faut choisir un compromis entre et . C'est-à-dire qu’il faut faire un compromis

entre vitesse de convergence et précision (comme souvent). Un des meilleurs résultats

que l’on a pu obtenir (cf. capture d’écran) est un extrema à [0.9995 ; 0.9990] au bout

de 7900 itérations. Généralement l’on s’arrête avant et le résultat devient faux.

Certains points ont des positions étonnantes à cause de l’augmentation d’ à certaines

itérations.

c. Conclusions

Cet algorithme naïf fonctionne mais il converge excessivement lentement. De plus, il est très

dépendant des réglages que l’on peut faire : , et la façon dont ce dernier varie. Dans les

implémentations que nous avons faites ces réglages sont bien choisis. En revanche, si on les

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

1

/

13

100%